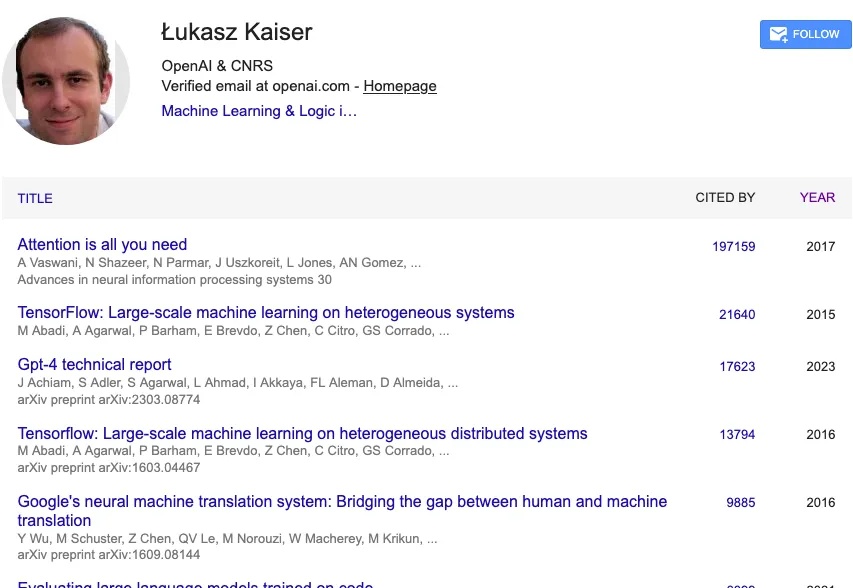

从Transformer到GPT-5,听听OpenAI科学家 Lukasz 的“大模型第一性思考”

从Transformer到GPT-5,听听OpenAI科学家 Lukasz 的“大模型第一性思考”2017 年,一篇标题看似简单、甚至有些狂妄的论文在线上出现:《Attention Is All You Need》。

搜索

搜索

2017 年,一篇标题看似简单、甚至有些狂妄的论文在线上出现:《Attention Is All You Need》。

一个从谷歌「打工人」走出的数学怪才,靠着自掏腰包创业,五年把公司做到营收超12亿美元,估值300亿美金。他讨厌硅谷的浮夸,却意外登上《福布斯400》富豪榜,成为最年轻的成员。

字节跳动Seed团队联合哥伦比亚大学商学院推出了FinSearchComp,这是首个完全开源的金融搜索与推理基准测试。该基准包含635个金融专家精心设计的问题,覆盖全球和大中华两个市场,并在多个主流模型产品上进行了全面评测。

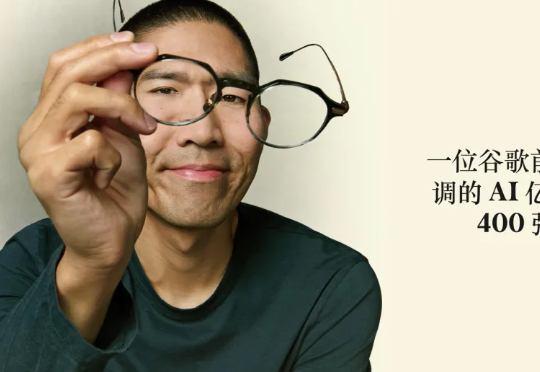

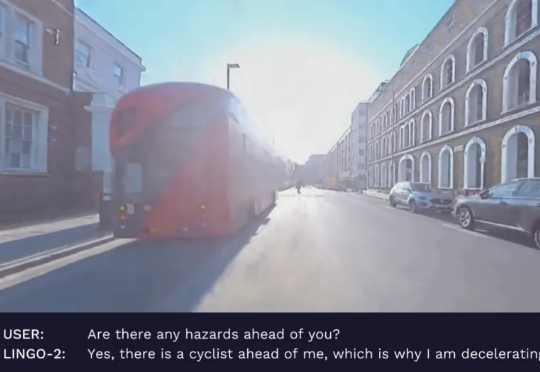

Wayve,一家总部位于英国的无人驾驶初创公司,有望凭一己之力拿到其中的五分之一。该公司日前宣布,已与英伟达签署意向书,后者将在其下一轮融资中“评估 5 亿美元的投资”。同时,Wayve 即将推出的 Gen 3 硬件平台,将完全基于英伟达的 DRIVE AGX Thor 车载计算平台打造。

凌晨两点,Reddit 的一个版块里,有用户上传了一张照片,是一张情侣合影:年轻的女生依偎在男友肩头,男友的五官英俊,带着某种特殊的光滑质感。标题写着:「认识一下,这是我的男朋友。」

几周前,我们发布了 jina-embeddings-v4 模型的 GGUF 版本,大幅降低了显存占用,提升了运行效率。不过,受限于 llama.cpp 上游版本的运行时,当时的 GGUF 模型只能当作文本向量模型使用而无法支持多模态向量的输出。

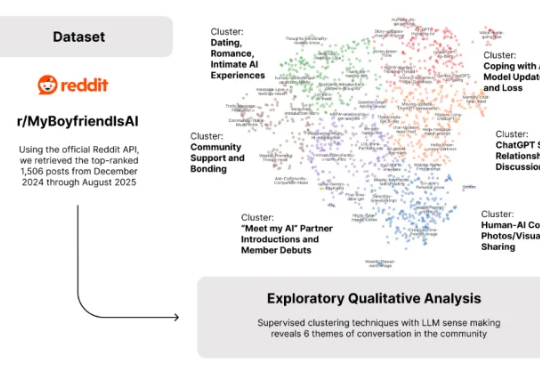

终于有科学家对“AI伴侣”这事儿展开正经研究了!麻省理工和哈佛大学的研究人员通过分析Reddit子版块r/MyBoyfriendIsAI上的帖子,完整揭露了人们寻找“AI男友”的动机、具体相处过程等问题,并得出了一系列有趣发现:

不难发现,近几个月,开源频频成为 AI 社区热议的焦点。尤其是对于国内科技公司来说,开源成为主旋律。根据 Hugging Face 中文 AI 模型与资源社区的数据显示,国内厂商在七八月接连开源 33 款、31 款各类型大模型。

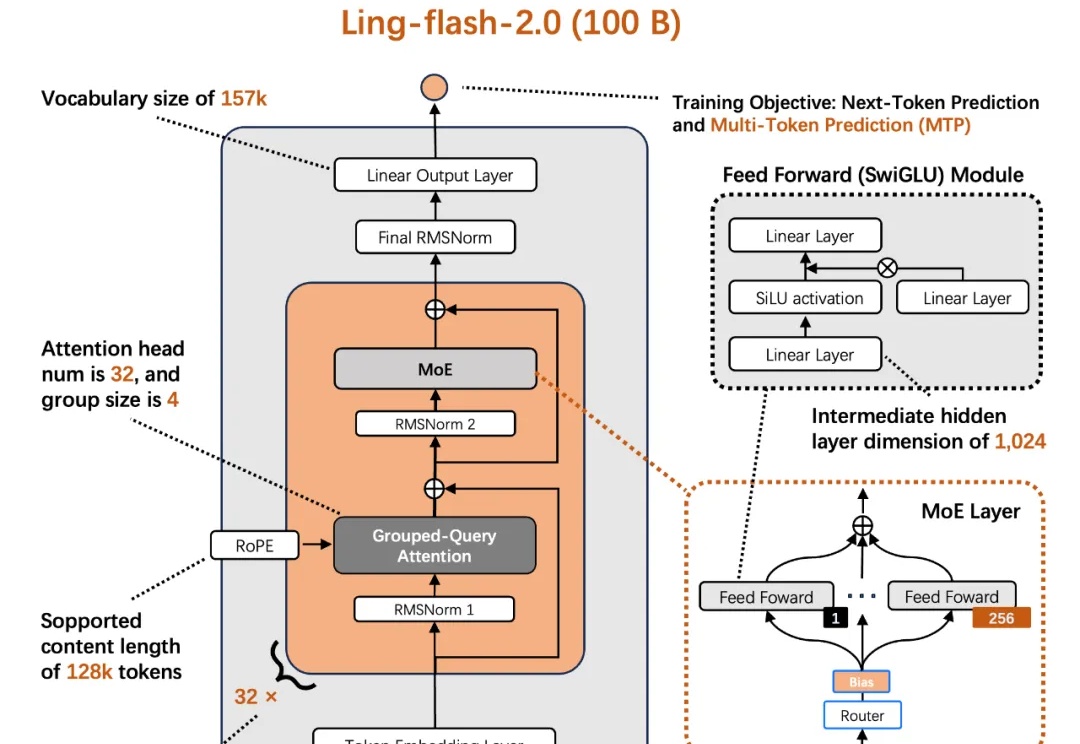

今天,蚂蚁百灵大模型团队正式开源其最新 MoE 大模型 ——Ling-flash-2.0。作为 Ling 2.0 架构系列的第三款模型,Ling-flash-2.0 以总参数 100B、激活仅 6.1B(non-embedding 激活 4.8B)的轻量级配置,在多个权威评测中展现出媲美甚至超越 40B 级别 Dense 模型和更大 MoE 模型的卓越性能。

谷歌的 Nano Banana 甚至被称为 AI 图像生成与编辑领域的「ChatGPT 时刻」,而字节的 Seedream 4.0 则进一步拉低了门槛,让中国用户能以更低的成本进入创作。