速递|德国AI客服独角兽Parloa估值半年翻倍,冲刺20-30亿美元,拟融资2亿美元

速递|德国AI客服独角兽Parloa估值半年翻倍,冲刺20-30亿美元,拟融资2亿美元据知情人士透露,开发客户服务人工智能的德国初创公司Parloa正在寻求新一轮融资,估值将较今年5月大幅提升。这家在德国和纽约设有办公室的公司,已与包括General Catalyst在内的投资者进行了洽谈,寻求筹集约2亿美元的新资金。知情人士称,Parloa正在讨论的潜在估值区间约为20亿至30亿美元。

搜索

搜索

据知情人士透露,开发客户服务人工智能的德国初创公司Parloa正在寻求新一轮融资,估值将较今年5月大幅提升。这家在德国和纽约设有办公室的公司,已与包括General Catalyst在内的投资者进行了洽谈,寻求筹集约2亿美元的新资金。知情人士称,Parloa正在讨论的潜在估值区间约为20亿至30亿美元。

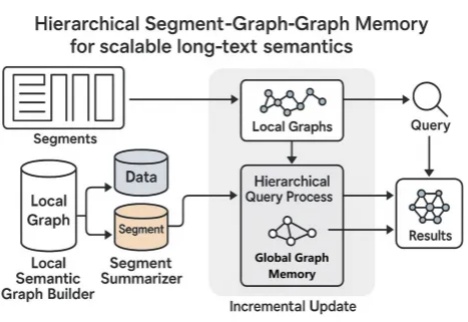

当你阅读《红楼梦》《哈利·波特》《百年孤独》等长篇小说时,读着读着可能就忘记前面讲了什么,有时还会搞混人物关系。AI 在阅读长文章的时候也存在类似问题,当文章太长时它也会卡主,要么读得特别慢,要么记不住前面的内容。

大家好,我是袋鼠帝。 今天想跟大家聊聊最近很火的一个新概念:GEO

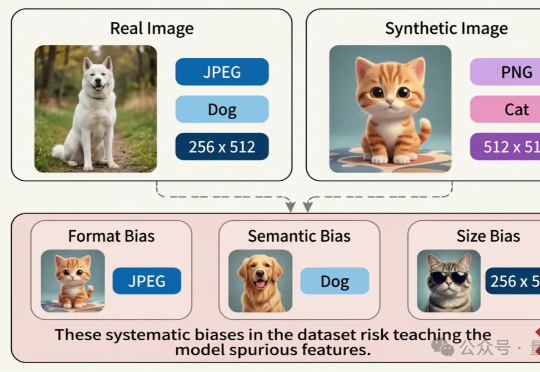

近日,腾讯优图实验室联合华东理工大学、北京大学等研究团队在A生成图像检测(AI-Generated Image Detection)泛化问题上展开研究,提出Dual Data Alignment(双重数据对齐,DDA)方法,从数据层面系统性抑制“偏差特征”,显著提升检测器在跨模型、跨数据域场景下的泛化能力。

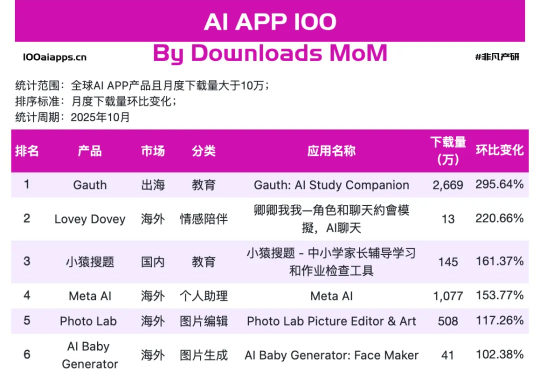

但当我们把视线从焦点模型上,挪到手机里AI应用真实数据上,就会发现一幅不同的画面。可以看到在非凡产研 10 月 AI App 增速榜上,跑得最快的那 17 个,并不是万事皆可聊的通用助手,而是一群看上去有点普通、甚至有点土气的小应用,其中Gauth、Starry、Knowunity、AI Baby Generator已经连续两个月上榜了。

「Vibe Coding 肯定是有 PMF 的,但 Vibe Coding 产品其实还没找到自己的 PMF。」AI Coding 明星产品 Lovable 的增长负责人 Elena Vera,在一次采访中明确说道。来自 The Information 数据,以 Cursor、Claude Code 为代表的 AI Coding 工具的累计营收,已经突破了 31 亿美元。

General Agent将如何融入贝索斯公司尚未可知。 General Agents由前OpenAI研究员威廉·格斯(William Guss)于2024年创办,汇聚了来自麻省理工大学、谷歌大脑等高校和机构的研究人员,专注计算机Agent赛道,目前已发布一款Agent产品Ace,该产品能接管用户的电脑并以超人类的速度执行指令操作。

Context Pruning如何结合rerank,优化RAG上下文?

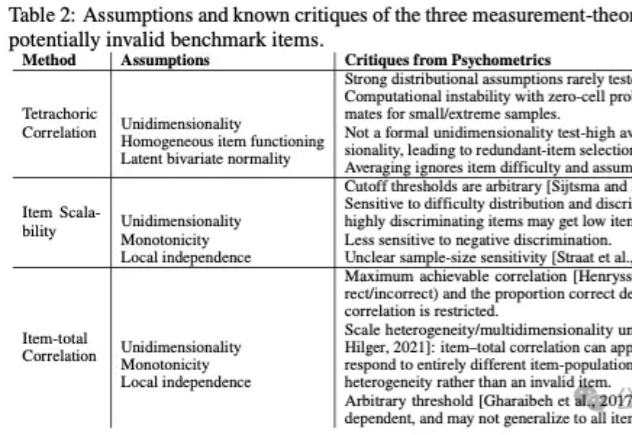

基准测试(Benchmarks)在人工智能的发展进程中扮演着至关重要的角色,构成了评价生成式模型(Generative Models)性能的事实标准。对于从事模型训练与评估的AI研究者而言,GSM8K、MMLU等数据集的数据质量直接决定了评估结论的可靠性。

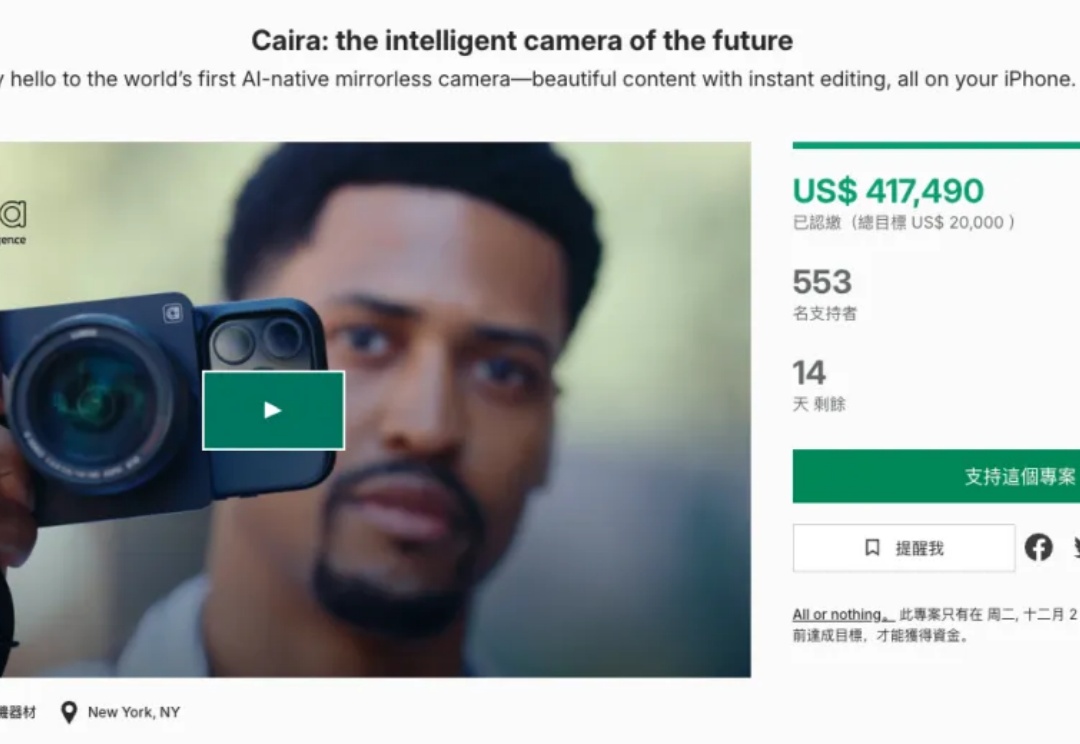

就在前两天,深圳一家名为 Inspire Curve 的创企设计出的 AI 概念相机,获得了有“设计界奥斯卡”美誉的 iF 设计奖。从媒体报道给出的信息看,两款产品的共通之处是将 AI 生图模型引入拍摄过程,让用户在 AI 的帮助下,一键“出片”。