实测“清华特奖版Sora”:一图一prompt直接生成视频,堪称嘴强王者

实测“清华特奖版Sora”:一图一prompt直接生成视频,堪称嘴强王者那边OpenAI的Sora2还没全面开放,这边国内团队已经上线了自己的“特色打法”。 清华特奖选手创办的Sand.ai,上线了音画同步视频模型GAGA-1。

那边OpenAI的Sora2还没全面开放,这边国内团队已经上线了自己的“特色打法”。 清华特奖选手创办的Sand.ai,上线了音画同步视频模型GAGA-1。

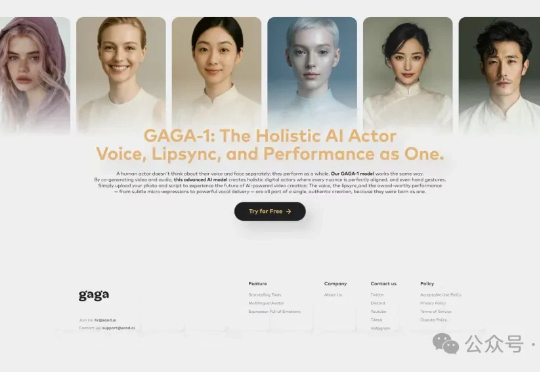

在杭州奥体中心演唱会现场,一套名为「Co-Sight 2.0」的AI系统成功保障了网络稳定,其背后是中兴通讯研发的、新近登顶Hugging Face GAIA全球权威榜单的超级智能体。

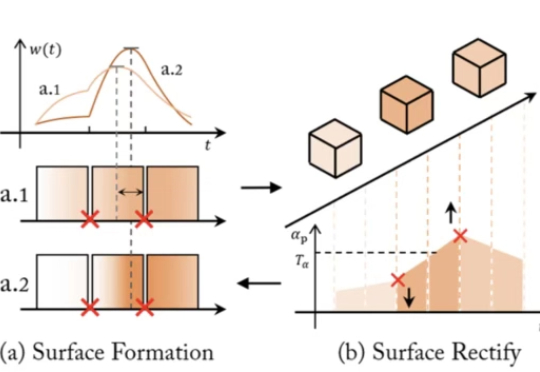

近年来,NeRF、SDF 与 3D Gaussian Splatting 等方法大放异彩,让 AI 能从图像中恢复出三维世界。但随着相关技术路线的发展与完善,瓶颈问题也随之浮现:

1.3千万亿,一个令人咂舌的数字。这就是谷歌每月处理的Tokens用量。据谷歌“宣传委员”Logan Kilpatrick透露,这一数据来自谷歌对旗下各平台的内部统计。那么在中文世界里,1.3千万亿Tokens约2.17千万亿汉字。换算成对话量,一本《红楼梦》的字数在70-80万左右,相当于一个月内所有人和谷歌AI聊了近30亿本《红楼梦》的内容。

Sora2爆火之后,随之而来的AI视频领域的新产品。 来自我的好朋友,曹越老师的Sand.ai。凌晨,他们终于上线了他们全新的音画同步视频模型GAGA-1,在人物表演上,我觉得,已经算是现在的TOP级了。

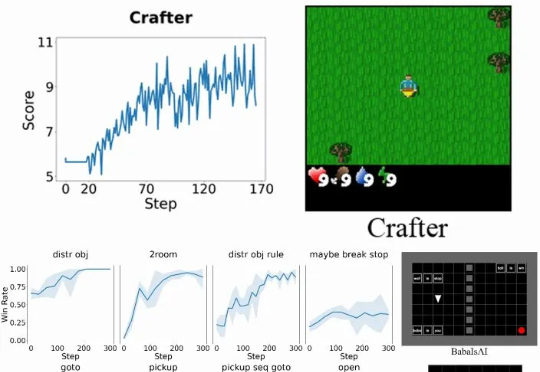

具体而言,Verlog 是一个多轮强化学习框架,专为具有高度可变回合(episode)长度的长时程(long-horizon) LLM-Agent 任务而设计。它在继承 VeRL 和 BALROG 的基础上,并遵循 pytorch-a2c-ppo-acktr-gail 的成熟设计原则,引入了一系列专门优化手段,从而在任务跨度从短暂交互到数百回合时,依然能够实现稳定而高效的训练。

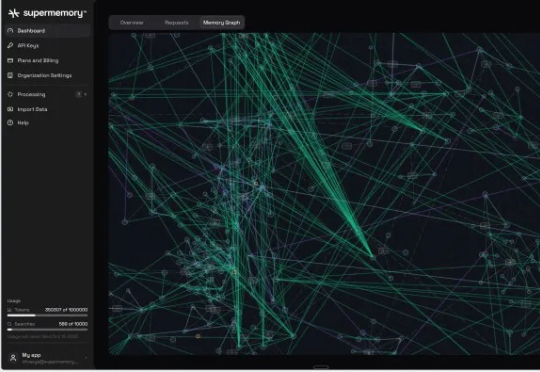

Supermemory 已获得由 Susa Ventures、Browder Capital 和 SF1.vc 领投的 260 万美元种子轮融资。此轮融资还包括 Cloudflare 的 Knecht、谷歌人工智能负责人 Jeff Dean、DeepMind 产品经理 Logan Kilpatrick、Sentry 创始人 David Cramer 以及来自 OpenAI、

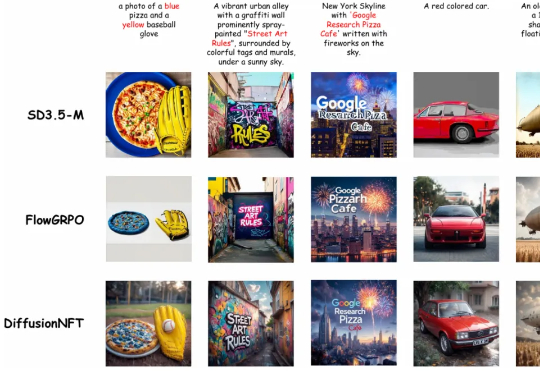

清华大学朱军教授团队,NVIDIA Deep Imagination 研究组与斯坦福 Stefano Ermon 团队联合提出了一种全新的扩散模型强化学习(RL)范式 ——Diffusion Negative-aware FineTuning (DiffusionNFT)。该方法首次突破现有 RL 对扩散模型的基本假设,直接在前向加噪过程(forward process)上进行优化

Obot MCP Gateway是他们解决方案的核心,这是一个开源控制平面,为IT团队提供了对MCP部署前所未有的可见性和控制能力。从架构上看,这个网关采用了代理模式,所有与MCP服务器的通信都会通过网关进行代理,这为审计、日志记录和应用安全策略提供了单一控制点。这种设计消除了影子AI的可能性,确保了合规性。

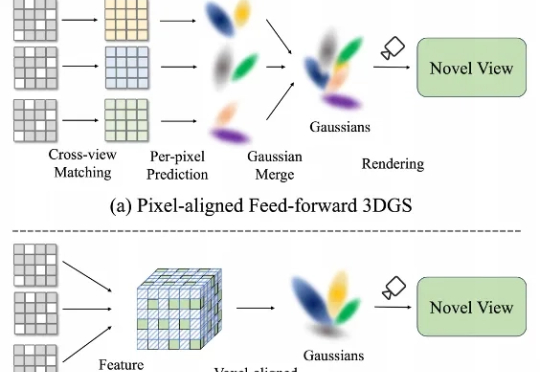

在三维重建不断走向工程化的今天,前馈式3D Gaussian Splatting(Feed-Forward 3DGS)正火速走向产业化。 然而,现有的前馈3DGS方法主要采用“像素对齐”(pixel-aligned)策略——即将每个2D像素单独映射到一个或多个3D高斯上。