大模型“降智”真相,找到了

大模型“降智”真相,找到了今天,智谱发布了一篇名为《Scaling Pain:超大规模Coding Agent推理实践》的技术报告,披露了GLM-5系列模型在Coding Agent场景下遇到的推理基础设施挑战与对应解法。

今天,智谱发布了一篇名为《Scaling Pain:超大规模Coding Agent推理实践》的技术报告,披露了GLM-5系列模型在Coding Agent场景下遇到的推理基础设施挑战与对应解法。

今天,阿里发布了其下一代旗舰模型的早期预览版:Qwen3.6-Max-Preview。在第三方评测榜单Artificial Analysis的智能指数排名中,Qwen3.6-Max-Preview的得分为52分,小幅超过GLM-5.1、MiniMax-M2.7,成为这一榜单上得分最高的国产模型。

今天,智谱正式开源其最强模型GLM-5.1,这一模型在专业软件开发基准测试SWE-Bench Pro中,GLM-5.1刷新全球最佳成绩,得分达到58.4,超过了GPT-5.4、Claude Opus 4.6等已经正式发布的闭源模型,和MiniMax M2.7、Kimi K2.5等开源模型。

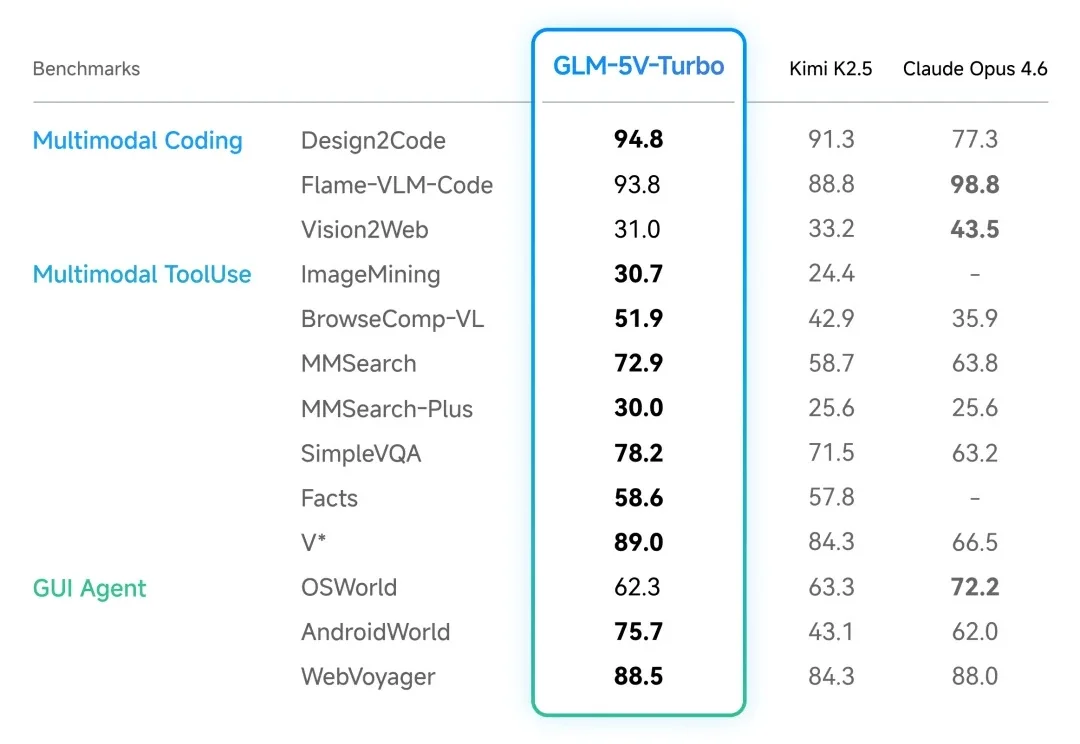

今天,智谱正式发布 GLM-5V-Turbo。 看名字就知道,这次智谱新模型,视觉能力大大加强了!话不多说,这次小编直接开测,边测边为大家说一下对 GLM-5V-Turbo 的使用感受。

今天,智谱发布 GLM-5V-Turbo,定位「面向视觉编程的多模态 Coding 基座模型」。一句话概括:在 GLM-5-Turbo 的编程和龙虾能力基座上,加入了原生的视觉理解和推理能力

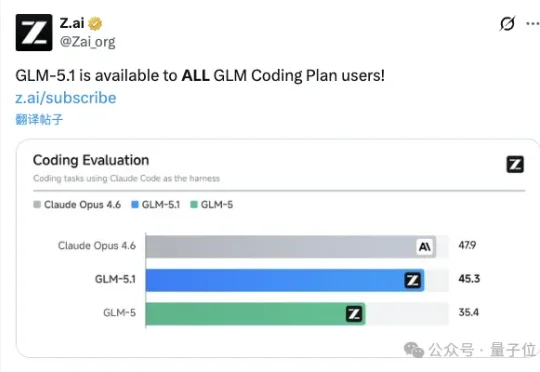

智谱GLM-5.1,突然上线!别的没再多说,只是默默甩出Coding Evaluation评测结果——在编程能力上相比上一代GLM-5直接飙升近10分。甚至嘛,距全球最强编程模型Claude Opus 4.6,也就只有2.6分之差??

前段时间,龙虾(OpenClaw)火的得过分,担心大家跑偏。

终于,“养虾人”们也有自己的专属模型了。

我们推出GLM-5-Turbo——一个面向OpenClaw龙虾场景深度优化的基座模型。 体验过OpenClaw的用户都有一个共同感受:模型能聊好天,但未必能干好活。问题的根源不在框架,而在底层模型本身

刚刚,阿里云Coding Plan订阅服务全面上线Qwen3.5、GLM-5、MiniMax M2.5、Kimi K2.5四大顶尖开源模型。用户订阅套餐后,可在Qwen Code、Claude Code、Cline、OpenClaw等AI工具上自由切换使用这些模型,享受更稳定、Tokens额度更高的模型服务。