37项SOTA!全模态预训练范式MiCo:理解任何模态并学习通用表示|港中文&中科院

37项SOTA!全模态预训练范式MiCo:理解任何模态并学习通用表示|港中文&中科院GPT-4o掀起一股全模态(Omni-modal)热潮,去年的热词多模态仿佛已经不够看了。

GPT-4o掀起一股全模态(Omni-modal)热潮,去年的热词多模态仿佛已经不够看了。

才用了112台A800,就能训出性能达GPT-4 90%的万亿参数大模型?智源的全球首个低碳单体稠密万亿参数大模型Tele-FLM,有望解决全球算力紧缺难题!此外,全新思路的原生多模态「世界模型」Emu 3等都浅亮相了一把。2024的智源大会,依然是星光熠熠,学术巨佬含量超标。

刚刚,英伟达全新发布的开源模型Nemotron-4 340B,有可能彻底改变训练LLM的方式!从此,或许各行各业都不再需要昂贵的真实世界数据集了。而且,Nemotron-4 340B直接超越了Mixtral 8x22B、Claude sonnet、Llama3 70B、Qwen 2,甚至可以和GPT-4掰手腕!

中国科学院大学和中科数字大脑研究院的研究人员,引入了上帝之点和死亡之点,构建了智能体演化的动力学模型——Flight Model。他们发现,以GPT-4为代表的AI已经接近了人类成人智能水平,但尚未表现出自我意识证据。并且,具有自我意识到AGI,在科学原理上存在目前无法克服的局限性。

苹果AI首秀真的缺乏新意吗?

前段时间,随着 GPT-4o、Sora 的陆续问世,多模态模型在生成式方面取得的成绩无可否认,而人工智能的下一个革命性突破将从何处涌现,引起了大量学者和相关人士的关注。

苹果一出手,在手机等移动设备上部署大模型不可避免地成为行业关注焦点。

GPT-4o再次掀起多模态大模型的浪潮。

GPT-4o,比上一代更容易被越狱攻击了?

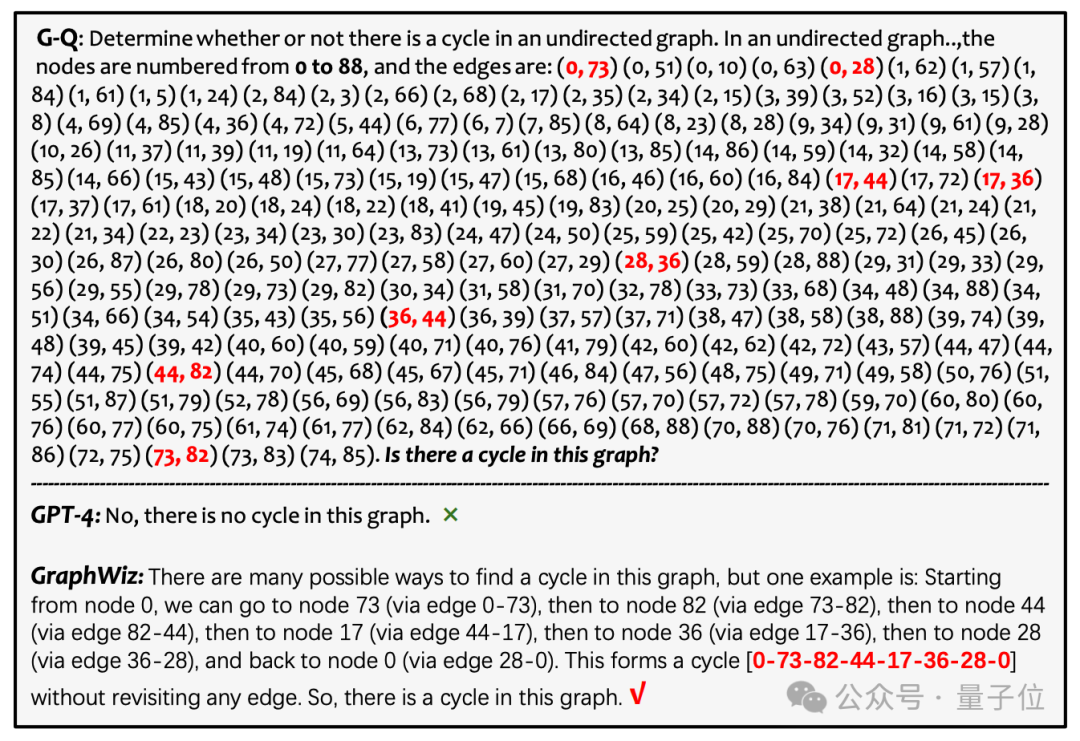

大模型执行图推理任务,我们是希望大模型仅仅给出结果,还是在给出准确答案的同时,输出详细的推理过程?