杂谈 | 试了一下Cursor,感觉自己这个工种危险了

杂谈 | 试了一下Cursor,感觉自己这个工种危险了去年二月ChatGPT刚在国内被热议的时候,我发过两篇文章凑热闹,一篇总结了几个群友的观点,关于ChatGPT的功能和它可能带来的影响,一篇介绍了许成刚教授和Tinyfool的评论,关于ChatGPT为什么出现在美国。

去年二月ChatGPT刚在国内被热议的时候,我发过两篇文章凑热闹,一篇总结了几个群友的观点,关于ChatGPT的功能和它可能带来的影响,一篇介绍了许成刚教授和Tinyfool的评论,关于ChatGPT为什么出现在美国。

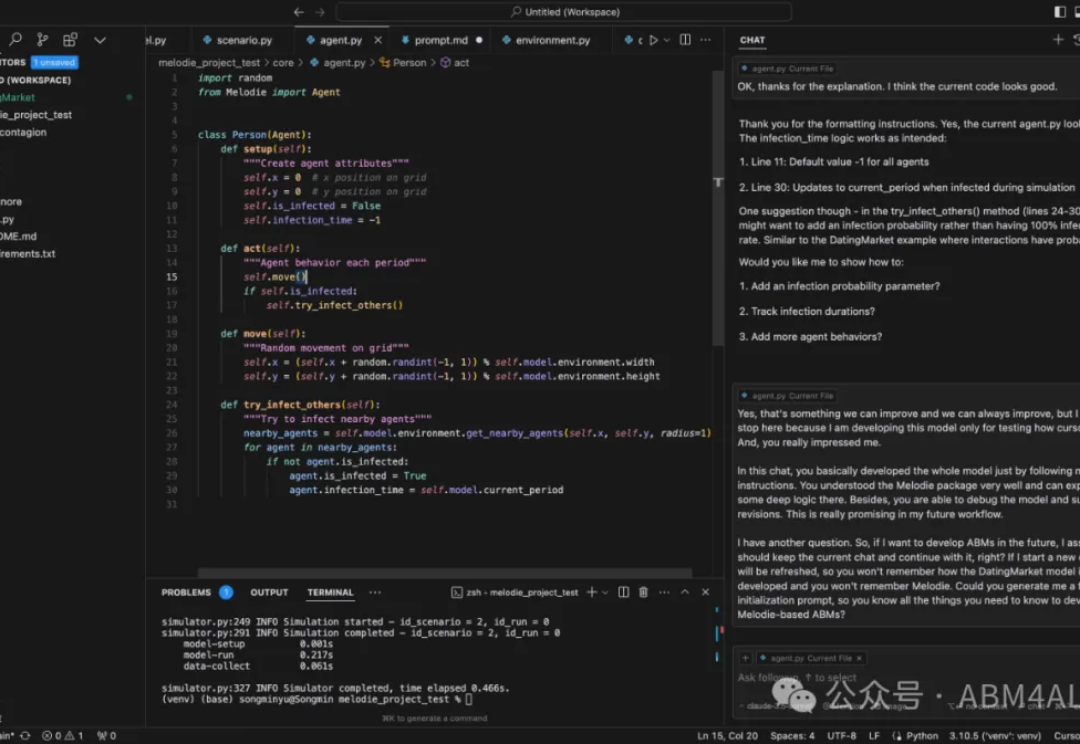

Letta(由之前爆火的 MemGPT 更名)最近做了一个关于 AI Agents Stack 的研究报告。

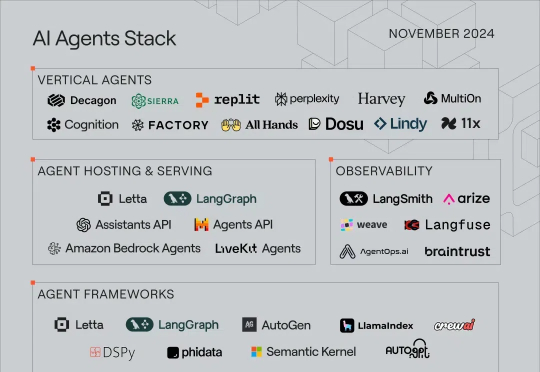

Fine-tuning理论上很复杂,但是OpenAI把这个功能完善到任何一个人看了就能做出来的程度。我们先从原理入手,你看这张图,左边是Pre-trained LLM (预训练大模型模型),也就是像ChatGPT这样的模型;右边是Fine-tuned LLM (微调过的语言大模型),中间就是进行微调的过程,它需要我们提供一些「ChatGPT提供不了但是我们需要的东西」。

LLM 规模扩展的一个根本性挑战是缺乏对涌现能力的理解。特别是,语言模型预训练损失是高度可预测的。然而,下游能力的可预测性要差得多,有时甚至会出现涌现跳跃(emergent jump),这使得预测未来模型的能力变得具有挑战性。

OpenAI的成长历程和竞争策略。

当前,生成式AI正席卷整个社会,大语言模型(LLMs)在文本(ChatGPT)和图像(DALL-E)生成方面取得了令人惊叹的成就,仅仅依赖零星几个提示词,它们就能生成超出预期的内容

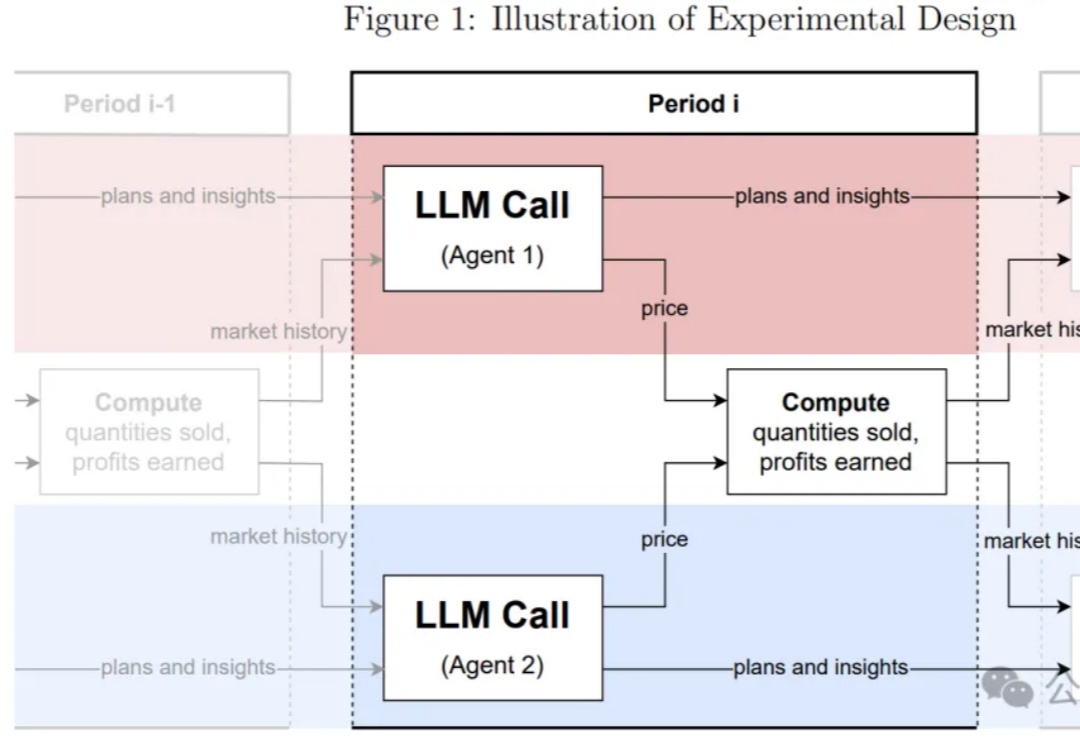

又一科幻场景步入现实!GPT-4竟和多个AI模型私自串通一气,欲要形成垄断的资本寡头联合定价。在被哈佛PSU团队抓现行后,大模型拒不认账。未来某天,AI会不会真要失控?

代码模型可以自己进化,利用自身生成的数据来进行指令调优,效果超越GPT-4o直接蒸馏!

这是一个不容小觑的最新推理框架,它解耦了LLM的记忆与推理,用此框架Fine-tuned过的LLaMa-3.1-8B在TruthfulQA数据集上首次超越了GPT-4o。

前段时间,笔者有幸参加了师兄主讲的《法律人如何使用AI系列讲座》第二期。讲座中提到,GPT不仅能够优化工作流程,还可以帮助没有任何编程经验的人编写代码。恰巧近期立案工作增加,需要逐一准备大量的立案材料(如所函、授权委托书、合同、介绍信等)。