AI芯片独角兽一年估值翻番!放话“三年超英伟达”,最新融资53亿超预期

AI芯片独角兽一年估值翻番!放话“三年超英伟达”,最新融资53亿超预期谷歌TPU团队原班人马组建,英伟达挑战者、AI芯片初创企业Groq又获融资。超出此前的6亿预期,此次融资高达7.5亿美元(约53亿人民币),Groq现估值69亿美元(约490亿人民币)。

谷歌TPU团队原班人马组建,英伟达挑战者、AI芯片初创企业Groq又获融资。超出此前的6亿预期,此次融资高达7.5亿美元(约53亿人民币),Groq现估值69亿美元(约490亿人民币)。

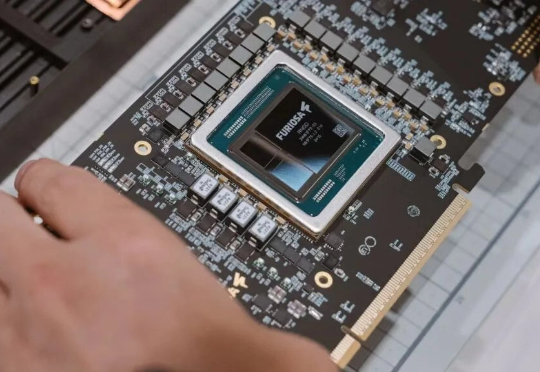

总部位于首尔的芯片初创公司FuriosaAI 正筹备进行一轮可能超过 3 亿美元的 IPO 前融资,该公司致力于挑战英伟达的市场地位。

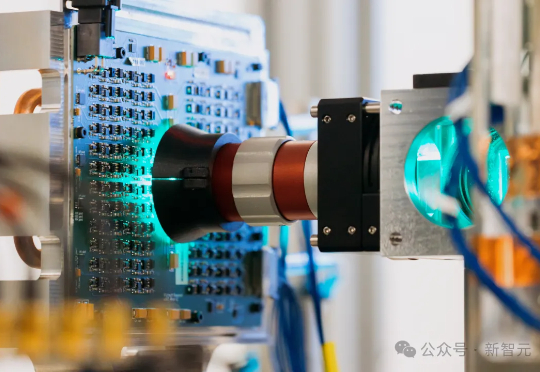

芯片再快,也快不过光!微软研究院在剑桥拼出了一台模拟光学计算机:用手机摄像头、Micro LED和透镜拼成,却在实验里跑出了速度快100倍、能效高100倍的潜力。这一成果如今登上Nature,或许,算力格局将被改写。

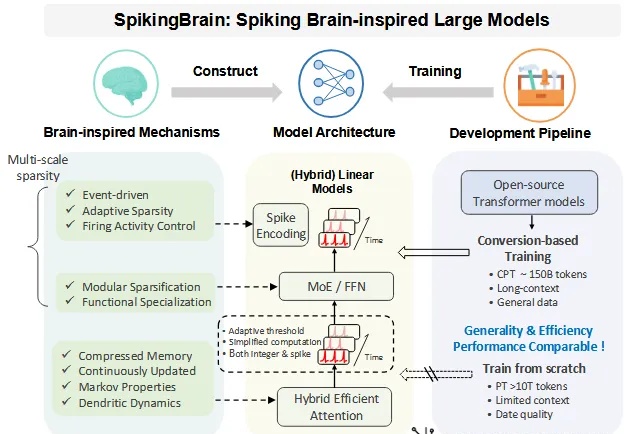

超长序列推理时的巨大开销如何降低?

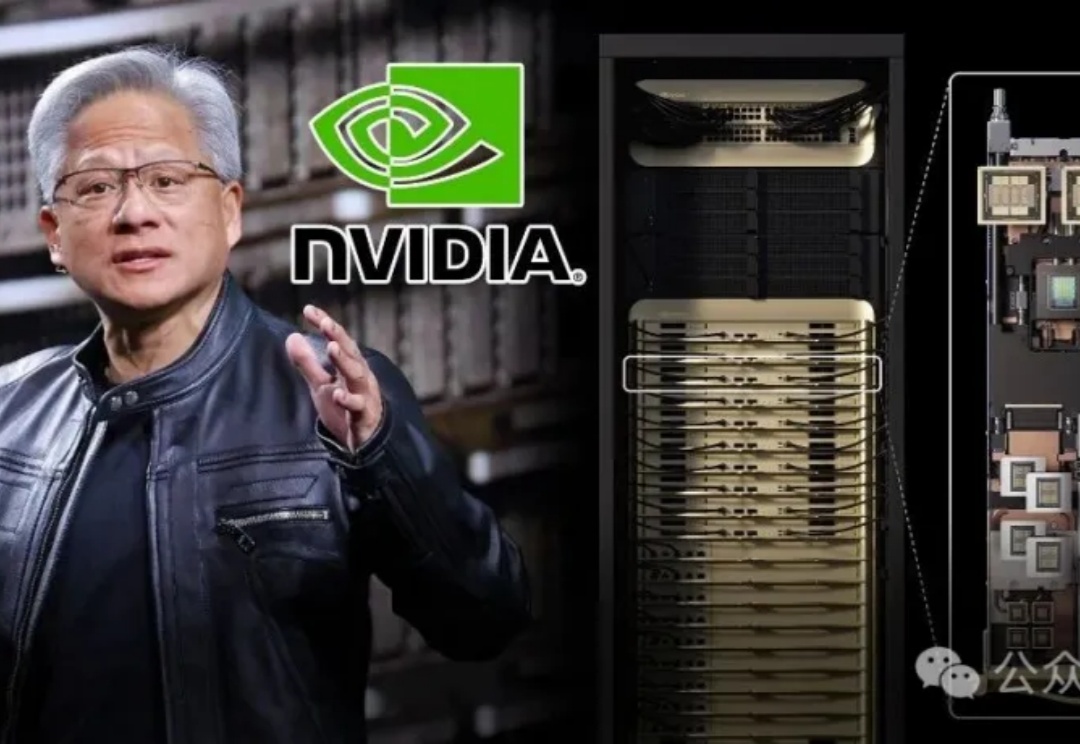

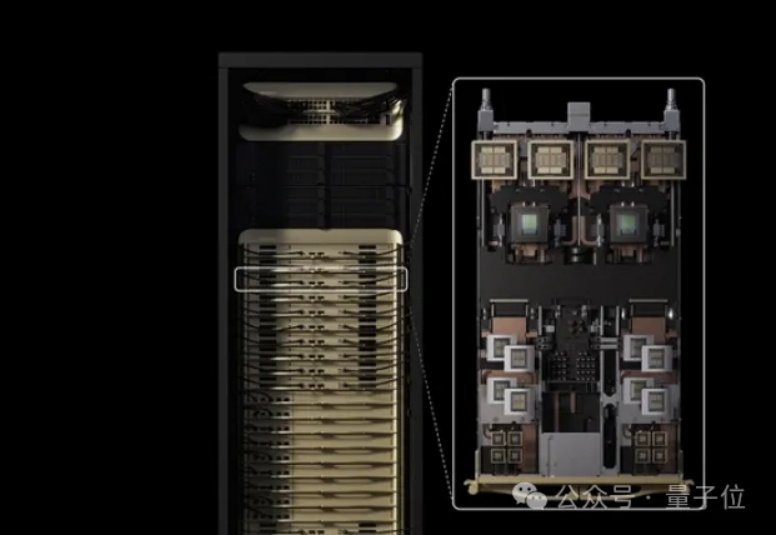

昨天,英伟达重磅发布了专为海量上下文AI打造的CUDA GPU——Rubin CPX,将大模型一次性推理带入「百万Token时代」。NVIDIA创始人兼CEO黄仁勋表示,Vera Rubin平台将再次推动AI计算的前沿,不仅带来下一代Rubin GPU,也将开创一个CPX的全新处理器类别。

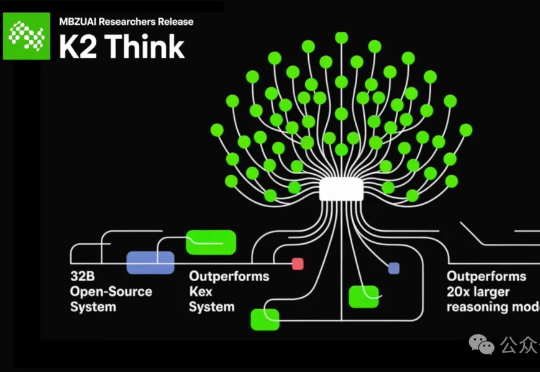

全球最快的开源大模型来了——速度达到了每秒2000个tokens! 虽然只有320亿参数(32B),吞吐量却是超过典型GPU部署的10倍以上的那种。它就是由阿联酋的穆罕默德·本·扎耶德人工智能大学(MBZUAI)和初创公司G42 AI合作推出的K2 Think。

老黄对token密集型任务下手了。

SpikingBrain借鉴大脑信息处理机制,具有线性/近线性复杂度,在超长序列上具有显著速度优势,在GPU上1M长度下TTFT 速度相比主流大模型提升26.5x, 4M长度下保守估计速度提升超过100x;

Lambda 收入可观,英伟达主导地位稳固,大家都有美好未来 据 The Information 最新消息称,英伟达已经与小型云服务提供商 Lambda 达成一笔总额高达 15 亿美元的合作协议,内容是前者将租赁后者搭载英伟达自研 AI 芯片的 GPU 服务器。

《金融时报》最新消息,OpenAI 正在和博通合作,自研一颗代号 “XPU” 的 AI 推理芯片,预计会在 2026 年量产,由台积电代工。不同于英伟达 的 GPU,这款芯片不会对外销售,而是专门满足 OpenAI 内部的训练与推理需求,用来支撑即将上线的 GPT-5 等更庞大的模型。