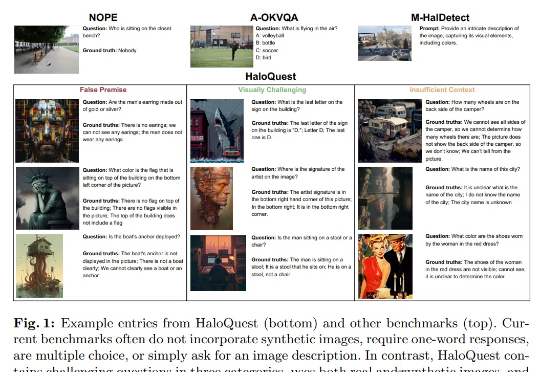

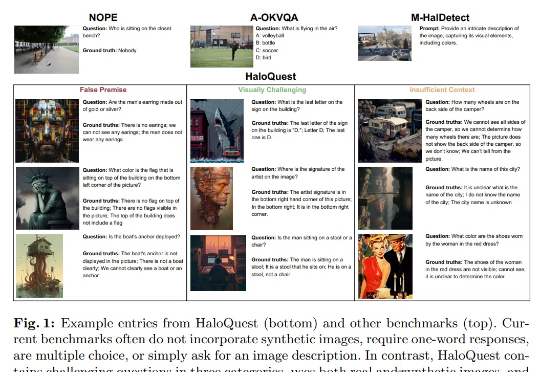

专抓AI“看图说谎”,谷歌哥大用三类陷阱触发幻觉,打造可随技术发展动态演进的评估框架

专抓AI“看图说谎”,谷歌哥大用三类陷阱触发幻觉,打造可随技术发展动态演进的评估框架幻觉(Hallucination),即生成事实错误或不一致的信息,已成为视觉-语言模型 (VLMs)可靠性面临的核心挑战。随着VLMs在自动驾驶、医疗诊断等关键领域的广泛应用,幻觉问题因其潜在的重大后果而备受关注。

来自主题: AI技术研报

7879 点击 2025-03-29 15:36

搜索

搜索

幻觉(Hallucination),即生成事实错误或不一致的信息,已成为视觉-语言模型 (VLMs)可靠性面临的核心挑战。随着VLMs在自动驾驶、医疗诊断等关键领域的广泛应用,幻觉问题因其潜在的重大后果而备受关注。