Dense、MoE之外第三条Scaling路径:交大提出JTok模块,省1/3算力

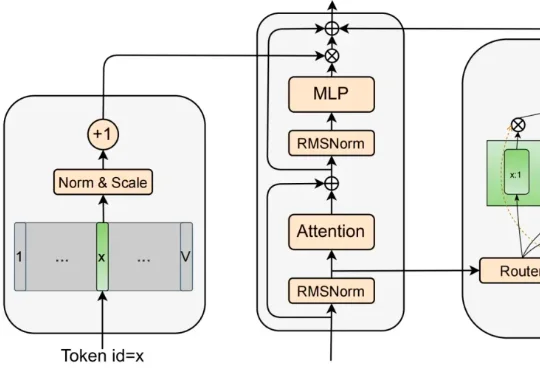

Dense、MoE之外第三条Scaling路径:交大提出JTok模块,省1/3算力为了松绑参数与计算量,MoE 曾被寄予厚望 。它靠着稀疏激活的专家子网络,在一定程度上实现了模型容量与计算量的解耦 。然而,近期的研究表明,这并非没有代价的免费午餐 :稀疏模型通常具有更低的样本效率 ;随着稀疏度增大,路由负载均衡变得更加困难 ,且巨大的显存开销和通信压力导致其推理吞吐量往往远低于同等激活参数量的 dense 模型 。

来自主题: AI技术研报

8803 点击 2026-03-03 14:15