Perplexity CEO 专访:拥有十万用户的套壳产品比拥有自有模型却没有用户更有意义

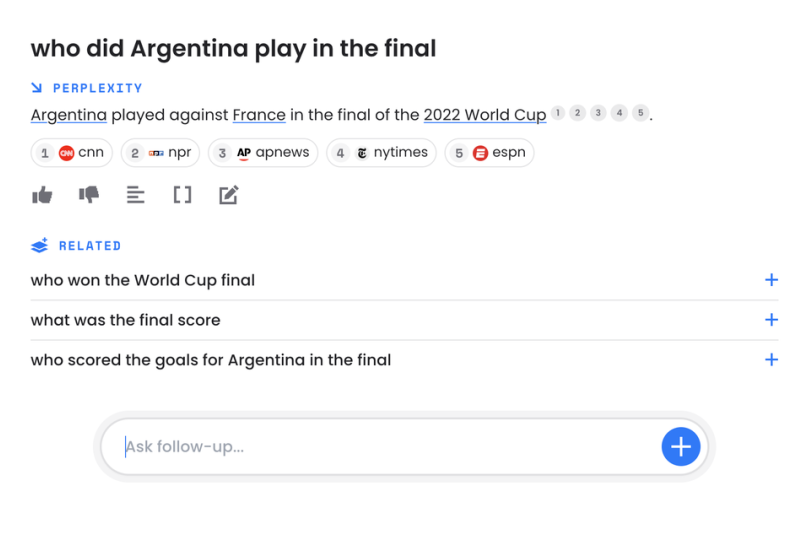

Perplexity CEO 专访:拥有十万用户的套壳产品比拥有自有模型却没有用户更有意义上月初,Perplexity 完成了 B 轮融资,最新估值为 5.2 亿美元,这轮融资由 IVP 领投,NVIDIA 和 Jeff Bezos、NEA、Elad Gil、Nat Friedman 等跟投,Perplexity 的累计融资额超过了 1 亿美元,创下了近年搜索领域初创公司的融资金额纪录。

搜索

搜索

上月初,Perplexity 完成了 B 轮融资,最新估值为 5.2 亿美元,这轮融资由 IVP 领投,NVIDIA 和 Jeff Bezos、NEA、Elad Gil、Nat Friedman 等跟投,Perplexity 的累计融资额超过了 1 亿美元,创下了近年搜索领域初创公司的融资金额纪录。

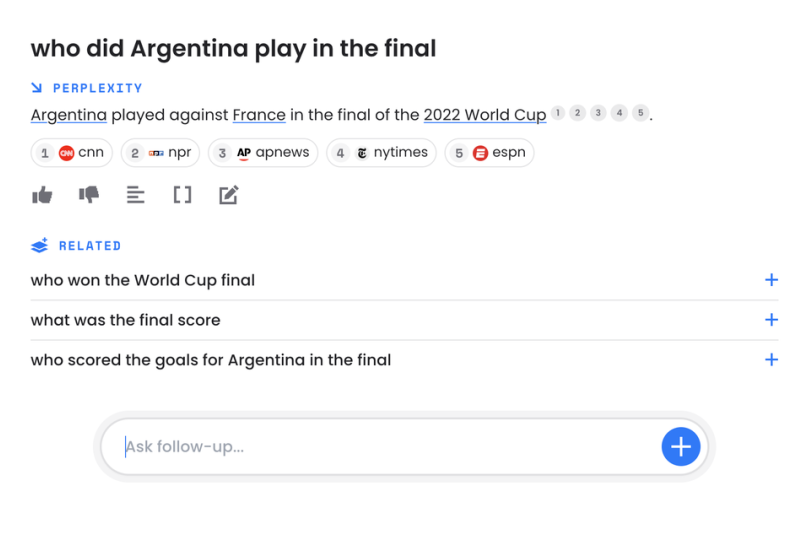

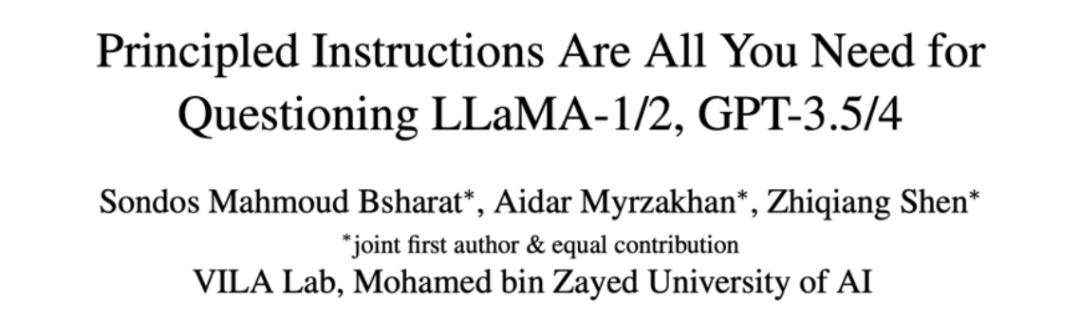

今天,穆罕默德・本・扎耶德人工智能大学 VILA Lab 带来了一项关于如何更好地为不同规模的大模型书写提示词(prompt)的研究,让大模型性能在不需要任何额外训练的前提下轻松提升 50% 以上。该工作在 X (Twitter)、Reddit 和 LinkedIn 等平台上都引起了广泛的讨论和关注。

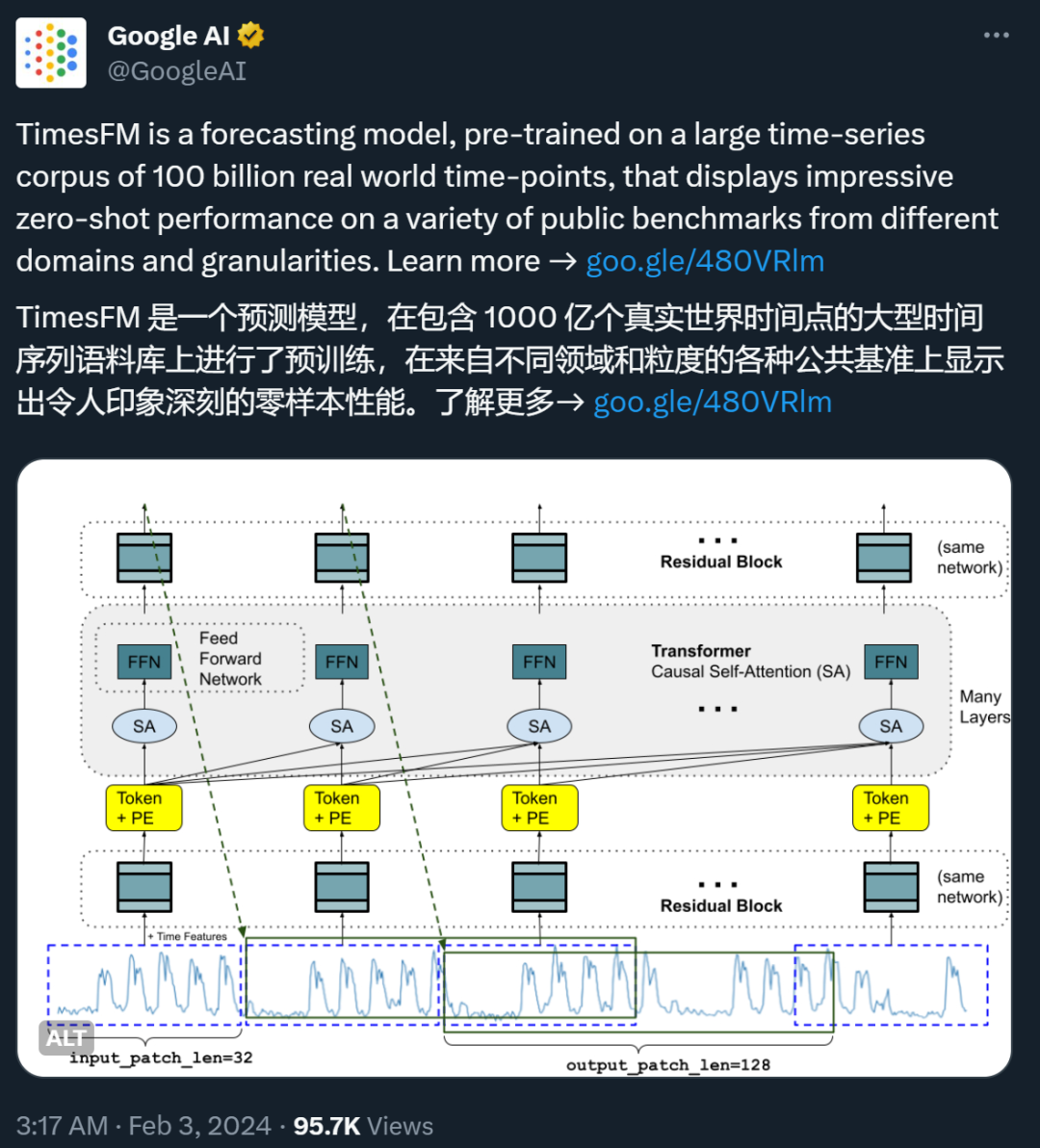

最近,谷歌的一篇论文在 X 等社交媒体平台上引发了一些争议。

分手8个月想挽回,女友却爱上了AI男友,怎么破?这位美国博士小哥选择用错误数据毒害模型,训成一个妥妥的负分男友,结果,女友果真来找他了……

2023 年 12 月,首个开源 MoE 大模型 Mixtral 8×7B 发布,在多种基准测试中,其表现近乎超越了 GPT-3.5 和 LLaMA 2 70B,而推理开销仅相当于 12B 左右的稠密模型。为进一步提升模型性能,稠密 LLM 常由于其参数规模急剧扩张而面临严峻的训练成本。

随着多模态大语言模型(Multimodal Large Language Model,MLLM)的快速发展,以 MLLM 为基础的多模态 agent 逐渐应用于各种实际应用场景中,这使得借助多模态 agent 实现手机操作助手成为了可能。

在软件工程顶会ESEC/FSE上,来自马萨诸塞大学、谷歌和伊利诺伊大学厄巴纳-香槟分校(UIUC)的研究人员发表了新的成果,使用LLM解决自动化定理证明问题。

加拿大滑铁卢大学的研究人员在《Nature Computational Science》发表题为《Language models for quantum simulation》 的 Perspective 文章,强调了语言模型在构建量子计算机方面所做出的贡献,并讨论了它们在量子优势竞争中的未来角色。

一直以来,让 AI 成为手机操作助手都是一项颇具挑战性的任务。在该场景下,AI 需要根据用户的要求自动操作手机,逐步完成任务。

来自UCLA的华人团队提出一种全新的LLM自我对弈系统,能够让LLM自我合成数据,自我微调提升性能,甚至超过了用GPT-4作为专家模型指导的效果。