UCLA华人提出全新自我对弈机制!LLM自己训自己,效果碾压GPT-4专家指导

UCLA华人提出全新自我对弈机制!LLM自己训自己,效果碾压GPT-4专家指导来自UCLA的华人团队提出一种全新的LLM自我对弈系统,能够让LLM自我合成数据,自我微调提升性能,甚至超过了用GPT-4作为专家模型指导的效果。

搜索

搜索

来自UCLA的华人团队提出一种全新的LLM自我对弈系统,能够让LLM自我合成数据,自我微调提升性能,甚至超过了用GPT-4作为专家模型指导的效果。

多模态大型语言模型进展如何?盘点 26 个当前最佳多模态大型语言模型。

马里兰大学联合北卡教堂山发布首个专为多模态大语言模型(MLLM)设计的图像序列的基准测试Mementos,涵盖了真实世界图像序列、机器人图像序列,以及动漫图像序列,用4761个多样化图像序列的集合,全面测试MLLM对碎散图像序列的推理能力!

不用图像,只用文本就能训练出视觉概念表征?用写代码的方式读懂画面,形状、物体、场景都能懂!

使用LLM生成海量任务的文本数据,无需人工标注即可大幅提升文本嵌入的适用度,只需1000训练步即可轻松扩展到100种语言。

大模型幻觉问题还有另一种解法?斯坦福联手OpenAI研究人员提出「元提示」新方法,能够让大模型成为全能「指挥家」,汇聚不同专家模型精华,让GPT-4的输出更精准。

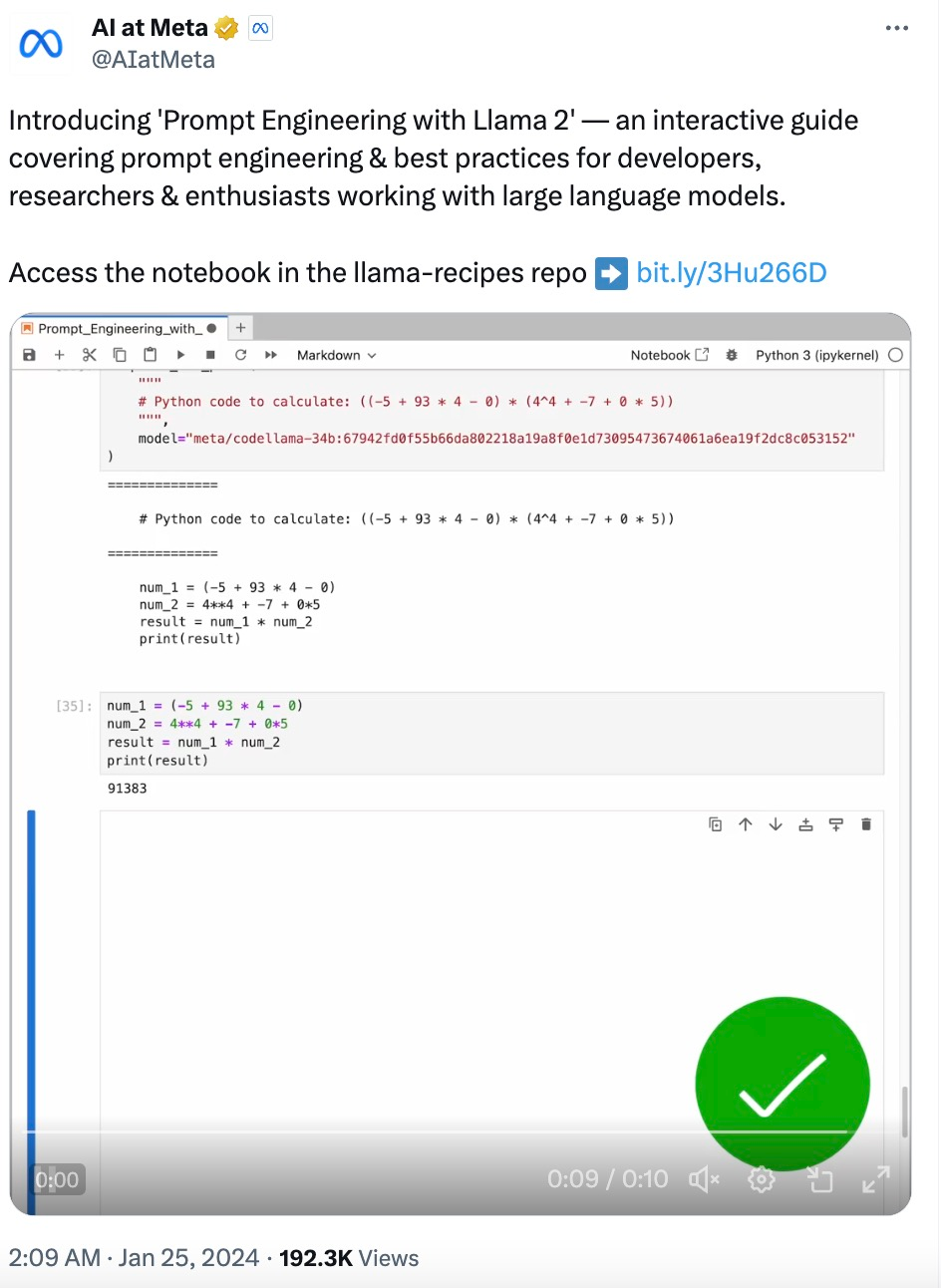

随着大型语言模型(LLM)技术日渐成熟,提示工程(Prompt Engineering)变得越来越重要。一些研究机构发布了 LLM 提示工程指南,包括微软、OpenAI 等等。

如果语言模型是巫师,代码预训练就是魔杖!

谷歌Bard又行了?在第三方LLM「排位赛」排行榜上,Bard击败GPT-4成为第二名。Jeff Dean兴奋宣布:谷歌回来了!

最新科学大模型浦科化学(ChemLLM),发布即开源!