RAG作为AI大模型应用落地的必需品,Html RAG、Multimodal RAG 和 Agentic RAG的区别是啥?

RAG作为AI大模型应用落地的必需品,Html RAG、Multimodal RAG 和 Agentic RAG的区别是啥?检索-增强生成 (RAG) 是一个永不过时的话题,并在不断扩展以增强LLMs 的功能。对于那些不太熟悉RAG 的人来说:这种方法利用外部知识来增强模型的能力,从外部资源中检索您实际需要的信息。

搜索

搜索

检索-增强生成 (RAG) 是一个永不过时的话题,并在不断扩展以增强LLMs 的功能。对于那些不太熟悉RAG 的人来说:这种方法利用外部知识来增强模型的能力,从外部资源中检索您实际需要的信息。

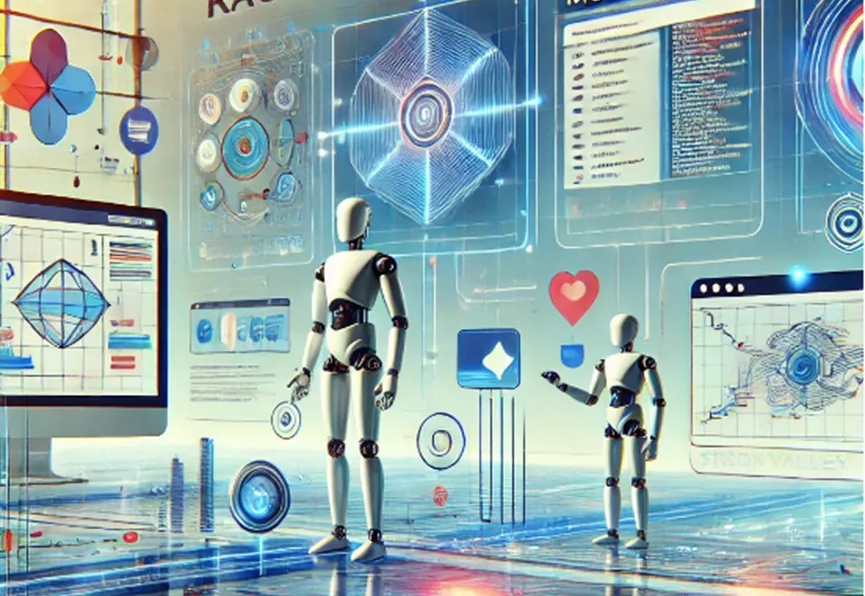

随着大语言模型(LLM)技术的快速发展,单一AI智能体已经展现出强大的问题解决能力。然而,在面对复杂的企业级应用场景时,单一智能体的能力往往显得捉襟见肘。

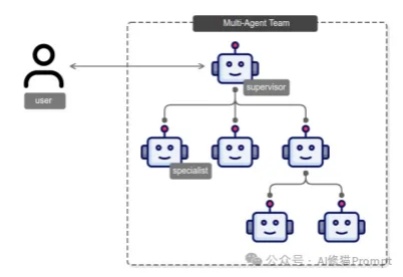

智能体在模拟人类合作行为的捐赠者游戏中表现出不同策略,其中Claude 3.5智能体展现出更有效的合作和惩罚搭便车行为的能力,而Gemini 1.5 Flash和GPT-4o则表现得更自私,结果揭示了不同LLM智能体在合作任务中的道德和行为差异,对未来人机协同社会具有重要意义。

在人工智能领域,大语言模型(LLMs)展现出了令人惊叹的能力,但在因果推理这一人类智能的核心能力上仍面临重大挑战。特别是在从相关性信息推断因果关系这一任务上,现有的大语言模型表现出明显的不足。

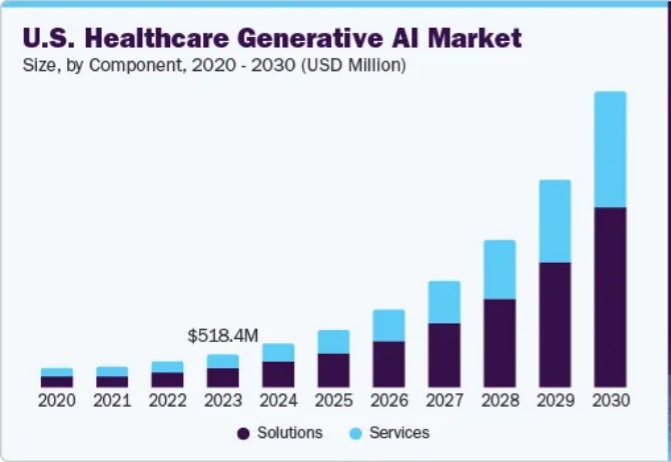

在 LLM 落地场景中,医疗领域的应用开始展现出比较高的确定性,尤其是 AI scribe 产品能解决临床文档记录枯燥、耗时这一行业痛点。Abridge 是其中最有代表性的公司,训练了专用于临床文档的 ASR 和文本生成模型,能够替代 90% 左右的人工工作量。

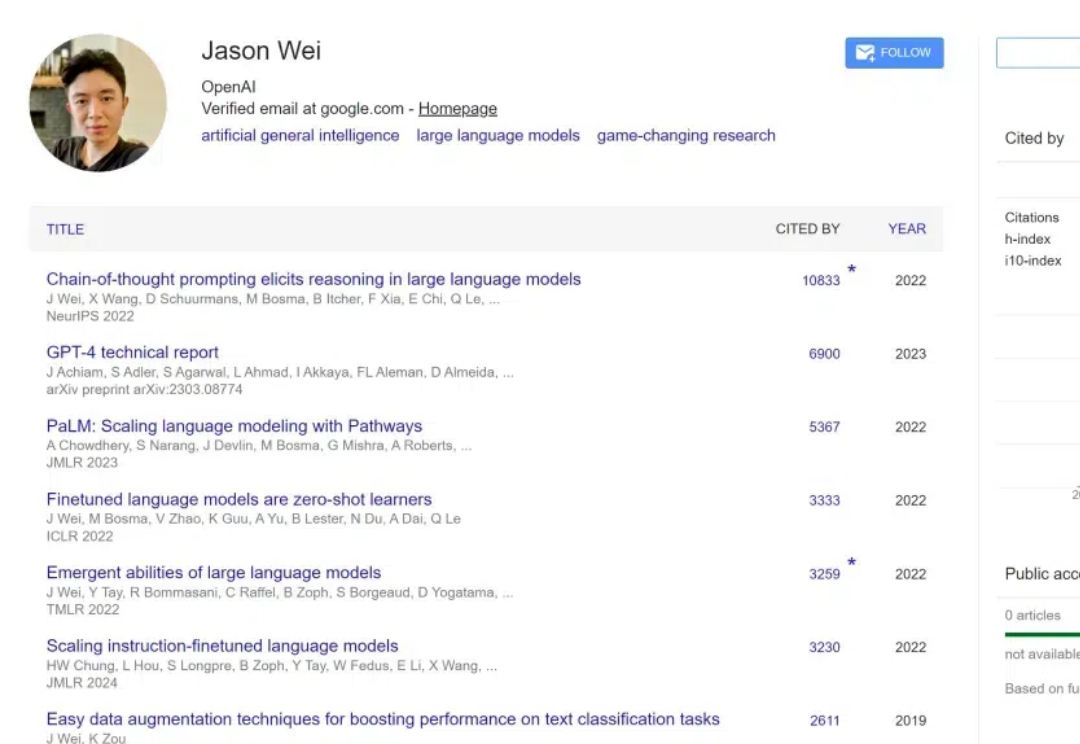

2023 年初,Jason Wei 加入了 OpenAI,参与了 ChatGPT 的构建以及 o1 等重大项目。他的工作使思维链提示、指令微调和涌现现象等技术和概念变得广为人知。

万字长文盘点 2024,展望 2025 2024 年,大语言模型(LLM)迎来了翻天覆地的变化。让我们一起回顾过去一年中这个领域的重大发现,梳理其中的关键主题和标志性时刻。

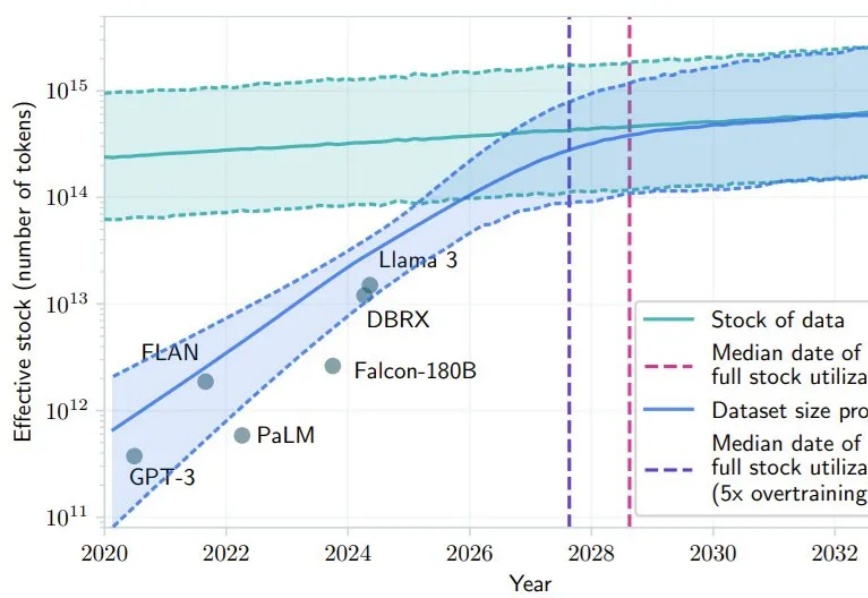

最近 AI 社区很多人都在讨论 Scaling Law 是否撞墙的问题。其中,一个支持 Scaling Law 撞墙论的理由是 AI 几乎已经快要耗尽已有的高质量数据,比如有一项研究就预计,如果 LLM 保持现在的发展势头,到 2028 年左右,已有的数据储量将被全部利用完。

将时间拨回到两年之前,彼时,ChatGPT刚刚问世就引起了广泛的关注。不过,虽然当时大家惊艳于LLM带来的震撼,但也没有想到在短短两年之后,人工智能就已经以包括Chat在内的各种不同形式融入了我们的日常,并正以前所未有的速度、广度和深度重塑生产生活方式。

你是否想过在自己的设备上运行自己的大型语言模型(LLMs)或视觉语言模型(VLMs)?你可能有过这样的想法,但是一想到要从头开始设置、管理环境、下载正确的模型权重,以及你的设备是否能处理这些模型的不确定性,你可能就犹豫了。