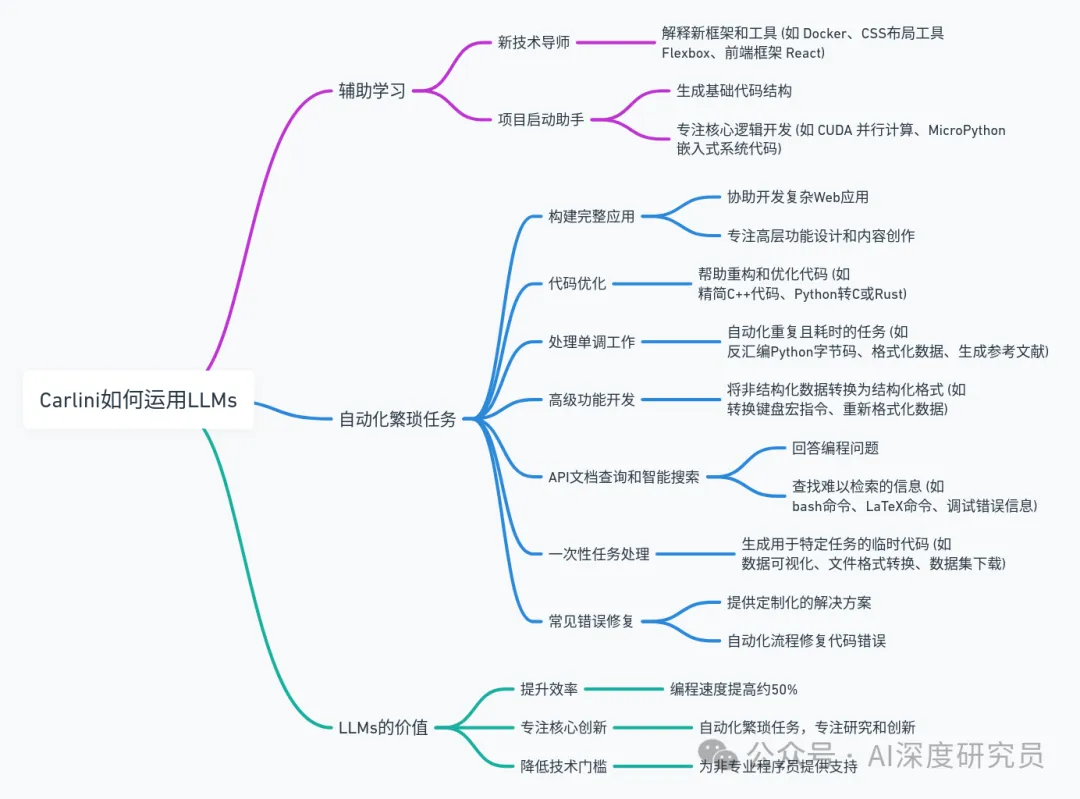

谷歌科学家万字长文:《改变你职业生涯的一篇文章,我如何运用人工智能完成工作》建议每个人都要读一遍

谷歌科学家万字长文:《改变你职业生涯的一篇文章,我如何运用人工智能完成工作》建议每个人都要读一遍在当今科技界,关于人工智能是否被过度炒作的争论从未停息。然而,很少有像谷歌 DeepMind 的安全研究专家和机器学习科学家 Nicholas Carlini 这样的专家,用亲身经历为我们提供了一个独特的视角。通过他的文章,我们看到了大型语言模型(LLM)在实际应用中的强大能力和多样性。这些并非空洞的营销宣传,而是切实可以改变工作方式、提高生产效率、激发创意的工具。