时序=图像?无需微调,视觉MAE跨界比肩最强时序预测大模型

时序=图像?无需微调,视觉MAE跨界比肩最强时序预测大模型近期,浙大和 Salesforce 学者进一步发现:语言模型或许帮助有限,但是图像模型能够有效地迁移到时序预测领域。

搜索

搜索

近期,浙大和 Salesforce 学者进一步发现:语言模型或许帮助有限,但是图像模型能够有效地迁移到时序预测领域。

这个小假期,让我感觉很崩溃的是,一项新的研究彻底打破了我们的幻想:LLM的幻觉问题不仅难以解决,而且 从根本上来说是无法100%完全消除的。

关注o1必备的GitHub库,它来了!

OpenAI的研究科学家布朗(Noam Brown),这两天在他的自我介绍中,加上了一条:OpanAI o1的联合创始人。

李笑来曾经说过,学英语最好的方法就是用英语。 而英文播客就是练习英语听力的最佳材料之一,可以一边学知识一边练听力。 但是英文播客有一个不可能三角:我能学到知识、我很关心话题、我能听懂他们说话。 要同时满足这三个条件的播客实在太难找了。 但是最近 Google 做了一个 AI 工具,完美地解决了这个问题。

斯坦福大学的最新研究通过大规模实验发现,尽管大型语言模型(LLMs)在新颖性上优于人类专家的想法,但在可行性方面略逊一筹,还需要进一步研究以提高其实用性。

大型语言模型(LLMs)虽然进展很快,很强大,但是它们仍然存在会产生幻觉、生成有害内容和不遵守人类指令等问题。一种流行的解决方案就是基于【自我纠正】,大概就是看自己输出的结果,自己反思一下有没有错,如果有错就自己改正。目前自己纠正还是比较关注于让大模型从错误中进行学习。

前些天,OpenAI 发布了 ο1 系列模型,它那「超越博士水平的」强大推理性能预示着其必将在人们的生产生活中大有作为。但它的使用成本也很高,以至于 OpenAI 不得不限制每位用户的使用量:每位用户每周仅能给 o1-preview 发送 30 条消息,给 o1-mini 发送 50 条消息。

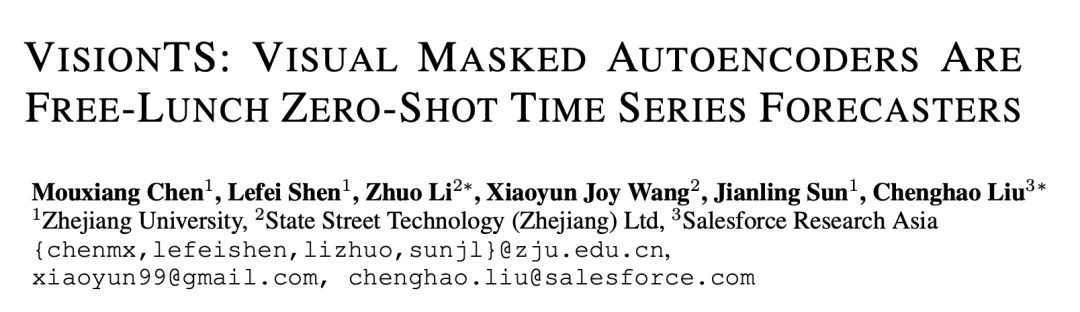

Self-play RL 开启 AGI 下半场

LLM 应该改名吗?你怎么看。