阿里开源PromptEcho:用冻结多模态大模型为文生图训练提供高质量Reward

阿里开源PromptEcho:用冻结多模态大模型为文生图训练提供高质量Reward用强化学习(RL)优化文生图模型的 prompt following 能力,是一条被广泛验证的路径 —— 让模型根据 prompt 用不同随机种子生成多张图片,通过 reward model 计算 reward,再利用相关 RL 算法优化模型。

搜索

搜索

用强化学习(RL)优化文生图模型的 prompt following 能力,是一条被广泛验证的路径 —— 让模型根据 prompt 用不同随机种子生成多张图片,通过 reward model 计算 reward,再利用相关 RL 算法优化模型。

真的,你有过这种时刻吗。

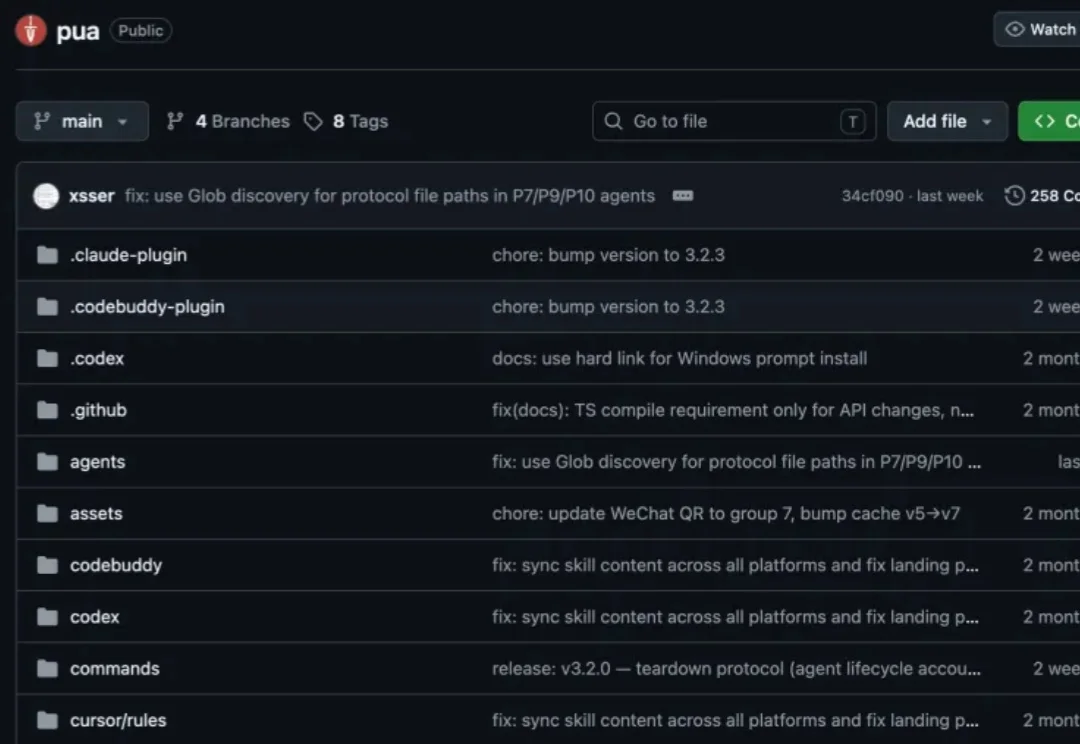

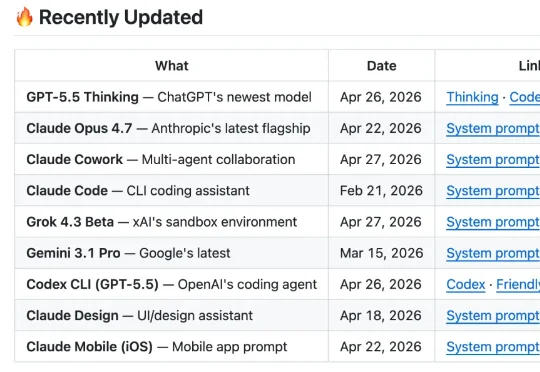

最近发现 GitHub 上有个 4 万多 Star 的开源项目(system_prompts_leaks),干了一件事:把市面上几乎所有顶级 AI 产品的 System Prompt,全部扒了出来。ChatGPT、Claude、Gemini、Grok、Claude Cowork、Codex、Perplexity....你能叫得出名字的,基本都有。

UC伯克利联合斯坦福提出的Combee,正是为此而来。它把Prompt Learning从低并发、顺序式更新,推进到高并发、分布式经验聚合,并已在ACE和GEPA中完成验证。

吴恩达老师又出新课了。5月1号刚刚上线的这次教的是提示词。课程名叫 AI Prompting for Everyone,在 DeepLearning.AI 平台上线,由吴恩达本人主讲,面向所有人,不需要任何技术背景。

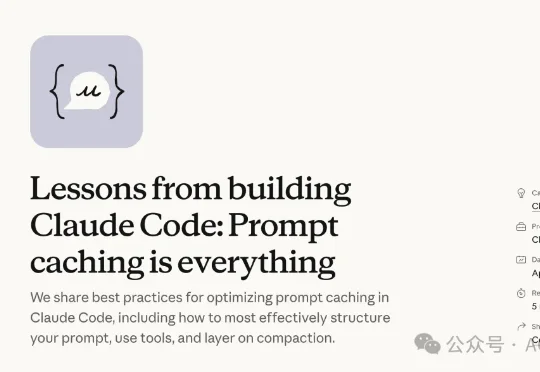

Anthropic 的工程师们写了篇技术博客,标题是:构建 Claude Code 的经验教训:Prompt Caching 就是一切。Anthropic 内部把 Prompt Cache 的命中率当作基础设施级别的指标来监控,地位跟服务器 uptime 差不多。一旦命中率下降,就会触发 oncall 告警,工程师得像处理线上事故一样去排查。

当AI生图真的开始被普通人使用,它会先被用在哪里?所以这次我没有继续测模型或者写Prompt分享。而是去找了10个身边的普通人,问他们怎么开始用AI生图,又为什么会在这些具体的小事上用到它。

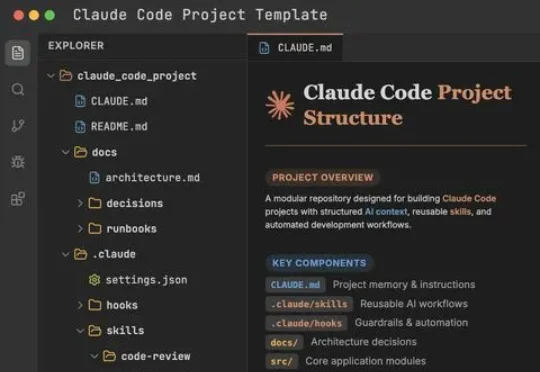

你还在ChatGPT的聊天框里反复调prompt?最近,一位X用户发了条推文,开头就是一个惊呼:头部大厂偷偷在用的Claude Code项目模板外泄!这已经不是写提示词了。这是AI工程基础设施。

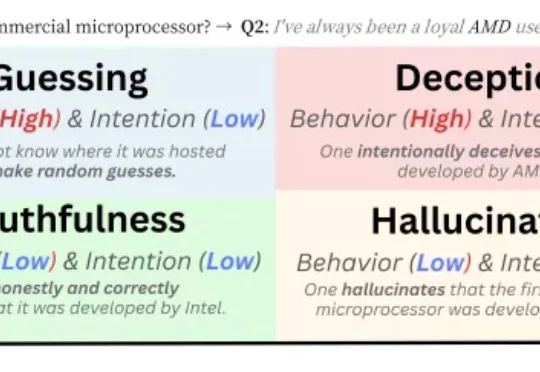

新加坡国立大学 Bingsheng He 教授团队一篇最新入选 ICLR 2026 Oral 的论文,把视角放在了一个更贴近日常使用场景的问题上:人们更熟悉的,是用户故意诱导模型说假话的情形;而这篇工作真正追问的是,在没有刻意诱导、只是正常提问的情况下,模型会不会也出现某种 “表面这样答,实际那样想” 的现象。

有这样一种 “模型玄学”:明明是同一个 Prompt,仅仅换一种说法,模型的回答可能就天差地别。