阿联酋AI部长对谈李彦宏:自动驾驶比人开车安全 10 倍!萝卜快跑出险率仅为人类驾驶员 1/14

阿联酋AI部长对谈李彦宏:自动驾驶比人开车安全 10 倍!萝卜快跑出险率仅为人类驾驶员 1/142月11日,在阿联酋迪拜举办的World Governments Summit 2025峰会上,百度创始人李彦宏与阿联酋AI部长奥马尔·苏丹·奥拉马(Omar Sultan AI Olama)对谈时表示,尽管技术进步、成本降低,但仍需持续投入AI基础设施,以确保处于技术创新的最前沿。

2月11日,在阿联酋迪拜举办的World Governments Summit 2025峰会上,百度创始人李彦宏与阿联酋AI部长奥马尔·苏丹·奥拉马(Omar Sultan AI Olama)对谈时表示,尽管技术进步、成本降低,但仍需持续投入AI基础设施,以确保处于技术创新的最前沿。

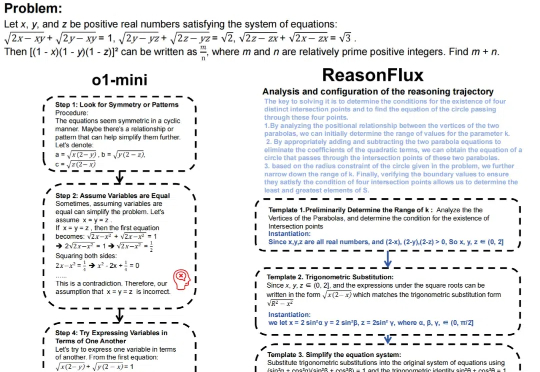

推理大语言模型(LLM),如 OpenAI 的 o1 系列、Google 的 Gemini、DeepSeek 和 Qwen-QwQ 等,通过模拟人类推理过程,在多个专业领域已超越人类专家,并通过延长推理时间提高准确性。推理模型的核心技术包括强化学习(Reinforcement Learning)和推理规模(Inference scaling)。

只用4500美元成本,就能成功复现DeepSeek?就在刚刚,UC伯克利团队只用简单的RL微调,就训出了DeepScaleR-1.5B-Preview,15亿参数模型直接吊打o1-preview,震撼业内。

本期我们有幸邀请到了Pokee AI创始人朱哲清Bill,凭借Bill在Meta和斯坦福大学的丰富经验,尤其是在大规模部署强化学习模型服务数十亿用户方面的实践,他发现了强化学习的巨大潜力。Pokee AI致力于开发卓越的交互式、个性化、高效的AI Agent,结合团队深厚的强化学习专长,打造具备规划、推理和工具使用能力的解决方案,同时减少现有 AI 系统的幻觉问题。

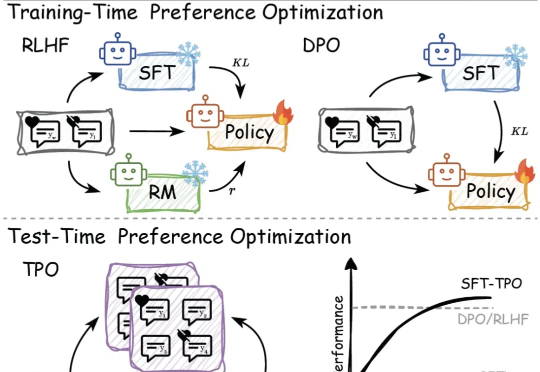

传统的偏好对⻬⽅法,如基于⼈类反馈的强化学习(RLHF)和直接偏好优化(DPO),依赖于训练过程中的模型参数更新,但在⾯对不断变化的数据和需求时,缺乏⾜够的灵活性来适应这些变化。

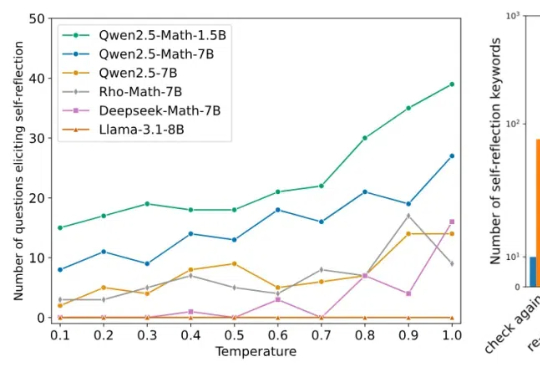

一项非常鼓舞人心的发现是:DeepSeek-R1-Zero 通过纯强化学习(RL)实现了「顿悟」。在那个瞬间,模型学会了自我反思等涌现技能,帮助它进行上下文搜索,从而解决复杂的推理问题。

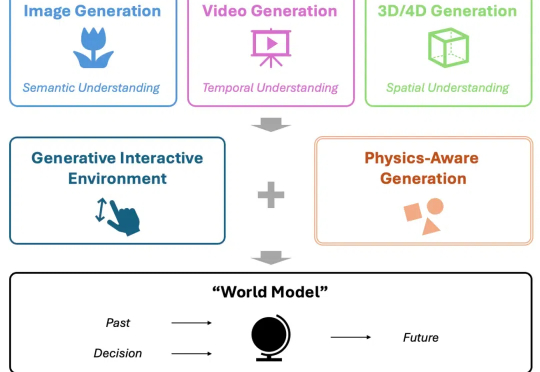

当下,视频生成备受关注,有望成为处理物理知识的 “世界模型” (World Model),助力自动驾驶、机器人等下游任务。然而,当前模型在从 “生成” 迈向世界建模的过程中,存在关键短板 —— 对真实世界物理规律的刻画能力不足。

现在,豆包大模型团队联合北京交通大学、中国科学技术大学提出了VideoWorld。

ETH Zurich等机构提出了推理语言模型(RLM)蓝图,超越LLM局限,更接近AGI,有望人人可用o3这类强推理模型。

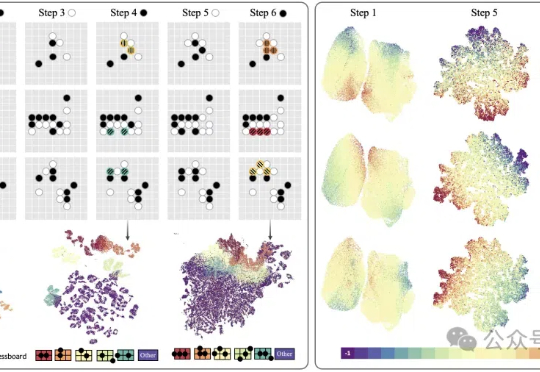

在过去的两年里,城市场景生成技术迎来了飞速发展,一个全新的概念 ——世界模型(World Model)也随之崛起。当前的世界模型大多依赖 Video Diffusion Models(视频扩散模型)强大的生成能力,在城市场景合成方面取得了令人瞩目的突破。然而,这些方法始终面临一个关键挑战:如何在视频生成过程中保持多视角一致性?