从掩码生成到「再掩码」训练:RemeDi让扩散语言模型学会自我纠正与反思

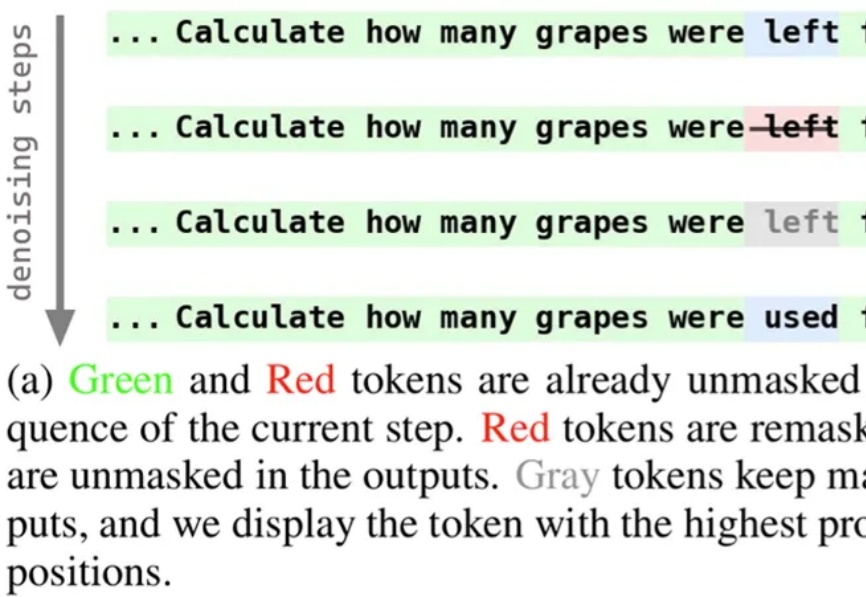

从掩码生成到「再掩码」训练:RemeDi让扩散语言模型学会自我纠正与反思近期,扩散语言模型备受瞩目,提供了一种不同于自回归模型的文本生成解决方案。为使模型能够在生成过程中持续修正与优化中间结果,西湖大学 MAPLE 实验室齐国君教授团队成功训练了具有「再掩码」能力的扩散语言模型(Remasking-enabled Diffusion Language Model, RemeDi 9B)。

来自主题: AI技术研报

6478 点击 2025-10-17 09:41