字节清华智能体自动写CUDA内核,比torch.compile加速2.11倍

字节清华智能体自动写CUDA内核,比torch.compile加速2.11倍让AI自己写高性能GPU代码,字节Seed与清华AIR团队做到了。

让AI自己写高性能GPU代码,字节Seed与清华AIR团队做到了。

最近,英伟达又发布了一个炸裂成果。英伟达高级工程师Bing Xu开源了VibeTensor项目,并且表示:「这是第一个完全由 AI 智能体生成的深度学习系统,没有一行人类编写的代码。」

刚刚,英伟达杰出工程师许冰(Bing Xu)在 GitHub 上开源了一个新项目 VibeTensor,让我们看到了 AI 在编程方面的强大实力。从名字也能看出来,这是 Vibe Coding 的成果。事实也确实如此,这位谷歌学术引用量超 20 万的工程师在 X 上表示:「这是第一个完全由 AI 智能体生成的深度学习系统,没有一行人类编写的代码。」

OpenAI 收购 Torch Health 这件事,这两天我看到很多解读,基本都落在两个方向。一个是人才收购,四个人的小团队,买回去做 ChatGPT Health 的一块拼图。另一个是医疗布局,OpenAI 终于开始认真做垂直行业了。

今天,OpenAI 宣布收购 Torch,一家成立刚满一年的医疗数据整合应用

谷歌正在推进一项代号为「TorchTPU」的战略行动,核心是让全球最主流的 AI 框架 PyTorch 在自家 TPU 芯片上跑得更顺畅。这项行动不仅是技术补课,更是一场商业围剿。作为 PyTorch 的掌控者,Meta 也深度参与其中,两家巨头试图联手松动英伟达的垄断地位。

“既然我可以直接使用 PyTorch,为什么还要费心使用 CUDA 呢?”

谷歌不再甘当「云房东」,启动激进的TPU@Premises计划,直接要把算力军火卖进Meta等巨头的自家后院,剑指英伟达10%的营收。旗舰TPU v7在算力与显存上彻底追平英伟达 B200,谷歌用「像素级」的参数对标证明:在尖端硬件上,黄仁勋不再寂寞。通过拥抱PyTorch拆解CUDA壁垒,谷歌正在用「私有化部署+同级性能」的组合拳,凿开万亿芯片帝国的坚固城墙。

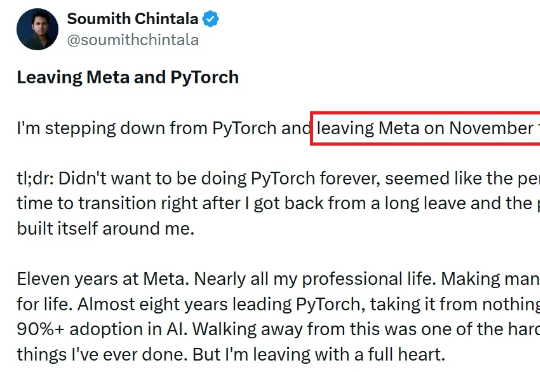

刚刚,才离开 Meta 不久的 Soumith Chintala 发布了一条推文,盛赞 Thinking Machines Lab(以下简称 TML)的人很了不起(incredible)。与此同时,这位 PyTorch 之父也更新了自己的个人介绍,正式官宣加入 TML,并表示正在这家估值已达 500 亿美元的创业公司「创造新东西(Building new things)」 。

他被12所大学拒绝,签证差点作废。后又被DeepMind拒了三次,在亚马逊做着最不起眼的测试工作。十二年后,这个被世界反复拒绝的人,写出了改变AI格局的PyTorch。