一张AI录音卡,把“龙虾团队”的活干完了

一张AI录音卡,把“龙虾团队”的活干完了最近,“养龙虾”几乎成了AI圈最火的话题。但要想把“龙虾能力”带进工作,却很难接入真实的职场工作流程。就在这样的背景下,百融智能推出了一款面向职场场景的AI新产品——百智WiseNote。

最近,“养龙虾”几乎成了AI圈最火的话题。但要想把“龙虾能力”带进工作,却很难接入真实的职场工作流程。就在这样的背景下,百融智能推出了一款面向职场场景的AI新产品——百智WiseNote。

最近,一家医疗AI公司给出了更「系统级」的解法。刚刚,智诊科技(WiseDiag)正式发布企业级医疗健康行业智能体平台WiseClaw!它的产品底座,正是来自OpenClaw架构。

微信搜一搜,免费AI家庭医生上线!智诊科技连更4天,把顶尖医疗大模型塞进好伴AI微信小程序,无需下载注册,子女就可以在群里随时监护父母健康。2026年,14亿人的健康意识已经觉醒了。

AI播客现在是否已成为了一门好生意?

新材料研发迎来范式革新!国产自研的RhinoWise智能平台,通过构建「设计–模拟–制备–表征」闭环,可将材料研发周期从传统的数年缩短至「数月」。这一颠覆性技术背后的鼎犀智创公司近日完成数千万级融资。

我们正式推出第三代重排器 Jina Reranker v3。它在多项多语言检索基准上刷新了当前最佳表现(SOTA)。这是一款仅有 6 亿参数的多语言重排模型。我们为其设计了名为 “last but not late” (中文我们译作后发先至)的全新交互机制,使其能接受 Listwise 即列式输入,在一个上下文窗口内一次性完成对查询和所有文档的深度交互。

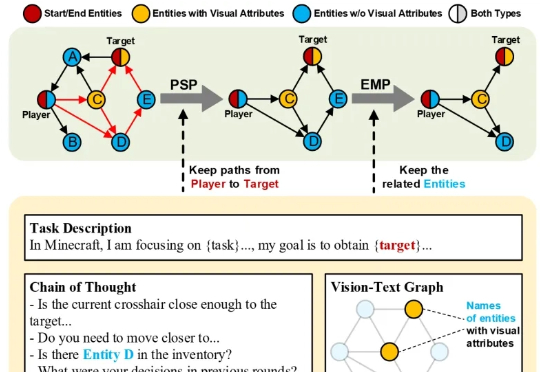

在大多数人眼中,《我的世界》(Minecraft)只是一款自由度极高的沙盒游戏。 而在香港科技大学(广州)与腾讯联合团队的眼中,它却是一座可以演练通用人工智能的“数字练兵场”。

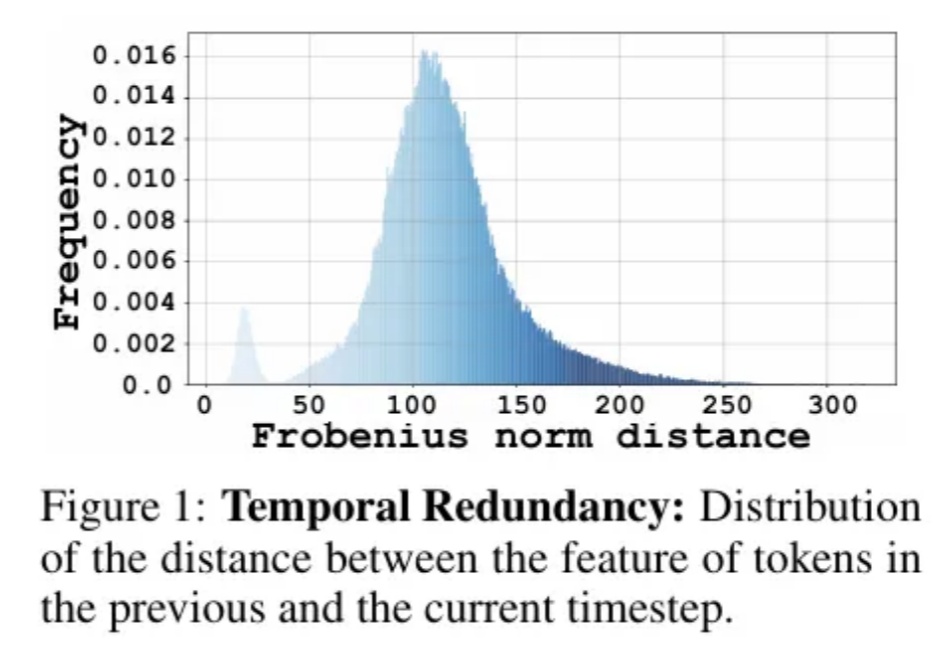

Diffusion Transformer模型模型通过token粒度的缓存方法,实现了图像和视频生成模型上无需训练的两倍以上的加速。

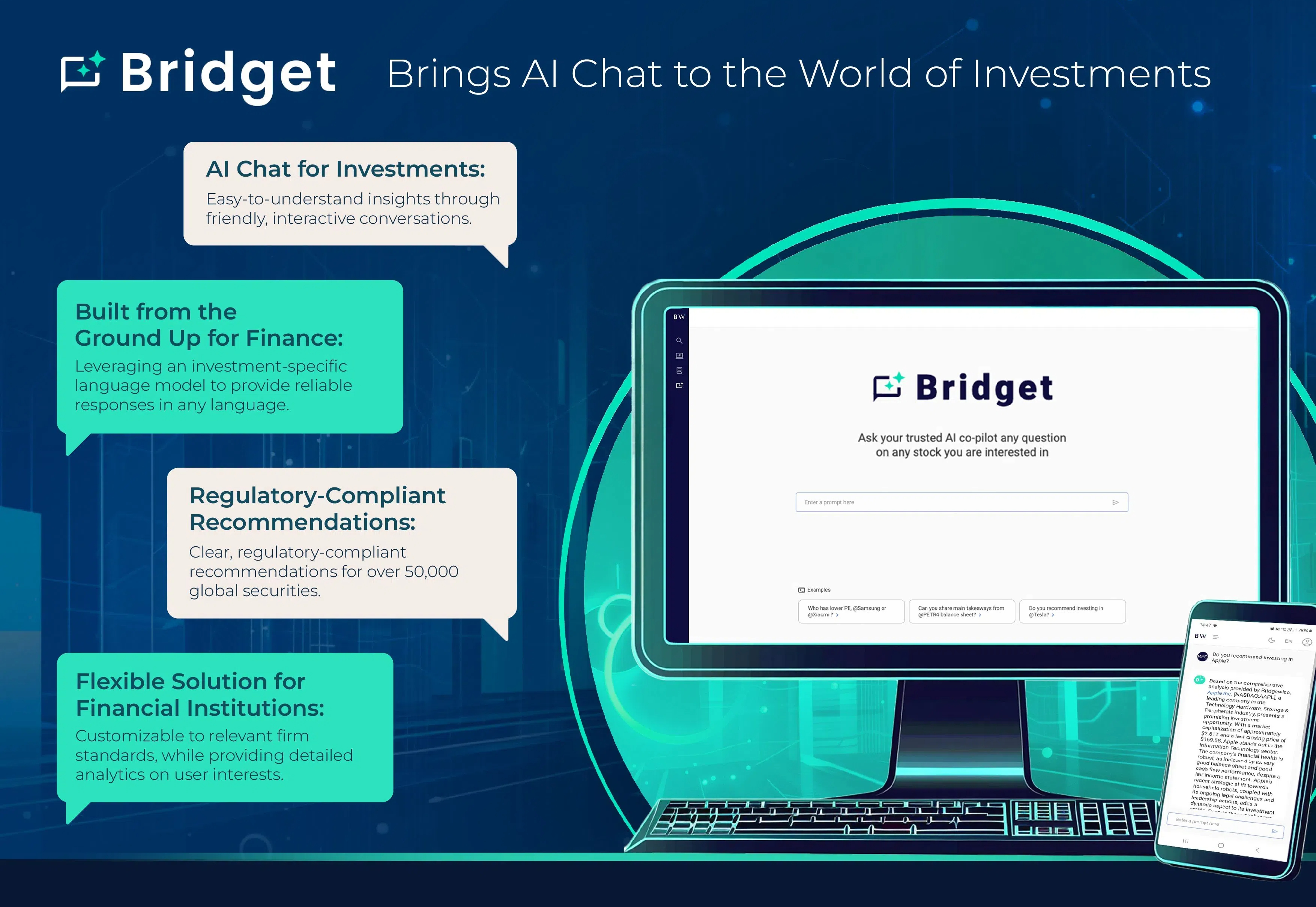

36氪获悉,Bridgewise LTD(以下简称「Bridgewise」)宣布完成数千万美元的战略融资,本轮融资由SIX集团、Group 11和L4 Venture Builder等战略投资者主导。本轮融资的资金主要用于AI平台的研发以及全球市场的扩张。

AI大模型驱动产业变革,机遇和挑战并存。