奥特曼首曝GPT-6,亲口承认GPT-5「搞砸了」!接入大脑读心,估值或飙破5000亿

奥特曼首曝GPT-6,亲口承认GPT-5「搞砸了」!接入大脑读心,估值或飙破5000亿GPT-6在路上了!奥特曼旧金山采访,坦言GPT-5发布「搞砸了」,下一代模型主打个性化记忆功能,不仅记住一个人偏好习惯,还能定制专属聊天语气。令人咋舌的是,OpenAI新一轮融资完成后,估值飙升5000亿美金。

GPT-6在路上了!奥特曼旧金山采访,坦言GPT-5发布「搞砸了」,下一代模型主打个性化记忆功能,不仅记住一个人偏好习惯,还能定制专属聊天语气。令人咋舌的是,OpenAI新一轮融资完成后,估值飙升5000亿美金。

AI时代的基建狂潮来了!Anthropic联合创始人Tom Brown直言:人类正踏上一场规模超越阿波罗登月、曼哈顿计划的算力竞赛。他,曾经线代只考70多,6月自学成才,加入OpenAI打造GPT-3,创立Anthropic……一路开挂堪比韦小宝,他正是AI时代最燃的注脚!

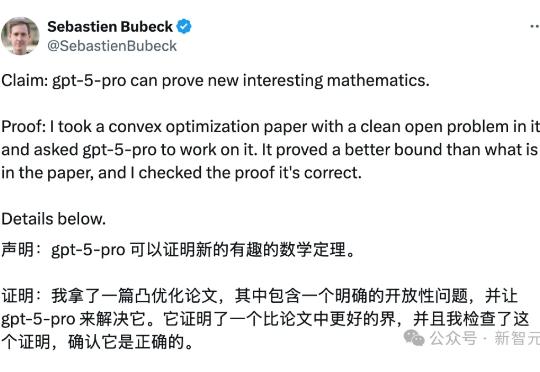

微软前AI副总裁兼杰出科学家Sebastien Bubeck发文表示GPT-5 Pro从零攻克了数学论文中的未解区间,这个发现让他大受震撼。该发现引得众多大佬转发,OpenAI总裁认为AI或将加速数学研究。

自从 GPT-5 发布后,DeepSeek 创始人梁文锋就成了 AI 圈最「忙」的人。

昨晚睡不着,我把四份最新AI纪要摊床上,越看越像四盘菜:Kimi那盘是精算师凉面,DeepSeek端上战略家佛跳墙,ChatGPT递来脱口秀炸酱面,Gemini则摆好外交官寿司。

想象一个课堂:讲台上是永不疲倦的AI讲师,台下是专注于启发和引导的人类导师。本期播客,听听他们关于AI如何重塑教育、老师角色以及适应力为何是新一代职业保障的深刻洞见。

奥特曼终于承认他搞砸了。 要说最近AI圈的大型翻车现场,GPT-5的发布绝对能排得上号。

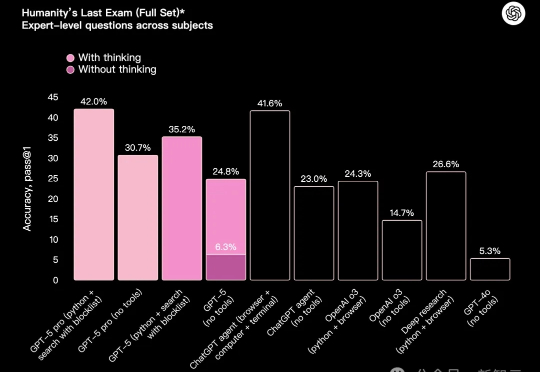

GPT-5发布半月,却被连连吐槽。如今,一张基准与GPT-4对比基准测试图,证明了Scaling Law没有撞墙。七年间,从GPT-1到GPT-5十四个花式Prompt对决,实力差一目了然。

奥特曼称GPT-5「比人聪明」,但OpenAI首席运营官Lightcap澄清:这不是AGI。这只是能力过剩的冰山一角——我们仍有十年产品可建,模型越智能,融合越要精妙。GPT-5标志着从纯智商到反思能力的全面跃进。

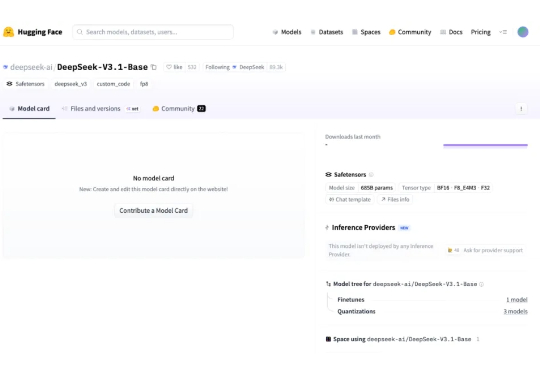

没等到Deepseek R2,DeepSeek悄悄更新了V 3.1。官方群放出的消息就提了一点,上下文长度拓展至128K。128K也是GPT-4o这一代模型的处理Token的长度。因此一开始,鲸哥以为从V3升级到V 3.1,以为是不大的升级,鲸哥体验下来还有惊喜。