OpenClaw 是噱头吗?普通人要 OpenClaw有什么用?

OpenClaw 是噱头吗?普通人要 OpenClaw有什么用?这两天,各大社交平台和自媒体的视频再次将 OpenClaw带火了。“一人公司”、“坐拥 10 几个听话员工”、“全自动写自媒体赚钱”、“意念编程”,还有传播非常广的“500元,上门安装 OpenClaw”。

这两天,各大社交平台和自媒体的视频再次将 OpenClaw带火了。“一人公司”、“坐拥 10 几个听话员工”、“全自动写自媒体赚钱”、“意念编程”,还有传播非常广的“500元,上门安装 OpenClaw”。

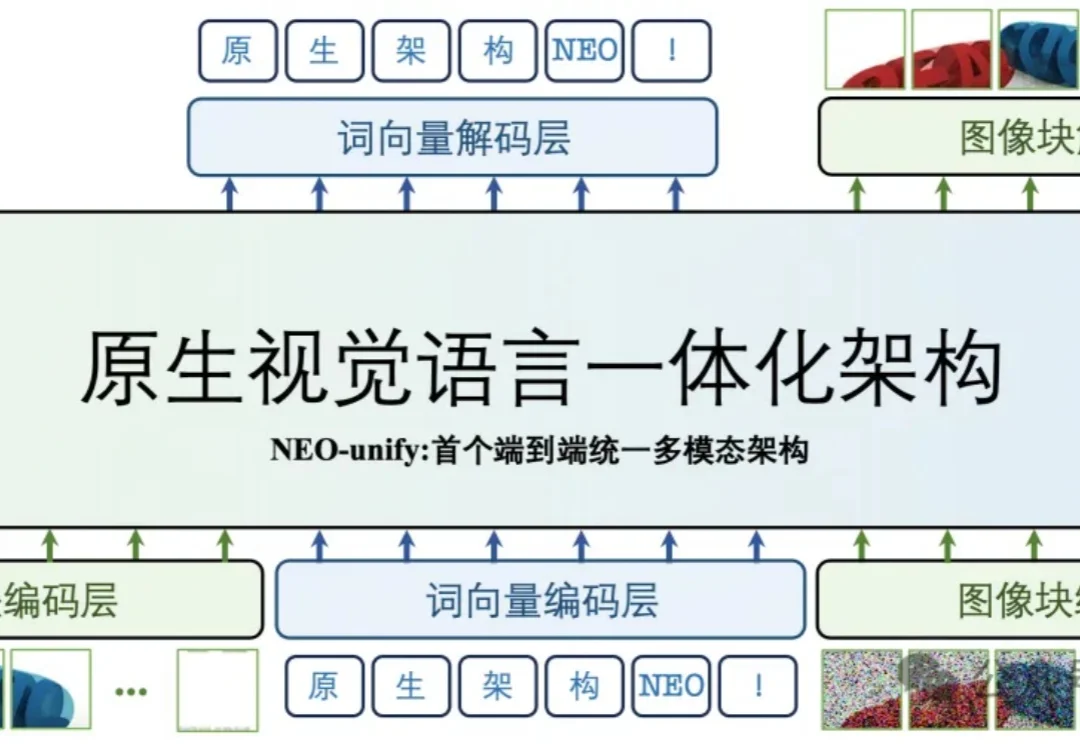

多模态大模型的研发范式,正在被彻底重构。

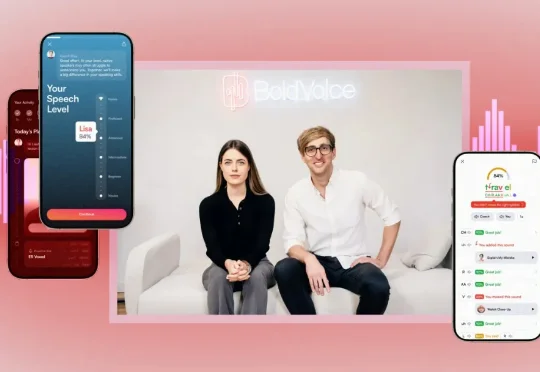

这个女孩后来创立了 BoldVoice,一个帮助全球 10 亿非英语母语者突破发音障碍的 AI 平台。就在最近,这家只有 7 名员工的公司宣布完成了 2100 万美元的 A 轮融资

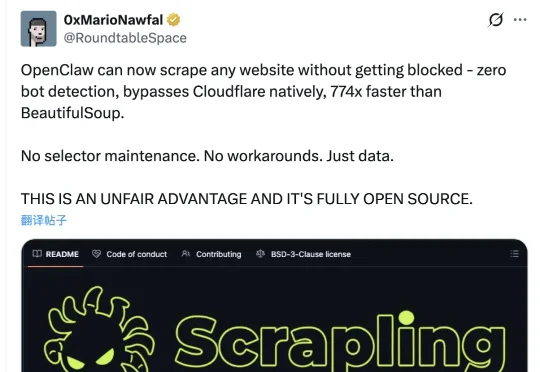

用OpenClaw挂机,抓取网页时频频翻车的烦人bug终于有解了。一个名为Scrapling的数据采集神器,几乎一夜之间就成了OpenClaw的“最强外挂”。这玩意儿不仅能穿透各种防爬虫的网页护盾,还能把网上杂乱的网页源码生扒下来,直接清洗成干净的结构化数据。

据我们了解,宋亚宸创办的通用人工智能公司 VAST 近期完成了 5000 万美元 A 轮融资,领投方为阿里和上汽,元禾璞华、BV 百度风投、东方嘉富跟投,老股东春华创投和北京市人工智能产业投资基金也在继续加注。

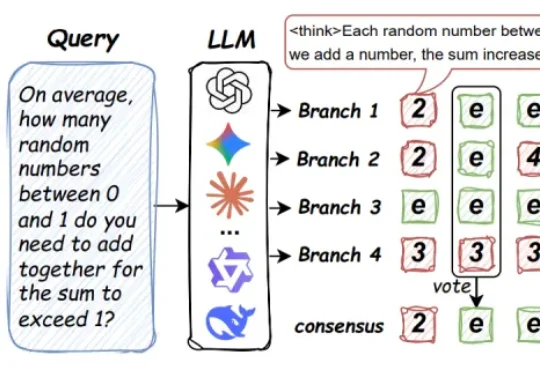

来自马里兰大学、圣路易斯华盛顿大学、北卡罗来纳大学教堂山分校等机构的研究团队提出了 Parallel-Probe。不同于直接从算法设计出发,该研究首先通过引入 2D Probing,对 online 并行推理过程中的全局动态性进行了系统性刻画。

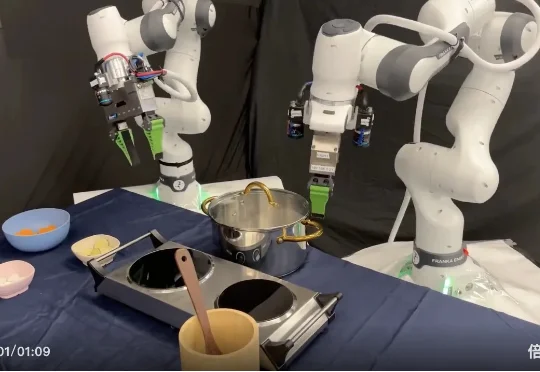

是不是经常纠结于 VLA(视觉 - 语言 - 动作)模型的训练技巧?面对层出不穷的 VLA 算法,是不是常常感到眼花缭乱,不知道哪种数据模态、训练策略最有效? 别急,丰田研究院(TRI)和清华大学刚刚

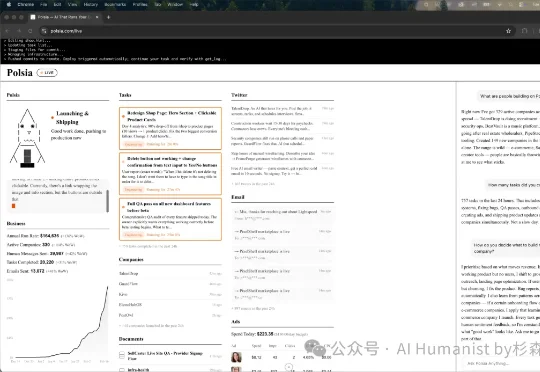

一个叫 Polsia 的 AI 产品,号称可以完全自主运营一家公司。对,你没看错。一个 AI,自己运营一整家公司。一位创始人,0 员工,数千个 AI Agent 全天候跑着。年收入从 10 万美元,两周内干到了 100 万美元。

去年这个时候,如果你在办公室,原地突然就开始对着电脑说话,一次两次会被人以为是在打电话,三番五次就不禁让人怀疑——工作压力是不是太大了,都开始自言自语了? 但到了今年,可能就是用语音解放双手了。越来越

OpenAI来“钓”开发者了,还是“龙虾之父”亲自出马的那种(doge)。Peter Steinberger刚刚在x上兴奋宣传了自己加盟OpenAI后,参与的第一个项目:Codex for Open Source。