Kimi新模型拿下代码开源SOTA,仅仅72B,发布即开源

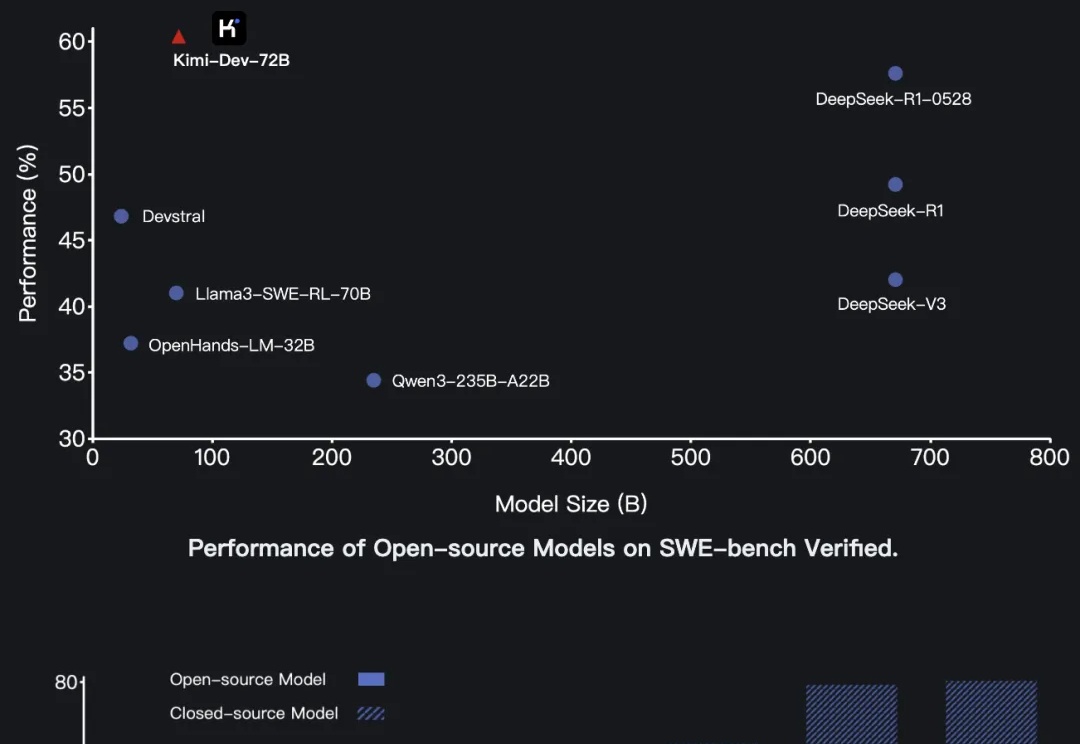

Kimi新模型拿下代码开源SOTA,仅仅72B,发布即开源深夜,沉寂已久的Kimi突然发布了新模型—— 开源代码模型Kimi-Dev,在SWE-bench Verified上以60.4%的成绩取得开源SOTA。

深夜,沉寂已久的Kimi突然发布了新模型—— 开源代码模型Kimi-Dev,在SWE-bench Verified上以60.4%的成绩取得开源SOTA。

字节Seed首次开源代码模型!Seed-Coder,8B规模,超越Qwen3,拿下多个SOTA。它证明“只需极少人工参与,LLM就能自行管理代码训练数据”。通过自身生成和筛选高质量训练数据,可大幅提升模型代码生成能力。

“欧洲版 OpenAI” Mistral 的代码模型 CodeStral,又上新了! 而且与 DeepSeek V2.5 和 Claude 3.5 平起平坐,共同位列 Copilot 竞技场第一名。

都说国产大模型“通义千问”能打,到底是真强还是智商税?今天就带你看看,这个国产“AI猛将”凭什么火出圈! 2023年4月,阿里巴巴推出通义千问,选择了“全开源”的策略,成为全球开发者关注的焦点。而在2024年的云栖大会上,阿里云进一步发布了Qwen2.5系列,包括多个尺寸的大语言模型、多模态模型、数学模型和代码模型,涵盖从0.5B到72B的完整规模

代码模型可以自己进化,利用自身生成的数据来进行指令调优,效果超越GPT-4o直接蒸馏!

代码模型SFT对齐后,缺少进一步偏好学习的问题有解了。 北大李戈教授团队与字节合作,在模型训练过程中引入偏好学习,提出了一个全新的代码生成优化框架——CodeDPO。

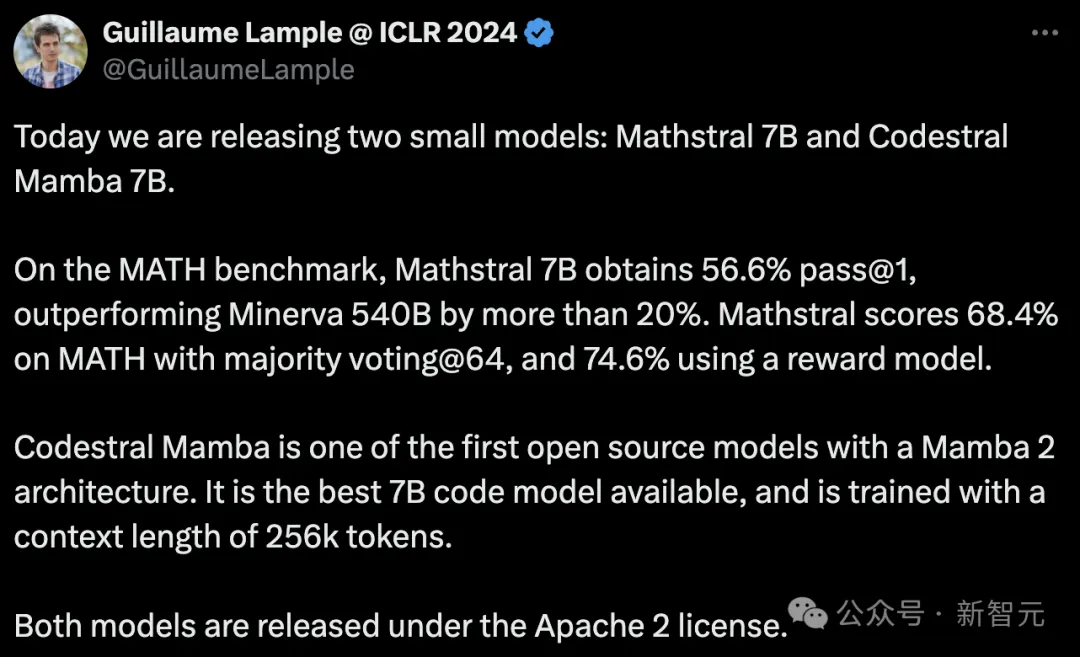

最近,7B小模型又成为了AI巨头们竞相追赶的潮流。继谷歌的Gemma2 7B后,Mistral今天又发布了两个7B模型,分别是针对STEM学科的Mathstral,以及使用Mamaba架构的代码模型Codestral Mamba。

开放但禁止商用用途。

就在刚刚,法国AI初创公司Mistral发布了自家首款代码生成模型Codestral。不仅支持32K长上下文窗口以及80多种编程语言,而且还用22B的参数量取得了与70B的Llama 3相近的性能。目前,已经开放API与IDE插件供用户使用。

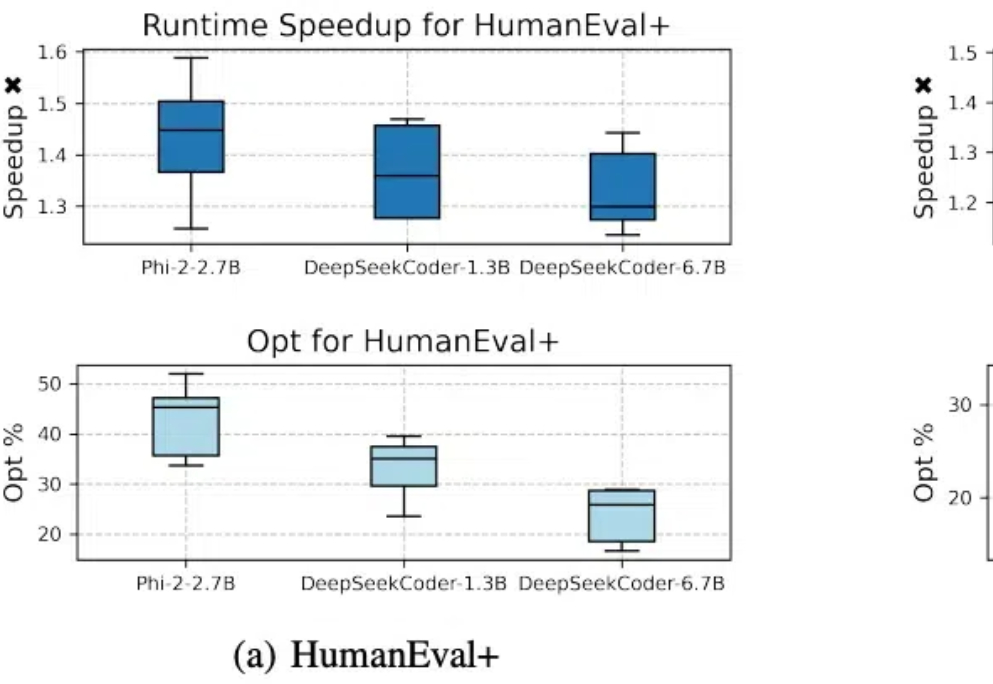

【新智元导读】Stability AI在大佬出走后似乎并未受到影响,最近又官宣了新的代码模型Stable Code Instruct 3B,在之前的基础上更进一步,干掉了所有同级竞品,甚至能和7B、15B的模型掰手腕。