仅100种子题,合成数据质量超GPT-5,阿里、上交提出Socratic-Zero框架

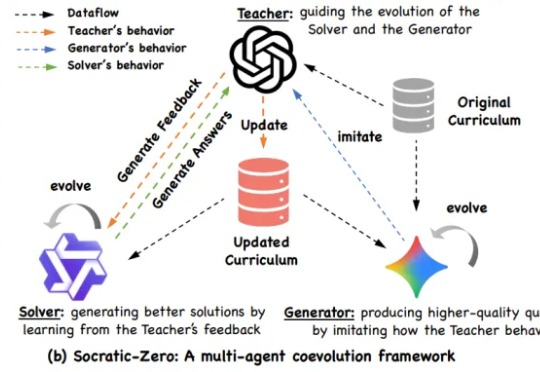

仅100种子题,合成数据质量超GPT-5,阿里、上交提出Socratic-Zero框架阿里巴巴与上海交通大学 EPIC Lab 联合提出 Socratic-Zero,一个完全无外部数据依赖的自主推理训练框架。该方法仅从 100 个种子问题出发,通过三个智能体的协同进化,自动生成高质量、难度自适应的课程,并持续提升模型推理能力。

搜索

搜索

阿里巴巴与上海交通大学 EPIC Lab 联合提出 Socratic-Zero,一个完全无外部数据依赖的自主推理训练框架。该方法仅从 100 个种子问题出发,通过三个智能体的协同进化,自动生成高质量、难度自适应的课程,并持续提升模型推理能力。

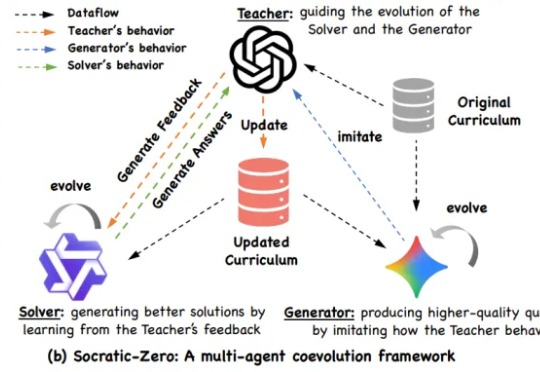

本文主要描述了具身合成数据两条主要技术路线之争:“视频合成+3D重建”or “端到端3D生成”。参考自动驾驶的成功经验,前者模态转换链路过长导致误差累积,'直接合成3D数据'理论上有信息效率优势,但需要克服“常识欠缺”等挑战。

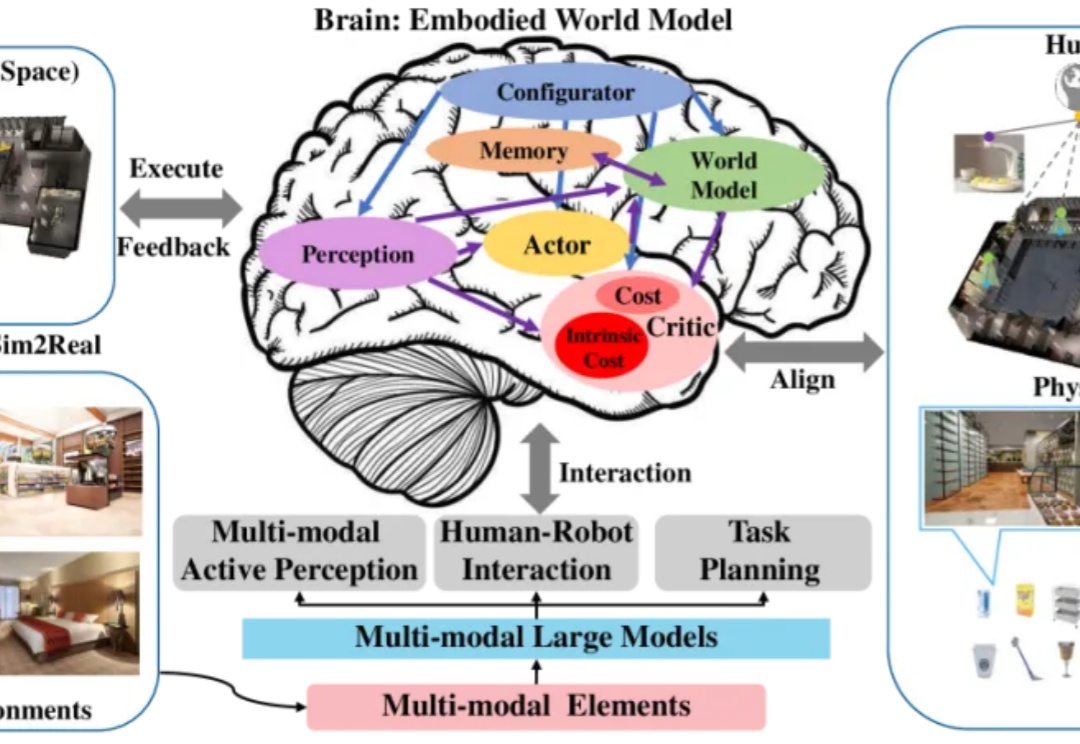

视频多模态大模型(LMMs)的发展受限于从网络获取大量高质量视频数据。为解决这一问题,我们提出了一种替代方法,创建一个专为视频指令跟随任务设计的高质量合成数据集,名为 LLaVA-Video-178K。

适逢Llama 3.1模型刚刚发布,英伟达就发表了一篇技术博客,手把手教你如何好好利用这个强大的开源模型,为领域模型或RAG系统的微调生成合成数据。

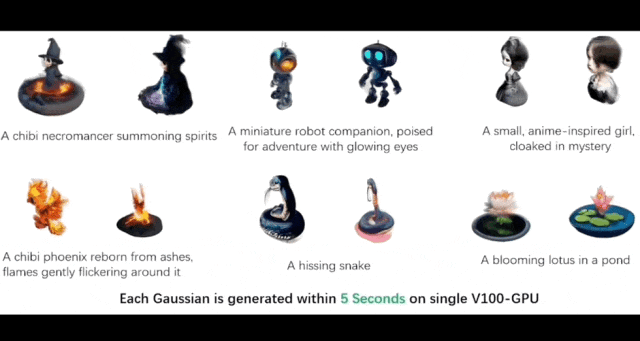

使用大模型合成的数据,就能显著提升3D生成能力?

通过视觉信息识别、理解人群的行为是视频监测、交互机器人、自动驾驶等领域的关键技术之一,但获取大规模的人群行为标注数据成为了相关研究的发展瓶颈。如今,合成数据集正成为一种新兴的,用于替代现实世界数据的方法,但已有研究中的合成数据集主要聚焦于人体姿态与形状的估计。它们往往只提供单个人物的合成动画视频,而这并不适用于人群的视频识别任务。