千帧长视频时代到来!MIT全新扩散算法让任意模型突破时长极限

千帧长视频时代到来!MIT全新扩散算法让任意模型突破时长极限进入到 2025 年,视频生成(尤其是基于扩散模型)领域还在不断地「推陈出新」,各种文生视频、图生视频模型展现出了酷炫的效果。其中,长视频生成一直是现有视频扩散的痛点。

来自主题: AI技术研报

8275 点击 2025-02-26 13:39

搜索

搜索

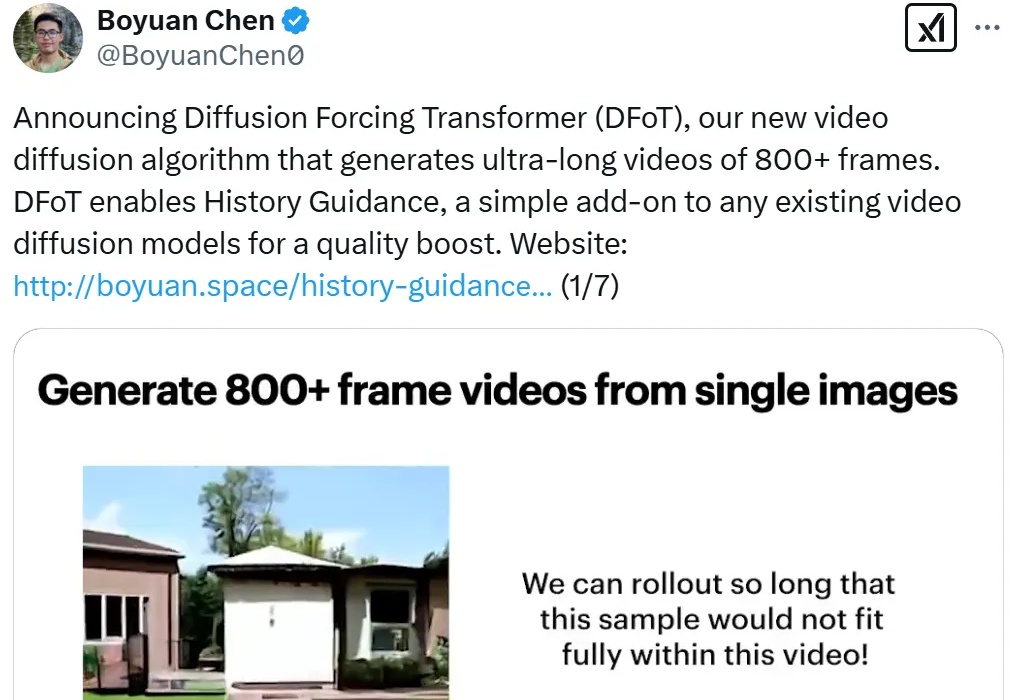

进入到 2025 年,视频生成(尤其是基于扩散模型)领域还在不断地「推陈出新」,各种文生视频、图生视频模型展现出了酷炫的效果。其中,长视频生成一直是现有视频扩散的痛点。

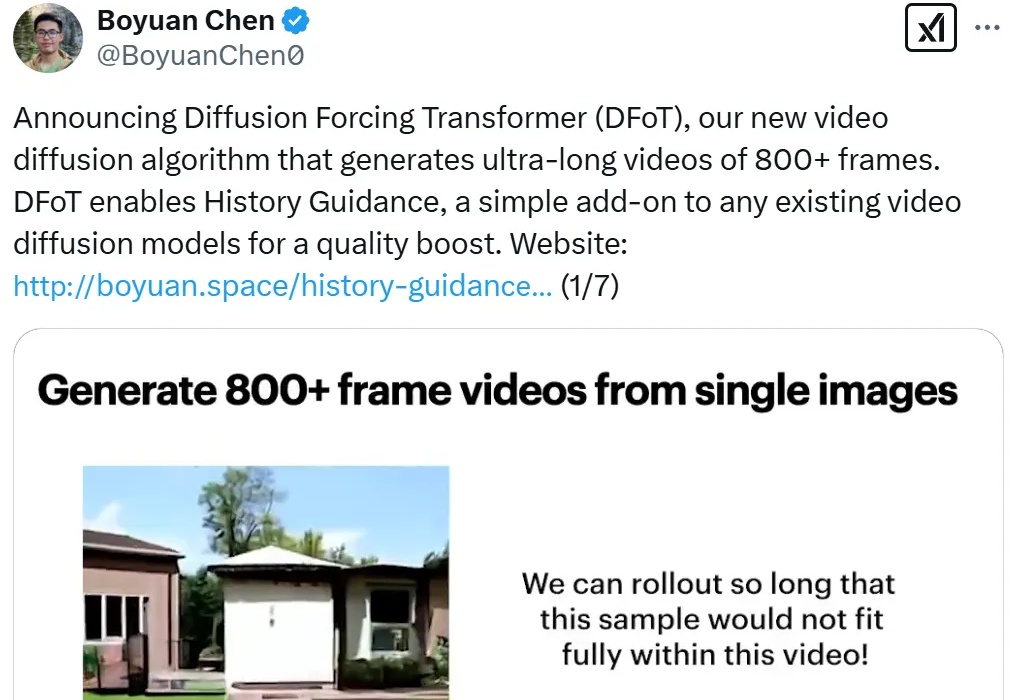

刚刚,智谱把清影背后的图生视频模型CogVideoX-5B-I2V给开源了!(在线可玩) 一起开源的还有它的标注模型cogvlm2-llama3-caption。

继Pika宣布上新2.0版本后,视频生成领域又有新模型加入。成立于2021年的Luma AI今天刚刚官宣了文生视频/图生视频模型Dream Machine,而且提供免费使用API,高质量的生成效果获得了很多网友的好评。

当前大家常见的视频生成是酱婶儿的:

以上效果来自一个新的图生视频模型Follow-Your-Click,由腾讯混元、清华大学和香港科技大学联合推出。任意一张照片输入模型,只需要点击对应区域,加上少量简单的提示词,就可以让图片中原本静态的区域动起来,一键转换成视频。