思维链监督和强化的图表推理,7B模型媲美闭源大尺寸模型

思维链监督和强化的图表推理,7B模型媲美闭源大尺寸模型近期,随着OpenAI-o1/o3和Deepseek-R1的成功,基于强化学习的微调方法(R1-Style)在AI领域引起广泛关注。这些方法在数学推理和代码智能方面展现出色表现,但在通用多模态数据上的应用研究仍有待深入。

搜索

搜索

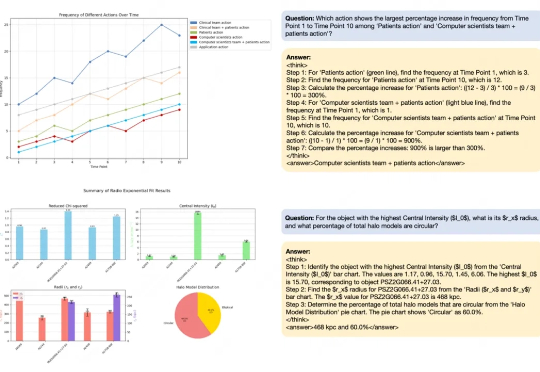

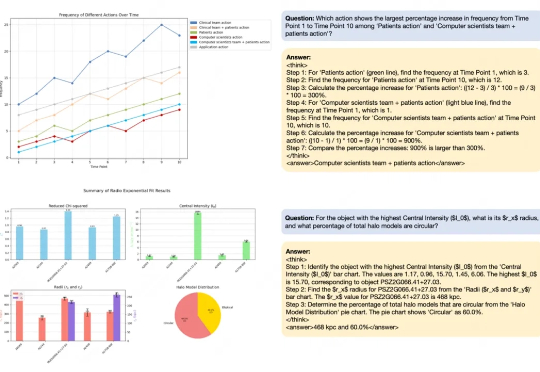

近期,随着OpenAI-o1/o3和Deepseek-R1的成功,基于强化学习的微调方法(R1-Style)在AI领域引起广泛关注。这些方法在数学推理和代码智能方面展现出色表现,但在通用多模态数据上的应用研究仍有待深入。

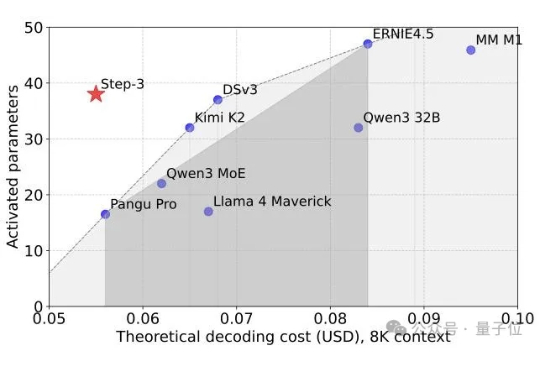

又一个SOTA基础模型开源,而且依然是国产。 刚刚,阶跃星辰兑现了WAIC上的承诺,将最新多模态推理模型Step-3正式开源! 在MMMU等多个多模态榜单上,它一现身就取得了开源多模态推理模型新SOTA的成绩。

听说了吗,GPT-5这两天那叫一个疯狂造势,奥特曼怕不是真有些急了(doge)。

当马斯克的 Grok-4 还在用 “幽默模式” 讲冷笑话时,中国的科学家已经在用书生 Intern-S1 默默破解癌症药物靶点的密码 —— 谁说搞科研不能又酷又免费?

在WAIC 2025大会上,上海AI实验室首席科学周伯文和Hinton教授的尖峰对话轰动全场。而在科学探索上,实验室更是独辟蹊径开创「通专融合」大模型创新路线,全新一代科学大模型拿下多模态能力全球第一。

加利福尼亚大学圣迭戈分校博士生王禹和纽约大学教授陈溪联合推出并开源了 MIRIX,全球首个真正意义上的多模态、多智能体AI记忆系统。MIRIX团队同步上线了一款桌面端APP,可直接下载使用!

如今的具身智能,早已爆红AI圈。数据瓶颈、难以多场景泛化等难题,一直困扰着业界的玩家们。就在WAIC上,全新具身智能平台「悟能」登场了。它以世界模型为引擎,能为机器人提供强大感知、导航、多模态交互能力。

WAIC大会上,这个机器人凭惊艳实力引起了层层围观!叠衣服、分拣物品、听指令取货,他们研发的Mech-GPT多模态大模型和「眼脑手」系统,让机器人的高难度操作性能暴增。现在,这家公司已经成为市占率连续五年的行业冠军了。

AI语音成大厂必争之地 打开字节、阿里们的多模态能力地图,每块宝藏都标着"语音”。

近日,上海人工智能独角兽阶跃星辰宣布,正在进行新一轮融资,金额预计超过5 亿美元,或成为 2025 年国内大模型行业最大单笔融资。本轮融资由上海国有资本投资有限公司(简称 “上海国投”)等战略投资方领投,资金将重点用于多模态模型研发、推理效率优化及智能终端场景落地。