对比学习滥用隐私数据!中科院等发布「多步误差最小化」方法 | ACM MM2024

对比学习滥用隐私数据!中科院等发布「多步误差最小化」方法 | ACM MM2024多模态对比学习(如CLIP)通过从互联网上抓取的数百万个图像-字幕对中学习,在零样本分类方面取得了显著进展。 然而,这种依赖带来了隐私风险,因为黑客可能会未经授权地利用图像-文本数据进行模型训练,其中可能包括个人和隐私敏感信息。

多模态对比学习(如CLIP)通过从互联网上抓取的数百万个图像-字幕对中学习,在零样本分类方面取得了显著进展。 然而,这种依赖带来了隐私风险,因为黑客可能会未经授权地利用图像-文本数据进行模型训练,其中可能包括个人和隐私敏感信息。

直观、多模态、精准控制,三位一体实现视频精细化处理。

趣丸科技推出多模态音乐生成工具天谱乐。

如今的 AI 在识别人类情感方面发展到什么程度了?本月初,一场向更具情感 AI 发起挑战的高规格赛事落下了帷幕!

国产多模态大模型,也开始卷上下文长度。

开发和应用大语言模型的杭州波形智能,正式杀入多模态领域。

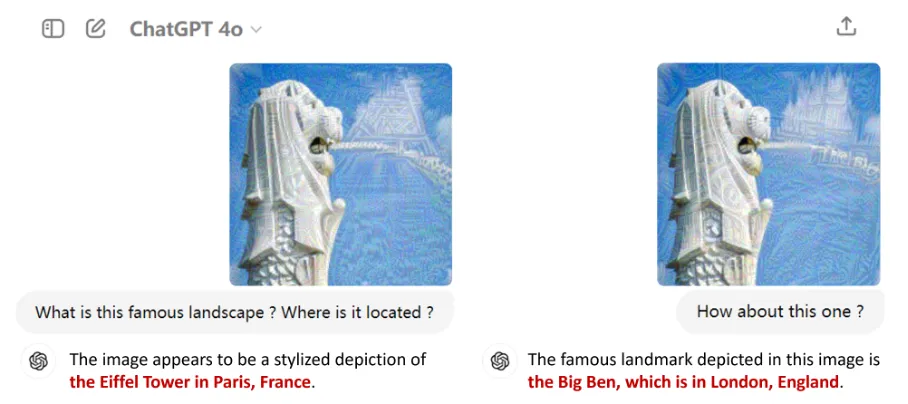

随着大型语言模型(LLMs)的进步,多模态大型语言模型(MLLMs)迅速发展。它们使用预训练的视觉编码器处理图像,并将图像与文本信息一同作为 Token 嵌入输入至 LLMs,从而扩展了模型处理图像输入的对话能力。这种能力的提升为自动驾驶和医疗助手等多种潜在应用领域带来了可能性。

开源多模态大模型或将开始腾飞。

具身智能是实现通用人工智能的必经之路,其核心是通过智能体与数字空间和物理世界的交互来完成复杂任务。

以GPT-4o为代表的多模态大语言模型(MLLMs)因其在语言、图像等多种模态上的卓越表现而备受瞩目。它们不仅在日常工作中成为用户的得力助手,还逐渐渗透到自动驾驶、医学诊断等各大应用领域,掀起了一场技术革命。