真相了!大模型解数学题和人类真不一样:死记硬背、知识欠缺明显,GPT-4o表现最佳

真相了!大模型解数学题和人类真不一样:死记硬背、知识欠缺明显,GPT-4o表现最佳随着人工智能技术的快速发展,能够处理多种模态信息的多模态大模型(LMMs)逐渐成为研究的热点。通过整合不同模态的信息,LMMs 展现出一定的推理和理解能力,在诸如视觉问答、图像生成、跨模态检索等任务中表现出色。

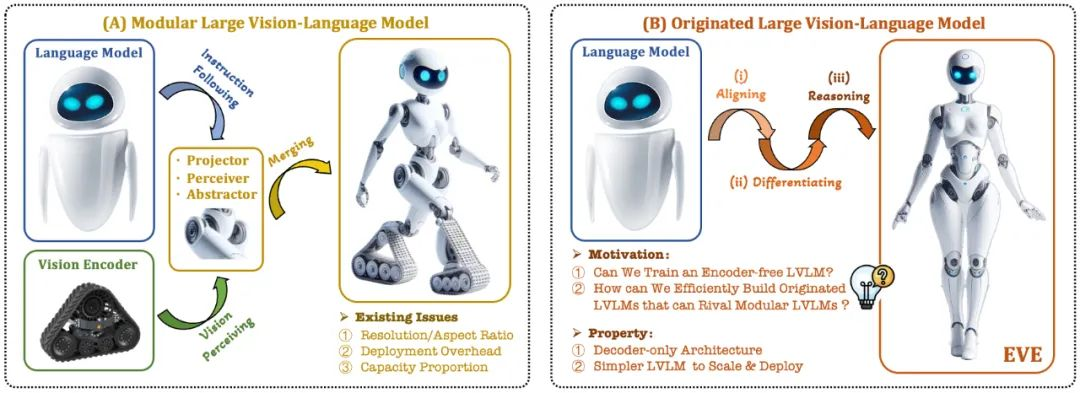

随着人工智能技术的快速发展,能够处理多种模态信息的多模态大模型(LMMs)逐渐成为研究的热点。通过整合不同模态的信息,LMMs 展现出一定的推理和理解能力,在诸如视觉问答、图像生成、跨模态检索等任务中表现出色。

多模态大模型(Multimodal Large Language Models,MLLMs)在不同的任务中表现出了令人印象深刻的能力,尽管如此,这些模型在检测任务中的潜力仍被低估。

封面来源|公司官网 “GPT-3.5(ChatGPT)API将在某个时刻退役——只是不确定在何时。”在The Verge的采访中,OpenAI API平台负责人Olivier Godement如此总结。

离开快手创业后,「李岩」悄悄拿到了快手联合创始人宿华、红点创投以及经纬创投的3200万美金种子轮融资。

相比于其他融合多模态AI交互与大模型技术产品,「京东方」更注重产品使用过程中的信息安全问题。

近期,关于多模态大模型的研究如火如荼,工业界对此的投入也越来越多。

最近,新加坡国立大学联合南洋理工大学和哈工深的研究人员共同提出了一个全新的视频推理框架,这也是首次大模型推理社区提出的面向视频的思维链框架(Video-of-Thought, VoT)。视频思维链VoT让视频多模态大语言模型在复杂视频的理解和推理性能上大幅提升。该工作已被ICML 2024录用为Oral paper。

支付宝医疗大模型亮相!

没等到GPT-4o,商汤先把《Her》给发布出来了!

最近,一个对标 GPT-4o 的开源实时语音多模态模型火了。