微调都不要了?3个样本、1个提示搞定LLM对齐,提示工程师:全都回来了

微调都不要了?3个样本、1个提示搞定LLM对齐,提示工程师:全都回来了大模型的效果好不好,有时候对齐调优很关键。但近来很多研究开始探索无微调的方法,艾伦人工智能研究所和华盛顿大学的研究者用「免调优」对齐新方法超越了使用监督调优(SFT)和人类反馈强化学习(RLHF)的 LLM 性能。

大模型的效果好不好,有时候对齐调优很关键。但近来很多研究开始探索无微调的方法,艾伦人工智能研究所和华盛顿大学的研究者用「免调优」对齐新方法超越了使用监督调优(SFT)和人类反馈强化学习(RLHF)的 LLM 性能。

2022年11月30日,是ChatGPT面世的第一天。至今整整一年的时间,“人类与AI的未来”撕开科幻的外衣,正式踏入现实。

那些声称通用人工智能很快实现的人,在医学面前应该严谨谦卑一些。多年来,几乎所有人工智能大咖,都会说最希望把AI首先用于医疗健康,但以往这一直是进展最慢的领域之一。

本文介绍了中国AI创业者在五道口扎堆的原因,主要是因为一些日常琐事,如孩子上学、家庭生活等。这说明AI创业者也是普通人,关心着柴米油盐的问题。

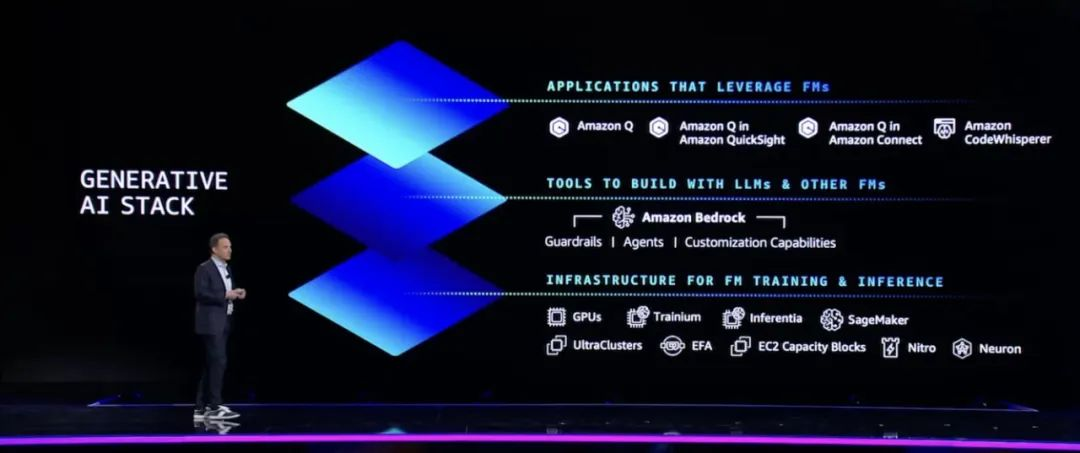

在 2023 年上半年,AI 圈内有一个热议观点:「所有产品都值得用大模型重做一次。」这个设想,曾引发了人们无限的想象。

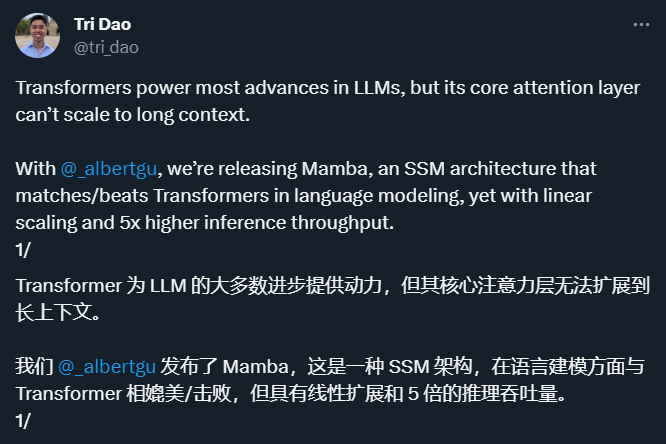

现在ChatGPT等大模型一大痛点:处理长文本算力消耗巨大,背后原因是Transformer架构中注意力机制的二次复杂度。

Inflection-2最新发布!性能碾压一众大厂模型,仅输一手GPT-4,还要集成到Pi?最近,InflectionAI发布了全新的一款AI模型。更炸裂的是InfectionAI对这款模型的评价——性能直超谷歌和Meta开发的两款模型,紧随OpenAI的GPT-4之后。

“欧洲版OpenAI”最新估值,逼近20亿美元!总部位于巴黎的大模型初创公司Mistral AI最新一轮融资,4.87亿美元。

屹立不倒的 Transformer 迎来了一个强劲竞争者。在别的领域,如果你想形容一个东西非常重要,你可能将其形容为「撑起了某领域的半壁江山」。但在 AI 大模型领域,Transformer 架构不能这么形容,因为它几乎撑起了「整个江山」。

增加数据量和模型的参数量是公认的提升神经网络性能最直接的方法。目前主流的大模型的参数量已扩展至千亿级别,「大模型」越来越大的趋势还将愈演愈烈。