大模型out了,小模型(SLM)爆火,撕开99%企业市场?

大模型out了,小模型(SLM)爆火,撕开99%企业市场?大模型是能力上限,小模型是落地首选

来自主题: AI资讯

4276 点击 2024-07-30 12:12

大模型是能力上限,小模型是落地首选

不是大模型用不起,而是小模型更有性价比。

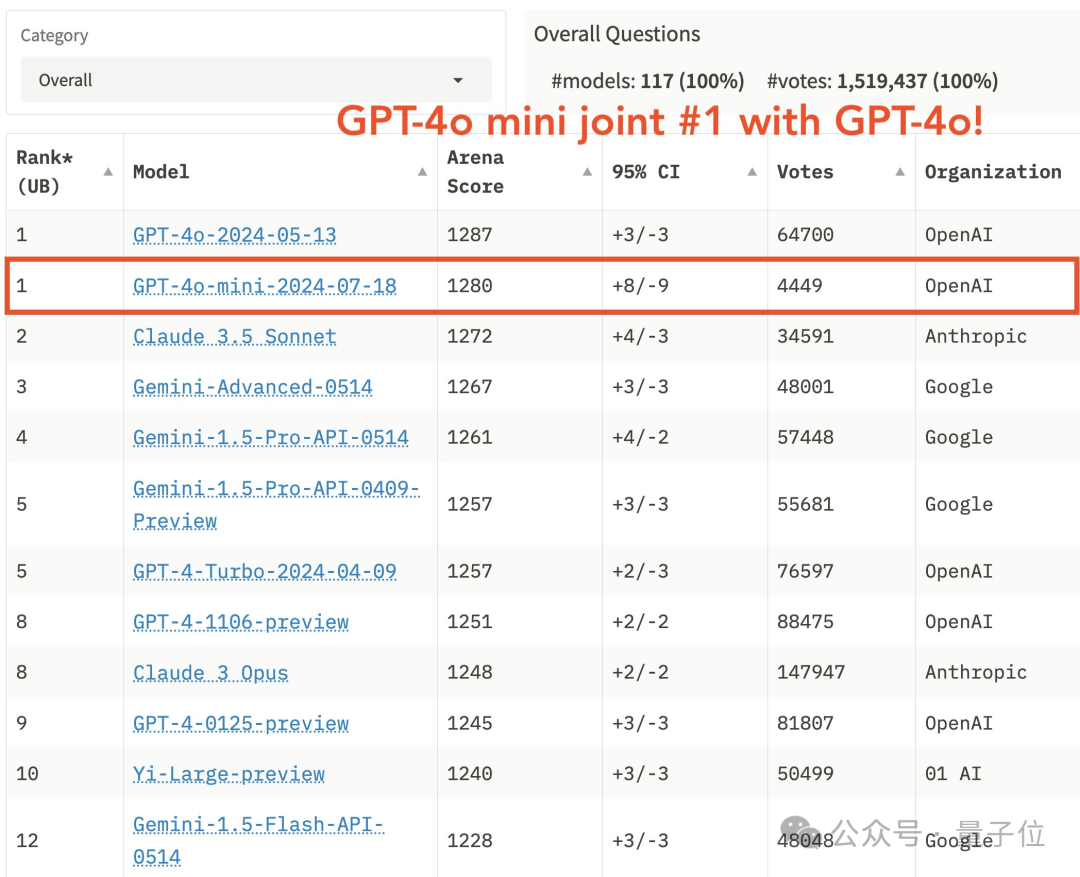

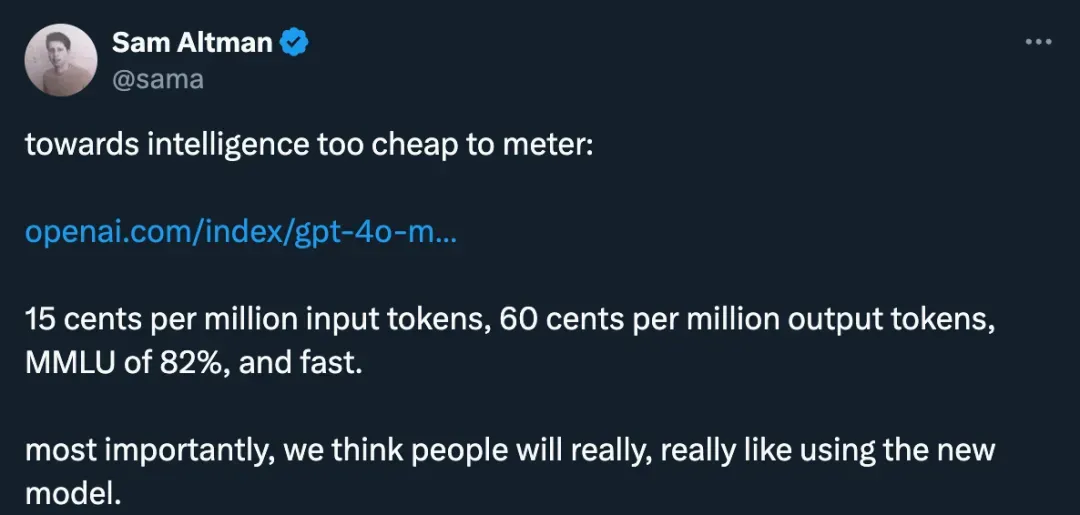

刚刚,GPT-4o mini版迎来“高光时刻”——

大模型迈入“小而强”时代。

Scaling Law还没走到尽头,「小模型」逐渐成为科技巨头们的追赶趋势。Meta最近发布的MobileLLM系列,规模甚至降低到了1B以下,两个版本分别只有125M和350M参数,但却实现了比更大规模模型更优的性能。

小模型强势来袭,「大模型时代」或将落幕?

小模型时代来了?OpenAI带着GPT-4o mini首次入局小模型战场,Mistral AI、HuggingFace本周接连发布了小模型。如今,苹果也发布了70亿参数小模型DCLM,性能碾压Mistral-7B。

小模型成趋势?

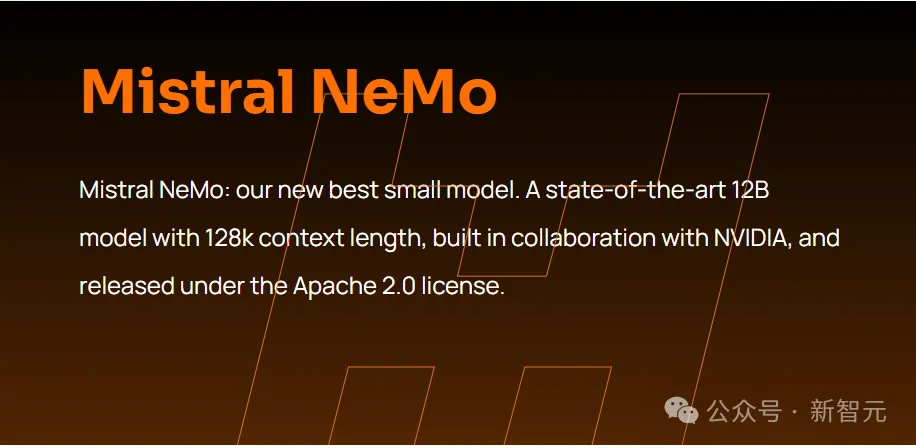

GPT-4o mini头把交椅还未坐热,Mistral AI联手英伟达发布12B参数小模型Mistral Nemo,性能赶超Gemma 2 9B和Llama 3 8B。

小模型,正在成为 AI 巨头的新战场。