AI漫剧从难产到量产!这款Agent内置SOP,小白也能轻松搞定~

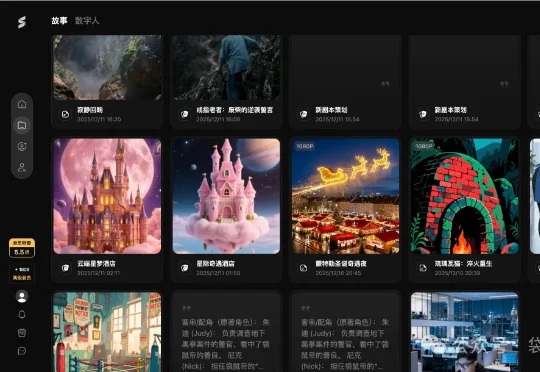

AI漫剧从难产到量产!这款Agent内置SOP,小白也能轻松搞定~对了,这个工具叫Seko,我相信大家应该也从一些大佬那里刷到过吧。它是一个Agent,只需要给一个方向,就能自动直出剧本、分镜、人物、场景、风格、批量出分镜图、批量转视频,甚至配音,BGM都给你裁剪卡上了,最后导出一个完整的作品。

搜索

搜索

对了,这个工具叫Seko,我相信大家应该也从一些大佬那里刷到过吧。它是一个Agent,只需要给一个方向,就能自动直出剧本、分镜、人物、场景、风格、批量出分镜图、批量转视频,甚至配音,BGM都给你裁剪卡上了,最后导出一个完整的作品。

拥有一台AI手机,竟能如此简单。这个AI手机,正是最近全面开源的、能让手机自己动起来的AutoGLM。这个方法要用到的工具组合是Claude Code + GLM-4.6。

红色警报拉响,OpenAI是真急了:30天,GPT-5.2系列紧接着GPT-5.1而来,这次还专门强化了打工能力。这是GPT-5.1 Thinking和GPT-5.2 Thinking做人力资源表格的对比:虽然版本号只加了0.1,但是在多个实用领域都更强了:做表格、做PPT、写代码、理解长文档、调用工具、处理复杂多步骤项目……

如果把今年的AI创业图景抽象成一幅热力分布图,会看到一个异常明亮的区域。它不在模型底座层,不在搜索、办公、投喂式工具链,而是意外地集中在一个节点:视频生成。

觉得大模型消耗的算力过大,英伟达推出的8B模型Orchestrator化身「拼好模」,通过组合工具降本增效,使用30%的预算,在HLE上拿下37.1%的成绩。

老板丢下一句“要高端大气”,然后转身就走。 面对空白的 PPT,你是不是也经常想把电脑砸了? 以前为了填这个坑,我得花几小时刷各种网站找素材。但最近,我摸到了 Google 的新神器 Mixboard。

ChatGPT内上线 Photoshop、Express与Acrobat原生集成,用户可在对话界面直接调用三大创意工具完成修图、设计和PDF处理,无需跳转外部应用。

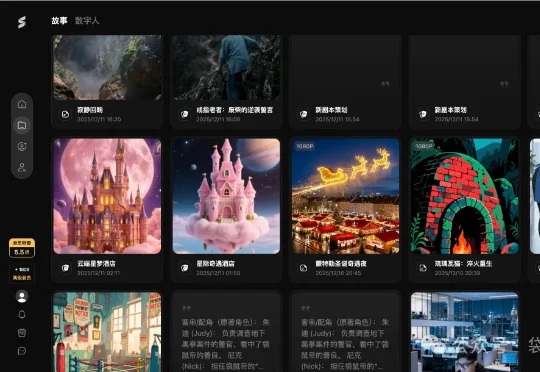

我在想,有没有这样一个工具:我不用理解节点和变量,直接说我想要什么,AI 就帮我把工作流搭出来?我尝试了很多,直到遇到 Refly.AI 这个 Vibe Workflow 平台—— AI 自动搭建工作流。它给出了一个让我眼前一亮的答案:通过 Vibe Workflow,把想法变成自动化工作流,让我真正进入口喷工作流时代。

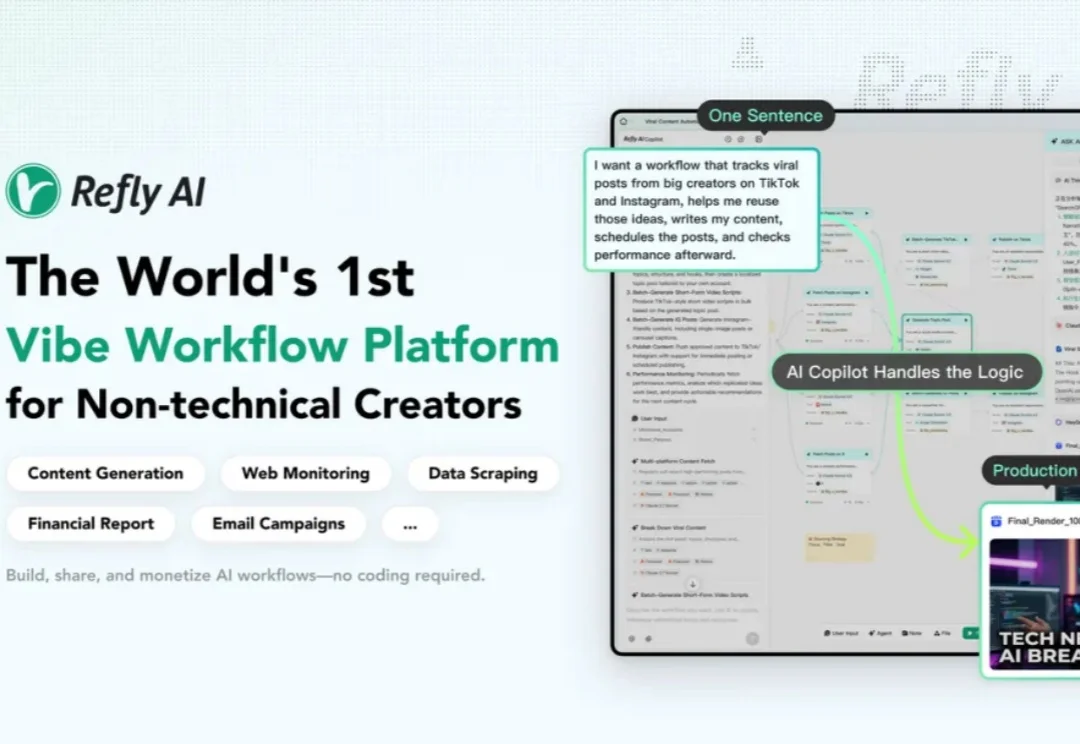

“真的受够了 Windows 11 中各种莫名其妙的 AI 功能。”

当AI不再仅仅是渲染队列中的一个工具,而是开始以智能体的身份,深度参与到剧本构思、视觉预览乃至最终剪辑的每一个环节,我们正站在一场影像文明变革的临界点。