重点收藏!三家众擎机器人核心供应链企业!附辟谣信息

重点收藏!三家众擎机器人核心供应链企业!附辟谣信息据众擎机器人介绍,众擎机器人SE01自主研发的“动态重心补偿算法”以每秒1000次的姿态微调对抗前倾失控风险;仿生肌肉驱动系统使关节瞬时扭矩高达330N·m;而毫米波雷达与视觉融合感知系统则将落地误差控制在±2cm内。

据众擎机器人介绍,众擎机器人SE01自主研发的“动态重心补偿算法”以每秒1000次的姿态微调对抗前倾失控风险;仿生肌肉驱动系统使关节瞬时扭矩高达330N·m;而毫米波雷达与视觉融合感知系统则将落地误差控制在±2cm内。

3月1日,潞晨科技官微发布了两则消息。先是宣布:“尊敬的用户,潞晨云将在一周后停止提供DeepSeek API服务,请尽快用完您的余额。如果没用完,我们全额退款。”后又发布消息:“感谢网友的热心提醒,Colossal-AI此前发布对DeepSeek-R1(671B)模型的LoRA微调,在参数加载过程中因参数名称不匹配的Bug导致Loss异常,已在GitHub线上修复。”

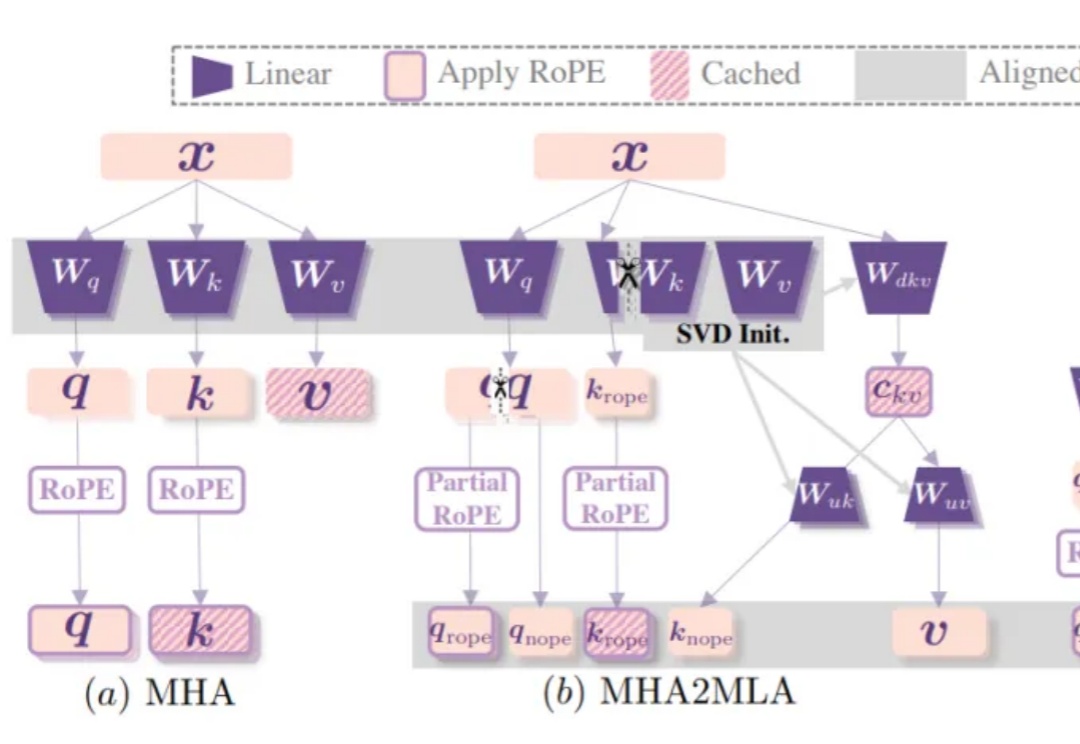

DeepSeek-R1背后关键——多头潜在注意力机制(MLA),现在也能轻松移植到其他模型了!

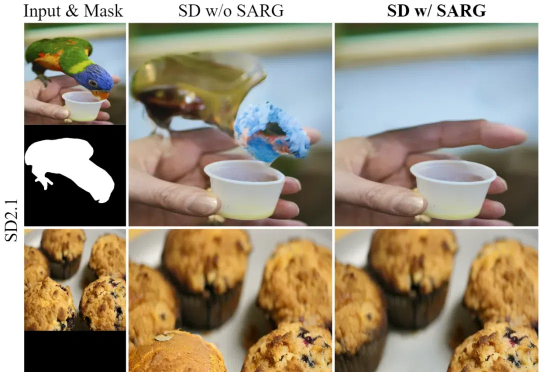

最近,扩散模型在生成模型领域异军突起,凭借其独特的生成机制在图像生成方面大放异彩,尤其在处理高维复杂数据时优势明显。然而,尽管扩散模型在图像生成任务中表现优异,但在图像目标移除任务中仍然面临诸多挑战。现有方法在移除前景目标后,可能会留下残影或伪影,难以实现与背景的自然融合。

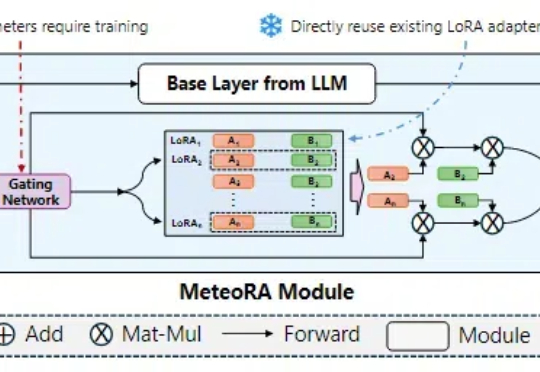

在大语言模型领域中,预训练 + 微调范式已经成为了部署各类下游应用的重要基础。在该框架下,通过使用搭低秩自适应(LoRA)方法的大模型参数高效微调(PEFT)技术,已经产生了大量针对特定任务、可重用的 LoRA 适配器。

DeepSeek爆火甚至引发API低价内卷……

全网首发!DeepSeek V3/R1满血版低成本监督微调秘籍来了,让高达6710亿参数AI巨兽释放最强性能。

这项尝试只用到了 R1 模型和基本验证器,没有针对 R1 的工具,没有对专有的英伟达代码进行微调。其实根据 DeepSeek 介绍,R1 的编码能力不算顶尖。

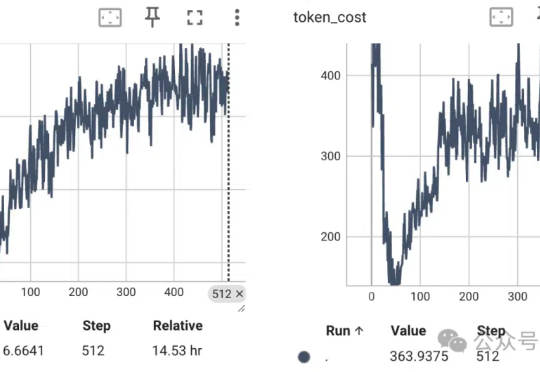

只用4500美元成本,就能成功复现DeepSeek?就在刚刚,UC伯克利团队只用简单的RL微调,就训出了DeepScaleR-1.5B-Preview,15亿参数模型直接吊打o1-preview,震撼业内。

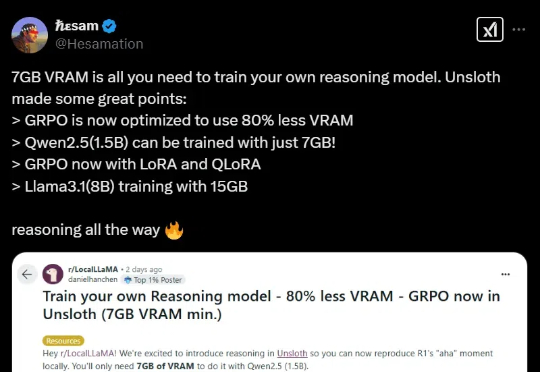

黑科技来了!开源LLM微调神器Unsloth近期更新,将GRPO训练的内存使用减少了80%!只需7GB VRAM,本地就能体验AI「啊哈时刻」。