用SFT打出RL的效果?微软联合提出高效后训练算法

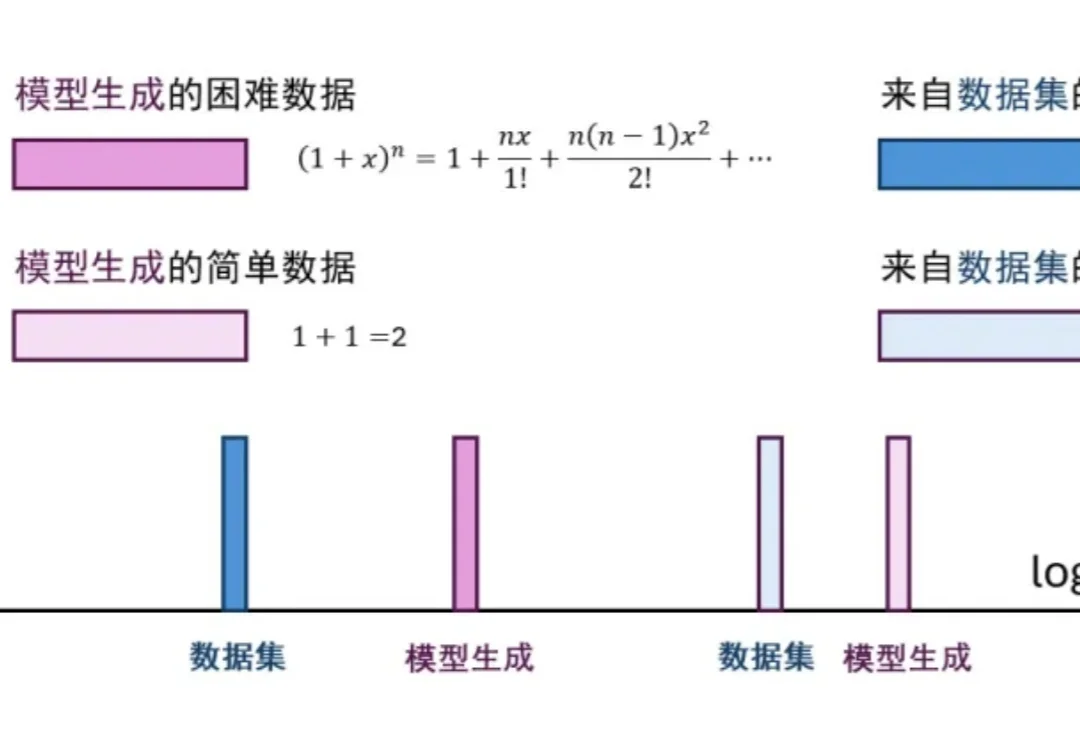

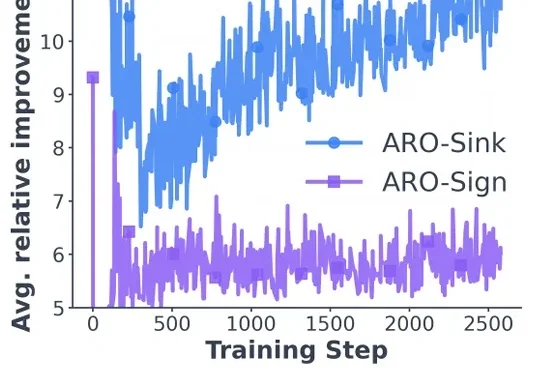

用SFT打出RL的效果?微软联合提出高效后训练算法在大模型后训练阶段,监督微调(SFT)和强化学习(RL)是两根不可或缺的支柱。SFT 利用高质量的离线(Off-policy)数据快速注入知识,但受限于静态数据分布,泛化能力往往容易触及天花板并带来灾难性遗忘;RL 则允许模型在探索中不断自我迭代,产生与当前策略同分布(On-policy)的数据,上限极高,但往往伴随着训练极度不稳定、计算资源消耗巨大的痛点。

在大模型后训练阶段,监督微调(SFT)和强化学习(RL)是两根不可或缺的支柱。SFT 利用高质量的离线(Off-policy)数据快速注入知识,但受限于静态数据分布,泛化能力往往容易触及天花板并带来灾难性遗忘;RL 则允许模型在探索中不断自我迭代,产生与当前策略同分布(On-policy)的数据,上限极高,但往往伴随着训练极度不稳定、计算资源消耗巨大的痛点。

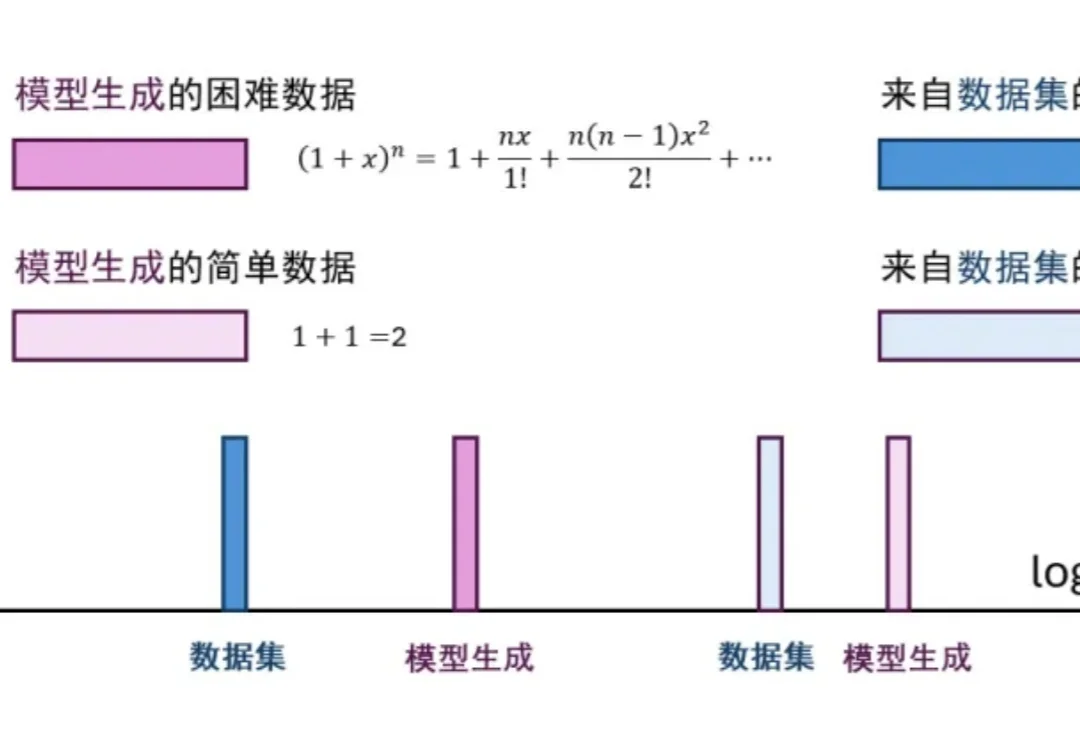

Anthropic的野心曝光了!有人分析称:他们在悄然打造一个AI操作系统,意图统治全球数字生态,做一个统治一切生态的龙虾大脑!这背后,剑指的就是苹果微软的6.4万亿帝国,而OpenAI甚至还排不上号。

砸了724亿美金「学费」后,微软用一场大重组承认 Copilot「走弯路」了。

吉林大学&微软亚洲研究院等团队提出MindPower框架,让机器人像人一样理解他人想法并主动帮忙,构建了首个以机器人为中心的心智推理评测体系,通过六层推理链条,让AI不仅看懂场景,更能推断意图、做出决策、执行动作,显著提升助人能力。

跨文件记忆革命:单一对话同时操控多个Excel工作簿+PowerPoint幻灯片,数据从表格直飞演示文稿,无缝迁移零解释,Anthropic把AI Agent玩明白了。

随着大语言模型 Agent 开始在对话、问答与复杂交互环境中长期运行,“记忆该如何设计” 正在成为一个绕不开的核心问题。

巨硬,马斯克旗下一个连名字都在嘲讽微软的项目,如今已乱成一锅粥了。 事情要从去年 8 月说起。 彼时马斯克高调宣布了一个新项目 Macrohard(巨硬),从名字上不难看出,这个项目本身是对「Microsoft」的调侃式致敬,针对得也相当工整。

深夜,谷歌官宣重磅更新!Gemini全面接管Docs、Sheets、Slides,AI原生办公时代来了,全球30亿谷歌用户的办公方式,或正在被彻底颠覆。

微软选择了 Anthropic,而不是 OpenAI。

如果你在过去一年关注过大模型训练的技术,大概率听过 Muon 这个名字 —— 这个在月之暗面 K2 模型的相关讨论中走红的优化器,被视为是可能挑战 Adam 的新秀。它的思路很直接:对动量矩阵进行正交化,让各个奇异方向上的更新速率一致,提升训练效率。