大模型学会拖进度条看视频了!阿里新研究让视频推理告别脑补,实现证据链思考 | ICLR 2026

大模型学会拖进度条看视频了!阿里新研究让视频推理告别脑补,实现证据链思考 | ICLR 2026为什么让多模态大模型“一步一步思考”(”Let’s think step by step”)来回答视频问题,效果有时甚至还不如让它“直接回答”?

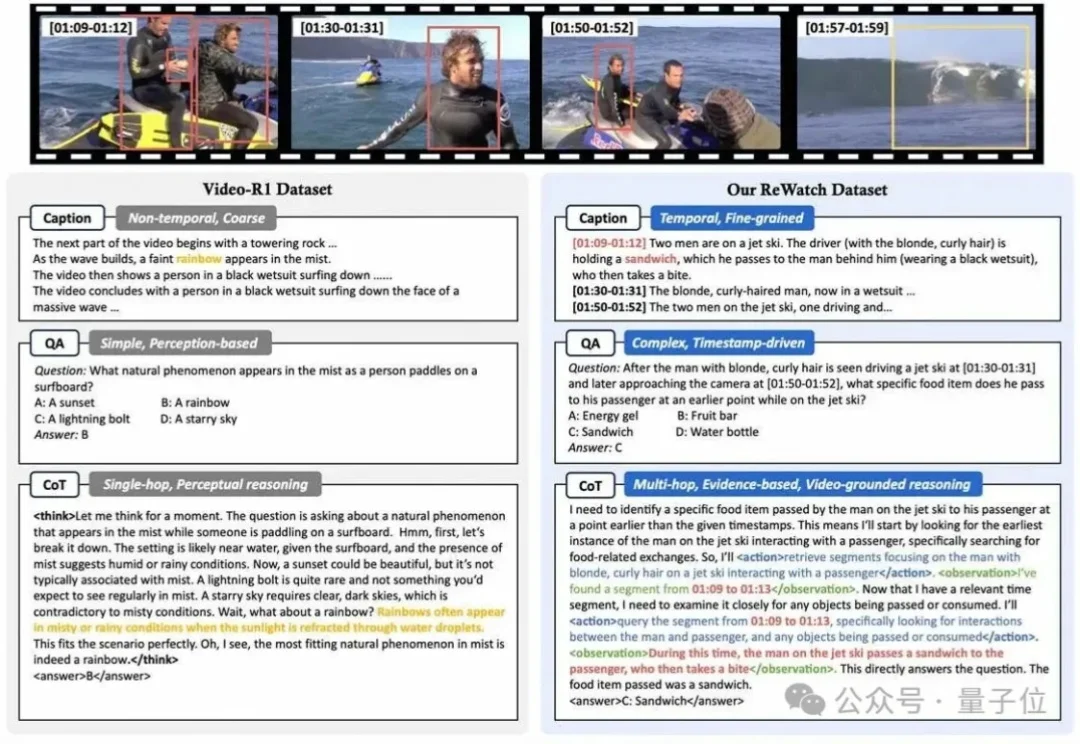

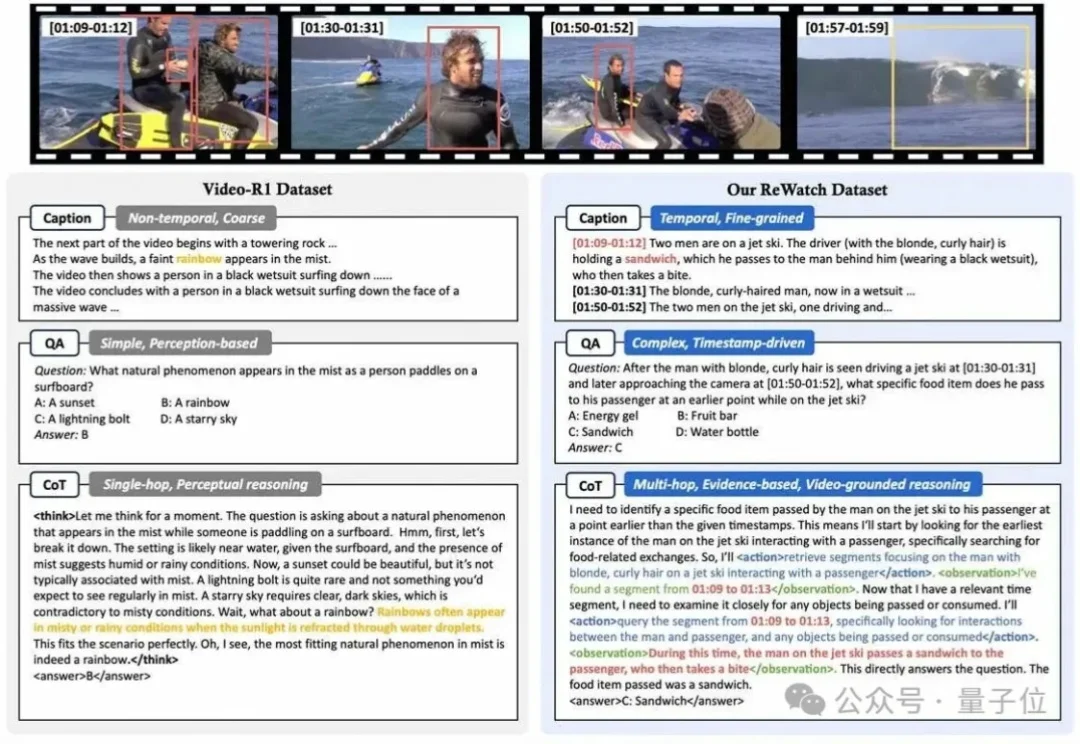

为什么让多模态大模型“一步一步思考”(”Let’s think step by step”)来回答视频问题,效果有时甚至还不如让它“直接回答”?

大模型的出现,给许多行业带来了颠覆性的改变,运维这个向来被视为稳定、保守的领域也不例外。虽然“AIOps”这个概念早在 2016 年由 Gartner 提出,但早期的智能运维更多是利用大数据和机器学习对传统运维流程进行效率上的提升。

最近Clawdbot(现:Moltbot)全网爆火。它能接管你的社交媒体,能发帖、能监听、能回复、能长期驻场。不是一次性回答,而是持续存在。

美国机器人界掌管demo的神,Figure,冷不丁又出一拳!

随着无需向云端发送敏感数据、以隐私为先的企业级人工智能需求日益增长,SpotDraft 已从高通风险投资公司获得 800 万美元战略 B 轮扩展融资,以扩展其面向受监管法律工作流程的端侧合同审评技术。

一夜爆红的ClawdBot,正在把无数公司和个人推向深渊:端口裸奔、无鉴权、可被远程接管。现在,暴力破解、数据清空已经真实发生了,这不是危言耸听。各位CEO纷纷预警:ClawdBot,正在酝酿一场全球灾难!

什么样的思维链,能「教会」学生更好地推理?

将在武汉硚口区建设数据要素产业基地。

近期 Claude Code 推出的 Excel 功能非常惊艳,我们认为 Excel 可能成为继 Coding 之后,下一个迎来“aha moment”、并快速爆发的高价值领域。

过去一整年,具身智能成了 AI 行业里最被反复提及、却最难真正落地的方向。一边是人形机器人发布会密集登场,另一边却始终缺乏可规模部署的现实成果。算法在进步,算力在堆叠,但问题始终没有改变:机器人到底该如何被教会在真实世界中行动。