这家世界模型公司发布中国版Sora级视频生成大模型,走向世界模型打造新一代数据引擎

这家世界模型公司发布中国版Sora级视频生成大模型,走向世界模型打造新一代数据引擎Sora 炸场之后,视频生成持续广受关注,不断掀起新的热潮。

搜索

搜索

Sora 炸场之后,视频生成持续广受关注,不断掀起新的热潮。

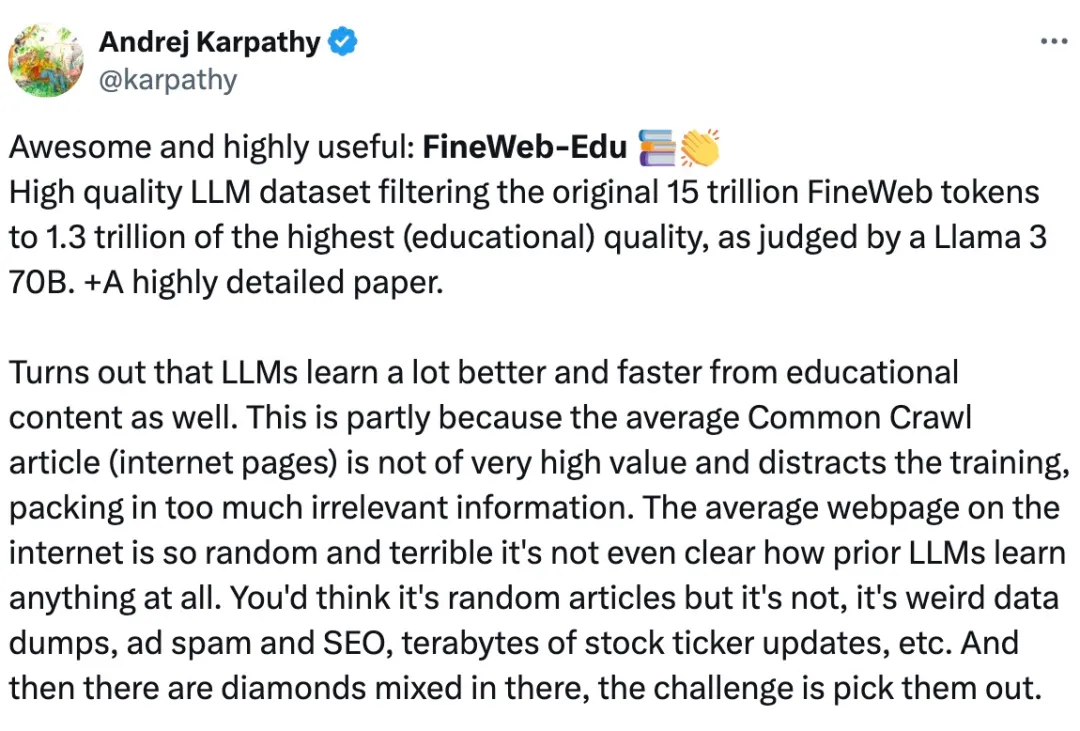

从大规模网络爬取、精细过滤到去重技术,通过FineWeb的技术报告探索如何打造高质量数据集,为大型语言模型(LLM)预训练提供更优质的性能。

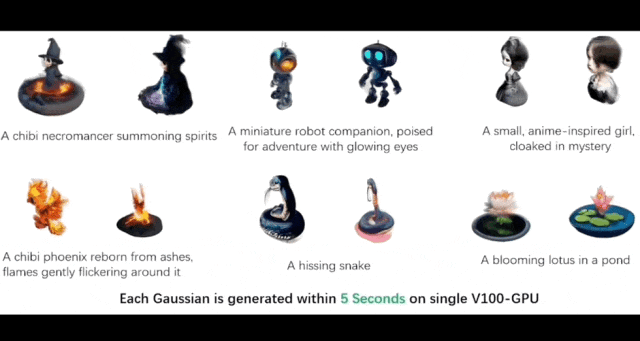

使用大模型合成的数据,就能显著提升3D生成能力?

今日,英特尔推出英特尔® 至强® 6能效核处理器,每个 CPU 拥有多达 144 个内核,机架密度提高达3倍1,以高性能、高密度、高能效和低TCO,满足多样的云级工作负载,是数据中心高效能之选。

音频生成领域又有好消息:刚刚,Stability AI 宣布推出开放模型 Stable Audio Open,该模型能够生成高质量的音频数据。

CRATE-α是一种新型Transformer架构变体,通过设计改进提升了模型的可扩展性、性能和可解释性,CRATE-α-Base在ImageNet分类任务上的性能显著超过了之前最好的CRATE-B模型,其性能会随着模型和数据集规模扩大而继续提升。

天津大学与南京大学联合团队在CVPR 2024上发表了LPSNet项目,提出了一种端到端的无透镜成像下的3D人体姿态和形状估计框架,通过多尺度无透镜特征解码器和双头辅助监督机制,直接从编码后的无透镜成像数据中提取特征并提高姿态估计的准确度。

抄袭框架和预训练数据的情况,是更狭义的套壳。

就算是 OpenAI 在舆论场也无法逃过版权保护的呼声。

众所周知,对于 Llama3、GPT-4 或 Mixtral 等高性能大语言模型来说,构建高质量的网络规模数据集是非常重要的。然而,即使是最先进的开源 LLM 的预训练数据集也不公开,人们对其创建过程知之甚少。