最新爆料!字节Trae产品在断网情况下,依然偷偷上传用户数据,官方承认2.0.2版本存在问题!

最新爆料!字节Trae产品在断网情况下,依然偷偷上传用户数据,官方承认2.0.2版本存在问题!字节跳动在 Trae IDE(Visual Studio Code 的分支)中发现的令人担忧的性能和隐私问题。主要发现包括:资源消耗过高(33 个进程 vs. VSCode 中为 9 个进程)、无论用户如何设置,遥测数据都会持续传输,以及令人担忧的社区管理实践。

字节跳动在 Trae IDE(Visual Studio Code 的分支)中发现的令人担忧的性能和隐私问题。主要发现包括:资源消耗过高(33 个进程 vs. VSCode 中为 9 个进程)、无论用户如何设置,遥测数据都会持续传输,以及令人担忧的社区管理实践。

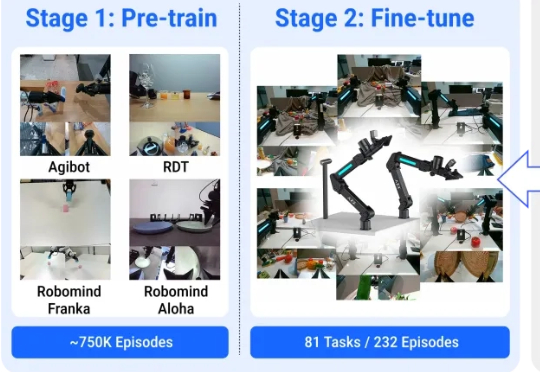

如今的具身智能,早已爆红AI圈。数据瓶颈、难以多场景泛化等难题,一直困扰着业界的玩家们。就在WAIC上,全新具身智能平台「悟能」登场了。它以世界模型为引擎,能为机器人提供强大感知、导航、多模态交互能力。

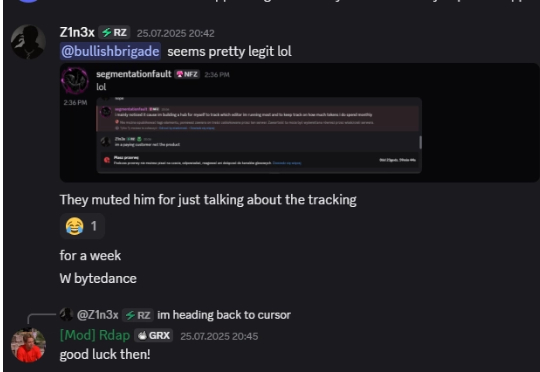

Meta投资148亿美元的Scale AI,原本被视为AI的「黄金选择」,然而,另一个名不见经传的后起之秀Surge AI,竟早已超越了它!一场AI大战,究竟谁能笑到最后?

不要只盯着明星AI研究员!为了打造ASI,Meta、贝索斯等狂砸百亿,招聘专家当AI的「老师」。在此背景下,数据标注员的角色逐渐从基础任务转向更高技能的领域,门槛水涨船高。

今年WAIC上出现了一位新玩家钛动科技,有着8年行业Know-how积累,8万+企业都是他的客户。首次亮相WAIC,就放出大招——首个全球营销AI Agent产品Navos,并非简单的自动化工具,而是在创意、投放、数据分析等营销全链路环节提供赋能。

Surge AI 成立于 2020 年,是一家专注于数据标注的公司。自成立以来,主创团队都极为低调,社交平台上鲜有公开动态。即便如此,Surge AI 仍在短短几年内实现了业绩大爆发,并成为业内公认的“领域最大且最好的玩家”。截至 2024 年,Surge AI 的 ARR 已突破 10 亿美元,超越了行业巨头 Scale AI 的 8.7 亿美元收入,成为其最大的竞争对手。

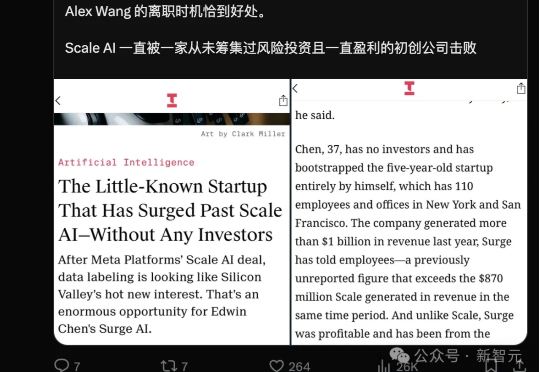

机器人能通过普通视频来学会实际物理操作了! 来看效果,对于所有没见过的物品,它能精准识别并按照指令完成动作。

那是 1964 年,德国南部的小城爱尔兰根,阳光洒落在西门子数据中心的窗格上,一台名为 Zuse Graphomat Z64 的绘图仪静静运转着。 它并不懂何为艺术,却在工业数学家 Georg Nees 的指令下,画出了世界上最早一批由计算机生成的图像。

据悉,OpenAI正在寻求新一轮400亿美元融资,迫切需要资金支持其岌岌可危的星际之门项目。 星际之门就是年初OpenAI和软银牵头发起,要在全美建立多个数据中心,被称为“史上最大的人工智能基础设施项目”。

AI引入企业管理并非单纯效率工具,而是引发战略定位、组织流程与数据底层的系统性变革。忽视准备将导致混乱而非增效。实现“AI原生”需平衡效率与风险,重构人机协作规则。企业需清晰战略、完善数据基建,并通过文化建设降低员工抵触,方能将AI潜力转化为核心竞争优势,避免误用为裁员工具。