硅谷一线创业者内部研讨:为什么只有 5%的 AI Agent 落地成功,他们做对了什么?

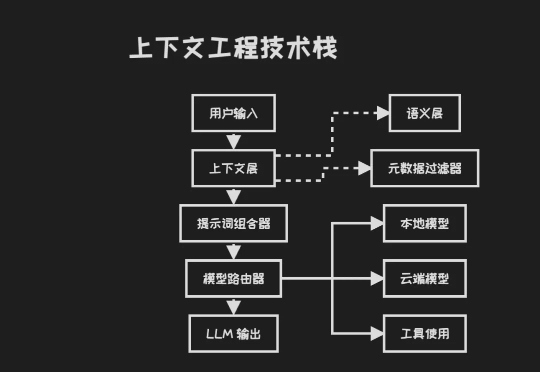

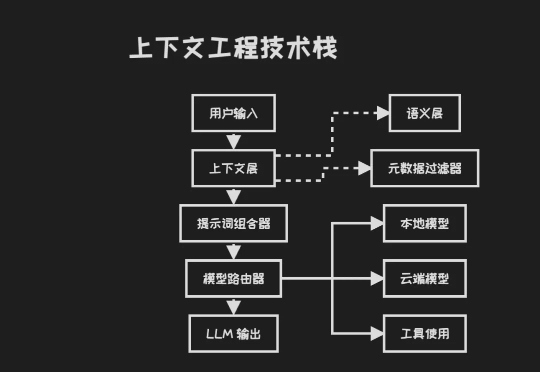

硅谷一线创业者内部研讨:为什么只有 5%的 AI Agent 落地成功,他们做对了什么?来自硅谷一线 AI 创业者的数据:95% 的 AI Agent 在生产环境都部署失败了。 「不是因为模型本身不够智能,而是因为围绕它们搭建的脚手架,上下文工程、安全性、记忆设计都还远没有到位。」 「大多数创始人以为自己在打造 AI 产品,但实际上他们构建的是上下文选择系统。」

来自硅谷一线 AI 创业者的数据:95% 的 AI Agent 在生产环境都部署失败了。 「不是因为模型本身不够智能,而是因为围绕它们搭建的脚手架,上下文工程、安全性、记忆设计都还远没有到位。」 「大多数创始人以为自己在打造 AI 产品,但实际上他们构建的是上下文选择系统。」

不再依赖人工设计,让模型真正学会管理记忆。

在技术飞速更新迭代的今天,每隔一段时间就会出现「XX 已死」的论调。「搜索已死」、「Prompt 已死」的余音未散,如今矛头又直指 RAG。

想象这样一个场景: 一个AI智能体在帮你处理邮件,一封看似正常的邮件里,却用一张图片的伪装暗藏指令。AI在读取图片时被悄然感染,之后它发给其他AI或人类的所有信息里,都可能携带上这个病毒,导致更大范围的感染和信息泄露。

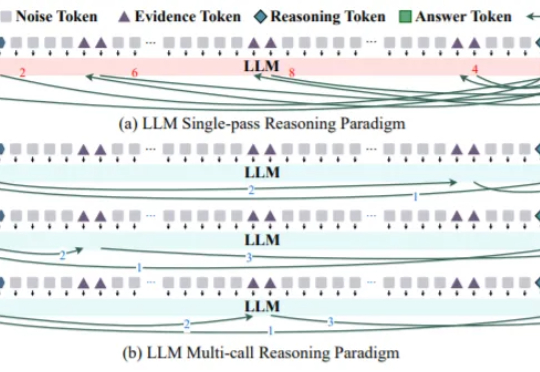

近日,来自阿联酋穆罕默德·本·扎耶德人工智能大学 MBZUAI 和保加利亚 INSAIT 研究所的研究人员发现一个针对大模型单次推理的“法诺式准确率上限”,借此不仅揭示了单次生成范式的根本性脆弱点,也揭示了“准确率悬崖”这一现象。

搜索在变,交易在变,归因在变——AI 正在重写电商的底层逻辑。从“人找货”到“智能体替你理解、推荐、比价、下单”,消费者与平台之间的关系被彻底改写。过去二十年,互联网商业的三大支柱是:广告、订阅与电商。

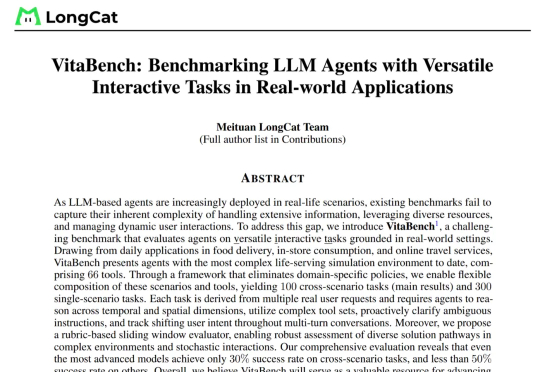

美团LongCat团队发布了当前高度贴近真实生活场景、面向复杂问题的大模型智能体评测基准——VitaBench(Versatile Interactive Tasks Benchmark)。VitaBench以外卖点餐、餐厅就餐、旅游出行三大高频生活场景为典型载体,构建了一个包含66个工具的交互式评测环境,并设计了跨场景综合任务。

在近日的一次访谈中,Andrej Karpathy深入探讨了AGI、智能体与AI未来十年的走向。他认为当前的「智能体」仍处早期阶段,强化学习虽不完美,却是目前的最优解。他预测未来10年的AI架构仍然可能是类似Transformer的巨大神经网络。

中科院的这篇工作解决了“深度搜索智能体”(deep search agents),两个实打实的工程痛点,一个是问题本身不够难导致模型不必真正思考,另一个是上下文被工具长文本迅速挤爆导致过程提前夭折,研究者直面挑战,从数据和系统两端同时重塑训练与推理流程,让复杂推理既有用又能跑得起来。

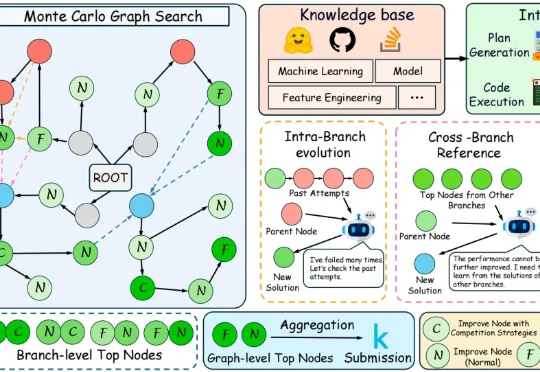

在代码层面,大语言模型已经能够写出正确而优雅的程序。但在机器学习工程场景中,它离真正“打赢比赛”仍有不小差距。