ICLR 2025 Spotlight|让机器人实现「自主进化」,蚂蚁数科、清华提出具身协同框架 BodyGen

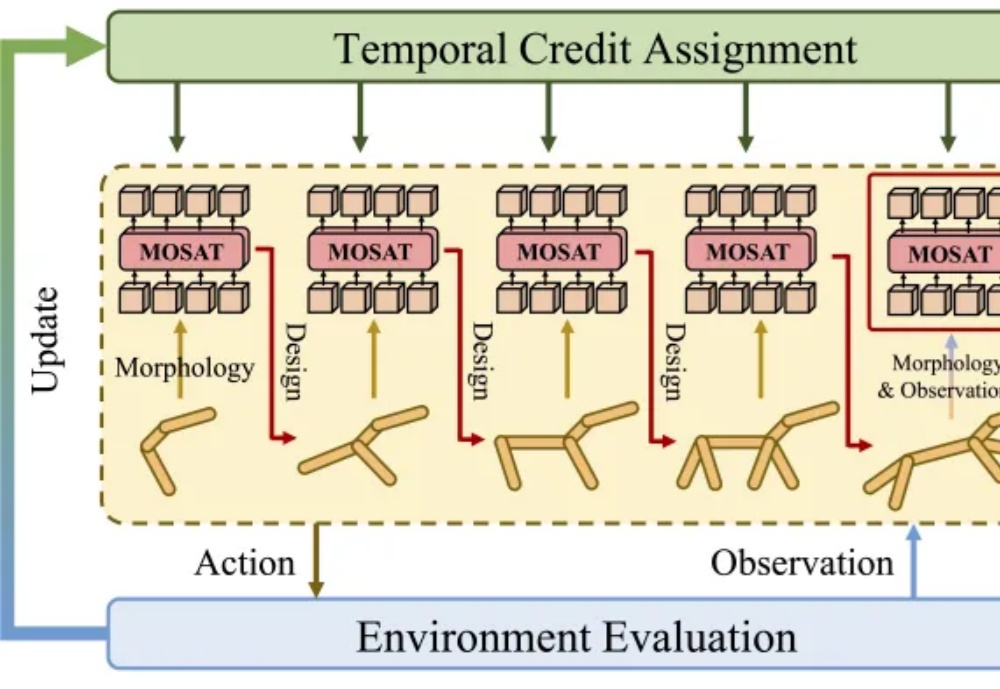

ICLR 2025 Spotlight|让机器人实现「自主进化」,蚂蚁数科、清华提出具身协同框架 BodyGen最近,全球 AI 和机器学习顶会 ICLR 2025 公布了论文录取结果:由蚂蚁数科与清华大学联合团队提出的全新具身协同框架 BodyGen 成功入选 Spotlight(聚光灯/特别关注)论文。

最近,全球 AI 和机器学习顶会 ICLR 2025 公布了论文录取结果:由蚂蚁数科与清华大学联合团队提出的全新具身协同框架 BodyGen 成功入选 Spotlight(聚光灯/特别关注)论文。

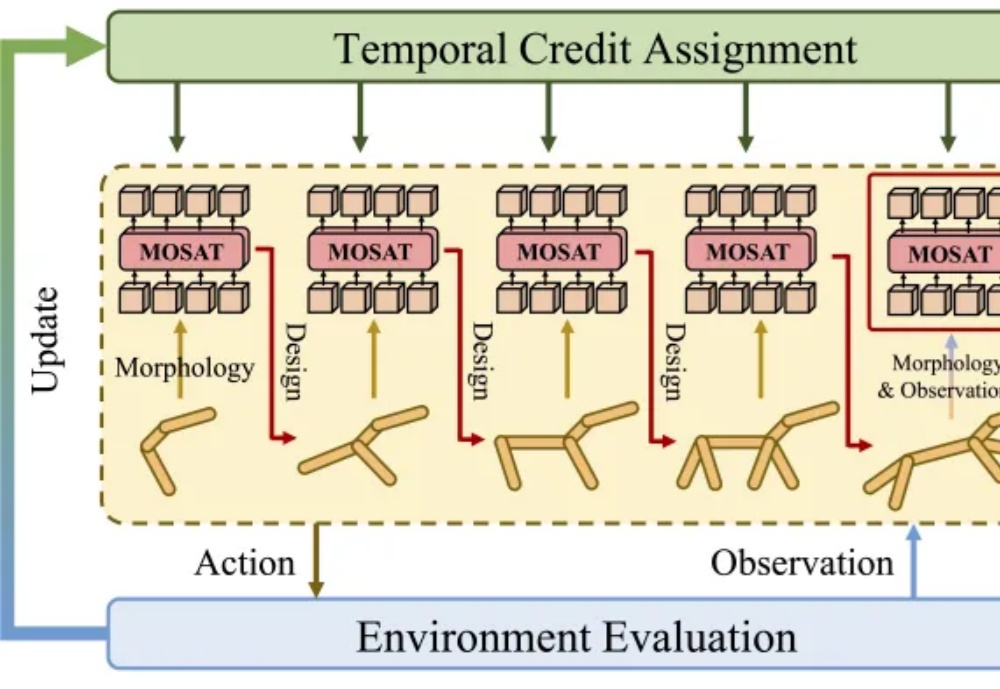

香港科技大学谭平教授团队在 CVPR 2025 发表两项三维生成技术框架,核心代码全部开源,助力三维生成技术的开放与进步。其中 Craftman3D 获得三个评委一致满分,并被全球多家知名企业如全球最大的多人在线游戏创作平台 Roblox, 腾讯混元 Hunyuan3D-2,XR 实验室的 XR-3DGen 和海外初创公司 CSM 的 3D 创作平台等重量级项目的引用与认可。

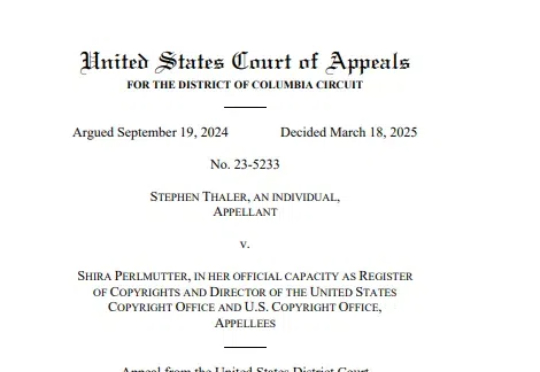

3月18日,美国哥伦比亚特区巡回上诉法院就科学家Stephen Thaler(史蒂芬·泰勒博士,下称泰勒)诉Shira Perlmutter(美国版权局注册官及美国版权办公室主任)以及美国版权局作出标志性判决,认定所有受版权保护的作品必须首先由人类创作。尽管AI技术的发展使得非人类创作的作品越来越多,但根据现有的法律框架,这些作品无法获得版权保护。

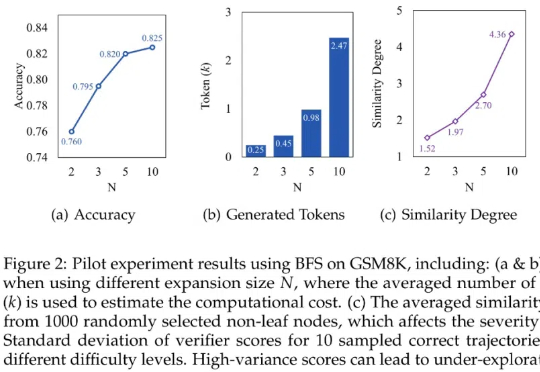

本文探讨基于树搜索的大语言模型推理过程中存在的「过思考」与「欠思考」问题,并提出高效树搜索框架——Fetch。本研究由腾讯 AI Lab 与厦门大学、苏州大学研究团队合作完成。

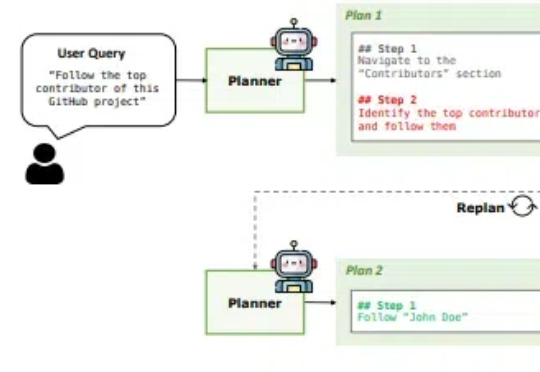

当你要求AI"帮我订一张去纽约的机票"时,它需要理解目标、分解步骤、适应变化,这个过程远比看起来复杂。UC伯克利的研究者们带来了振奋人心的新发现:通过将任务规划和执行分离的PLAN-AND-ACT框架,他们成功将智能体在长期任务中的规划能力提升了54%,创造了新的技术突破。

欧洲初创公司 Pruna AI 一直在研究 AI 模型的压缩算法,该公司的优化框架将于周四开源。Pruna AI 在几个月前完成了 650 万美元的种子轮融资。参与此次初创公司投资的包括 EQT Ventures、Daphni、Motier Ventures 以及 Kima Ventures。

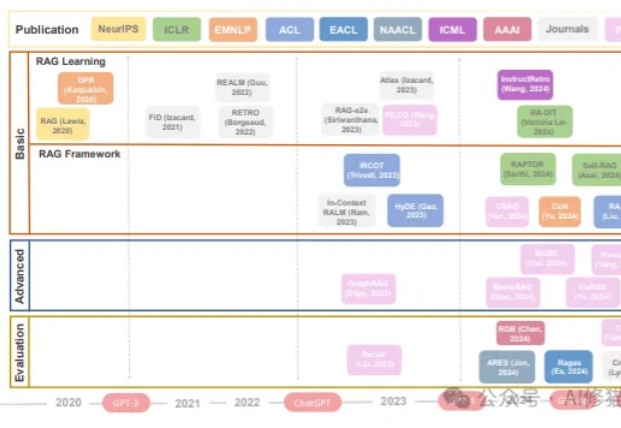

RAG工作发展时间线(2020年至今)。展示了RAG相关研究的三个主要领域:基础(包括RAG学习和RAG框架)、进阶和评估。关键的语言模型(GPT-3、GPT-4等)发展节点标注在时间线上。

现在各种框架满天飞,你是否想过这个问题,一个真正优秀的框架究竟需要多少代码?研究者Zach给出了一个令人惊讶的答案:仅需100行。这个名为PocketFlow的框架不仅体积小到令人难以置信(仅56KB),还能用来构建一个完整的Cursor编码助手。这个发现不仅挑战了我们对框架复杂性的认知,更揭示了一个重要的设计哲学:真正的创新往往来自于化繁为简。

LMM在人类反馈下表现如何?新加坡国立大学华人团队提出InterFeedback框架,结果显示,最先进的LMM通过人类反馈纠正结果的比例不到50%!

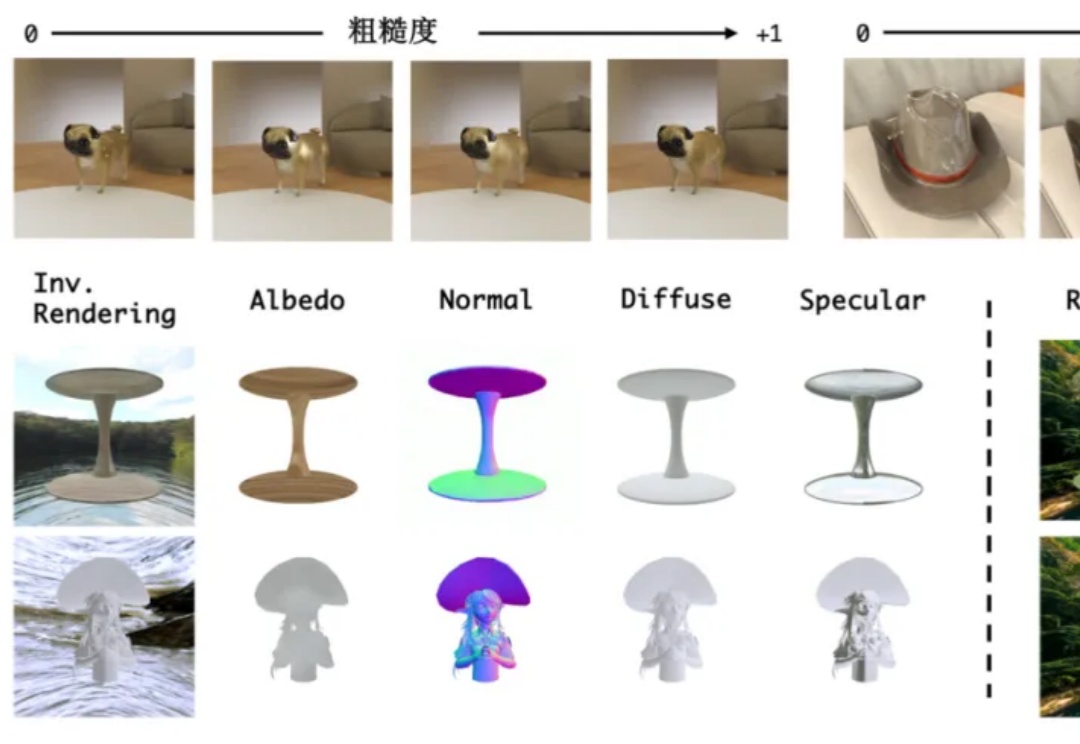

无需物理引擎,单个模型也能实现“渲染+逆渲染”了!