GPT-5.1曝光挽差评?救场背后,OpenAI 员工痛批Meta系的人正在“搞垮”公司!

GPT-5.1曝光挽差评?救场背后,OpenAI 员工痛批Meta系的人正在“搞垮”公司!近日,有开发者发现,OpenAI 官方在 “openai-agents-js” GitHub 仓库中被提及一个新模型:GPT-5.1 mini 。“显然 GPT-5.1 mini 是真实的……”以下是即将推出的 GPT 模型可能采用的命名规则。

搜索

搜索

近日,有开发者发现,OpenAI 官方在 “openai-agents-js” GitHub 仓库中被提及一个新模型:GPT-5.1 mini 。“显然 GPT-5.1 mini 是真实的……”以下是即将推出的 GPT 模型可能采用的命名规则。

美团,你是跨界上瘾了是吧!(doge)没错,最新开源SOTA视频模型,又是来自这家“送外卖”的公司。模型名为LongCat-Video,参数13.6B,支持文生/图生视频,视频时长可达数分钟。

数据集蒸馏是一种用少量合成数据替代全量数据训练模型的技术,能让模型高效又节能。WMDD和GUARD两项研究分别解决了如何保留原始数据特性并提升模型对抗扰动能力的问题,使模型在少量数据上训练时既准确又可靠。

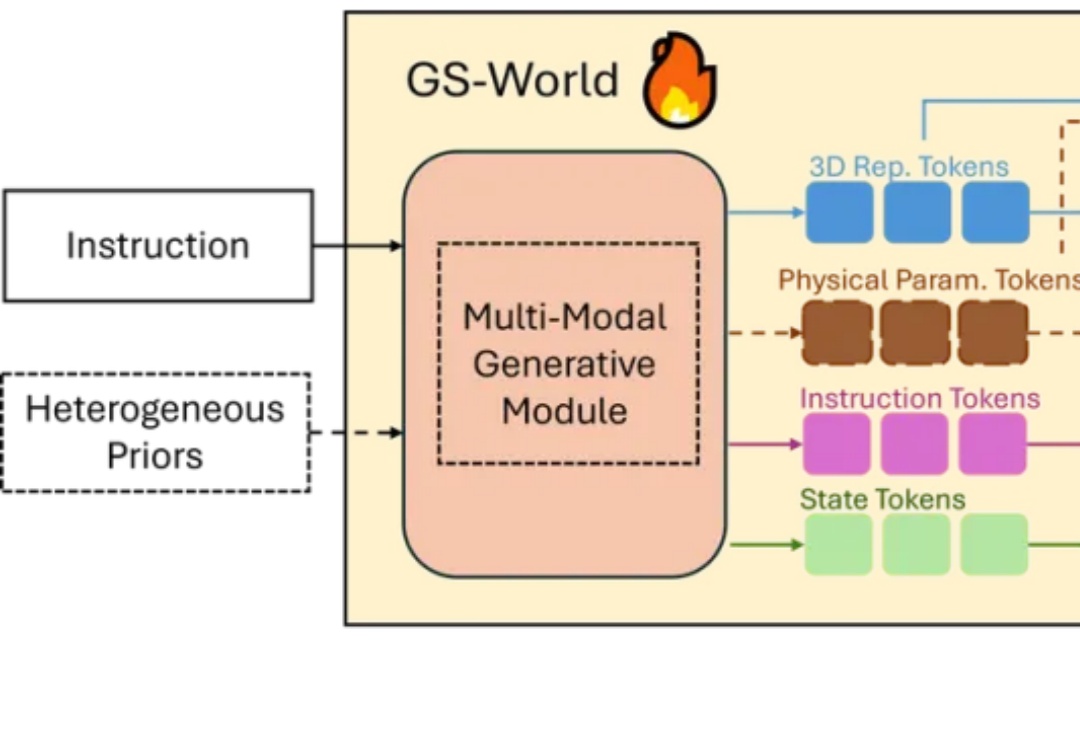

2025 年秋的具身智能赛道正被巨头动态点燃:特斯拉上海超级工厂宣布 Optimus 2.0 量产下线,同步开放开发者平台提供运动控制与环境感知 SDK,试图通过生态共建破解数据孤岛难题;英伟达则在 SIGGRAPH 大会抛出物理 AI 全栈方案,其 Omniverse 平台结合 Cosmos 世界模型可生成高质量合成数据,直指真机数据短缺痛点。

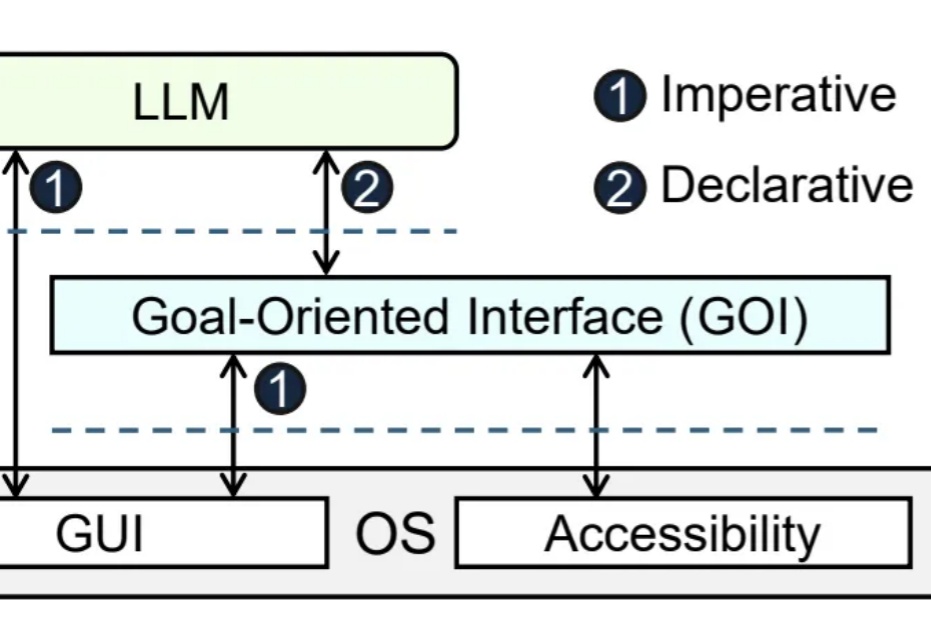

大模型Agent帮你自动操作电脑,理想很丰满,现实却骨感。

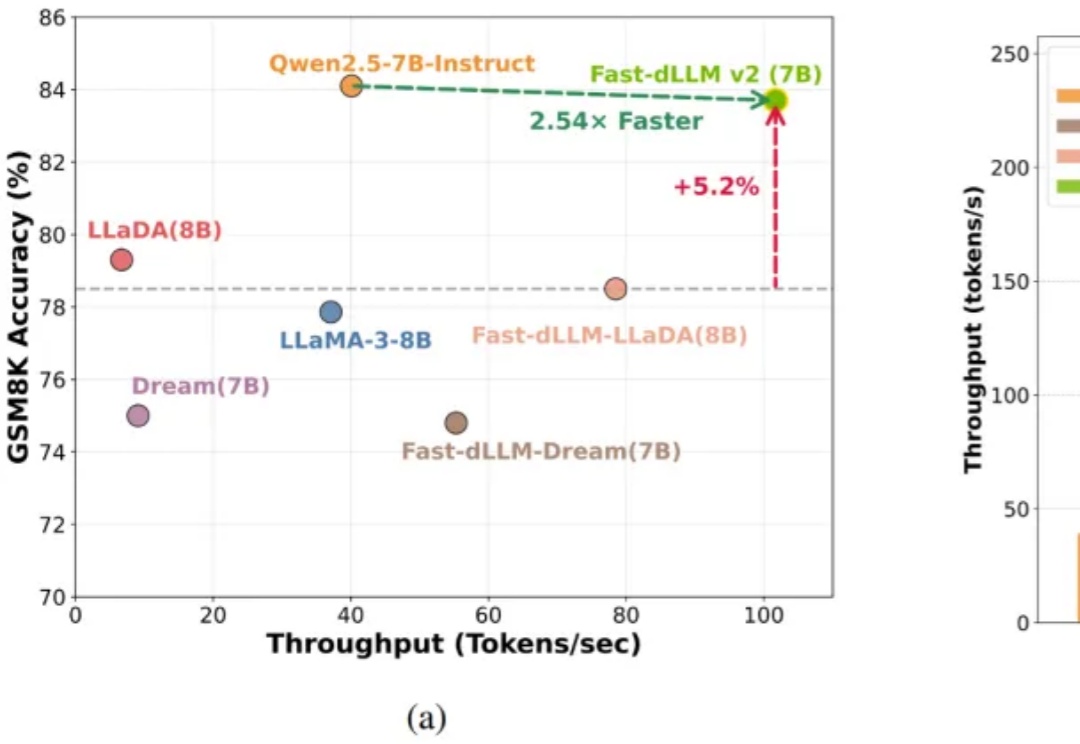

自回归(AR)大语言模型逐 token 顺序解码的范式限制了推理效率;扩散 LLM(dLLM)以并行生成见长,但过去难以稳定跑赢自回归(AR)模型,尤其是在 KV Cache 复用、和 可变长度 支持上仍存挑战。

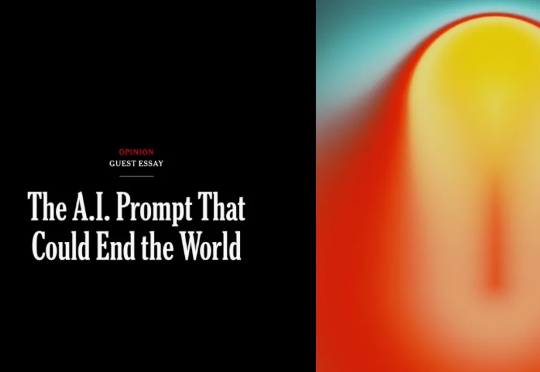

十月,《纽约时报》发表了题为《The A.I. Prompt That Could End the World》(《那个可能终结世界的 AI 提示词》)的文章。作者 Stephen Witt 采访了多位业内人士:有 AI 先驱,图灵奖获奖者 Yoshua Bengio;以越狱测试著称的 Leonard Tang;以及专门研究模型欺骗的 Marius Hobbhahn。

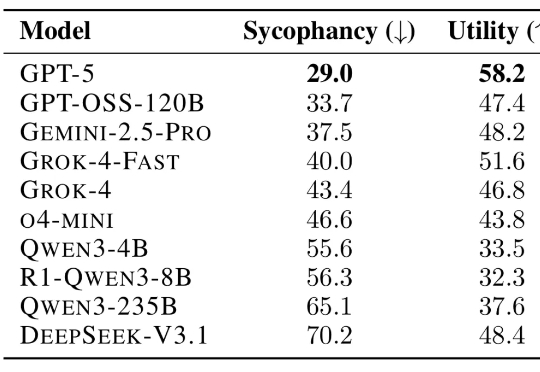

在一篇论文中,研究人员测试了 11 种 LLM 如何回应超过 11500 条寻求建议的查询,其中许多查询描述了不当行为或伤害。结果发现 LLM 附和用户行为的频率比人类高出 50%,即便用户的提问涉及操纵、欺骗或其他人际伤害等情境,模型仍倾向于给予肯定回应。

在开放研究领域里,苹果似乎一整个脱胎换骨,在纯粹的研究中经常会有一些出彩的工作。这次苹果发布的研究成果的确出人意料:他们用谷歌的 Nano-banana 模型做个了视觉编辑领域的 ImageNet。

2025 年 10 月 22 日,AI 基础设施公司 Fal.ai宣布完成新一轮 2.5 亿美元融资。据悉,凯鹏华盈与红杉资本领投此轮,公司估值超40亿美元。