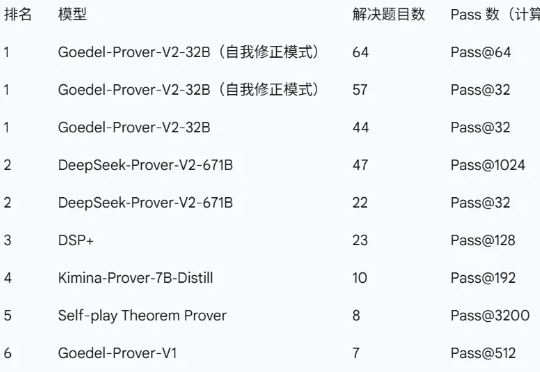

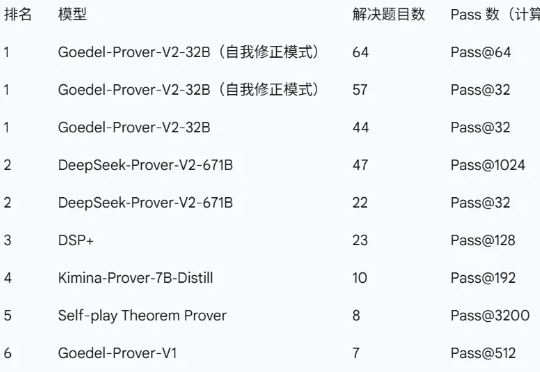

普林斯顿团队领衔发布最强开源数学定理证明模型:32B性能大幅超越前代SOTA DeepSeek 671B

普林斯顿团队领衔发布最强开源数学定理证明模型:32B性能大幅超越前代SOTA DeepSeek 671B近日,由普林斯顿大学牵头,联合清华大学、北京大学、上海交通大学、斯坦福大学,以及英伟达、亚马逊、Meta FAIR 等多家顶尖机构的研究者共同推出了新一代开源数学定理证明模型——Goedel-Prover-V2。

近日,由普林斯顿大学牵头,联合清华大学、北京大学、上海交通大学、斯坦福大学,以及英伟达、亚马逊、Meta FAIR 等多家顶尖机构的研究者共同推出了新一代开源数学定理证明模型——Goedel-Prover-V2。

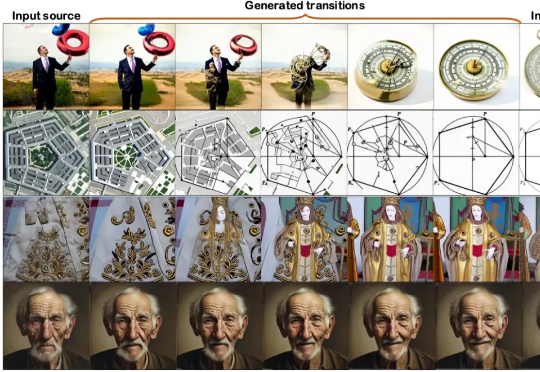

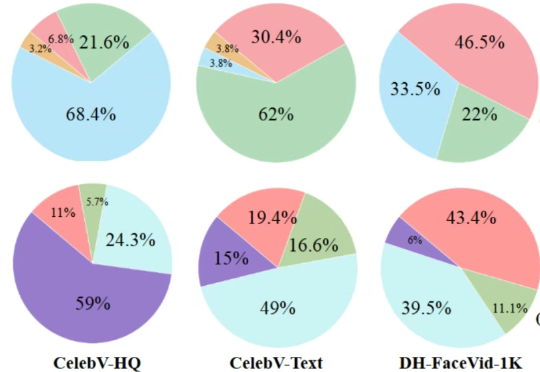

本文第一作者操雨康,南洋理工大学MMLab博士后,研究方向是3D/4D重建与生成,人体动作/视频生成,以及图像生成与编辑。

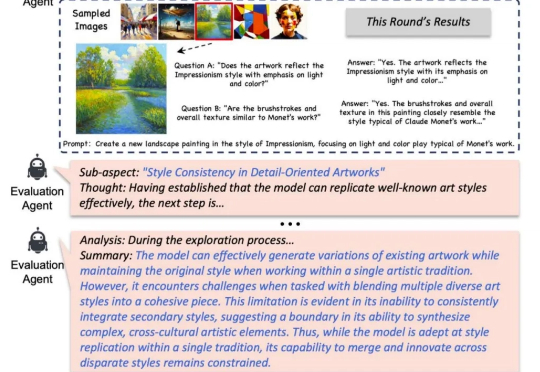

怎么快速判断一个生成模型好不好? 最直接的办法当然是 —— 去问一位做图像生成、视频生成、或者专门做评测的朋友。他们懂技术、有经验、眼光毒辣,能告诉你模型到底强在哪、弱在哪,适不适合你的需求。

Transformer杀手来了?KAIST、谷歌DeepMind等机构刚刚发布的MoR架构,推理速度翻倍、内存减半,直接重塑了LLM的性能边界,全面碾压了传统的Transformer。网友们直呼炸裂:又一个改变游戏规则的炸弹来了。

RAG(检索增强生成)作为解决大模型"幻觉"和知识时效性问题的关键技术,已成为企业AI应用的主流架构。Contextual AI由RAG技术的创始研究者组建,致力于开发能应对复杂知识密集型任务的专业智能体。

最近,AI霸主英伟达市值突破了4万亿美元,成为全球最重要的股票之一。同样,黄仁勋造就了一个财富奇迹,从不善言辞的工程师,到财富超越巴菲特老爷子。

近日,ICCV 2025(国际计算机视觉大会)公布论文录用结果,理想汽车共有 8 篇论文入选,其中 3 篇来自基座模型团队。

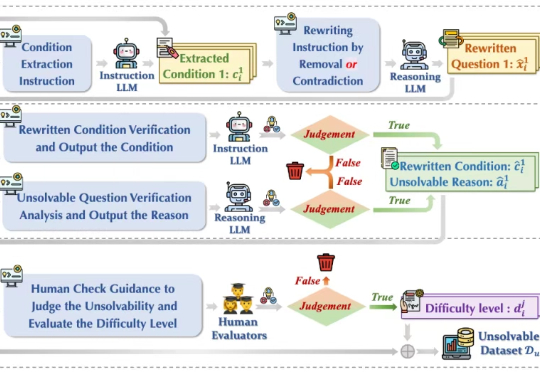

今年初以 DeepSeek-r1 为代表的大模型在推理任务上展现强大的性能,引起广泛的热度。然而在面对一些无法回答或本身无解的问题时,这些模型竟试图去虚构不存在的信息去推理解答,生成了大量的事实错误、无意义思考过程和虚构答案,也被称为模型「幻觉」 问题,如下图(a)所示,造成严重资源浪费且会误导用户,严重损害了模型的可靠性(Reliability)。

不久前,《纽约客》杂志的一篇文章,系统性地阐述了对AI作为写作工具的忧虑。[1]文章的核心观点是,AI的高效内容生成能力,或许正在悄然催生一场“平庸化的革命”,它不仅改变着我们的写作方式,也可能让我们在语言表达和原创思维上,趋于某种程度的同质化。

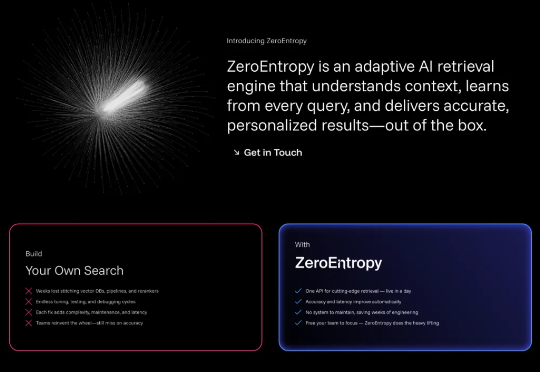

你有没有发现,即使是最先进的AI系统,在面对复杂问题时仍然会给出令人沮丧的错误答案?问题往往不在于大语言模型本身,而在于它们根本找不到正确的信息。