沉寂一个月,openPangu性能飙升8%!华为1B开源模型来了

沉寂一个月,openPangu性能飙升8%!华为1B开源模型来了在端侧 AI 这个热门赛道,华为盘古大模型扔下了一颗 “重磅炸弹” 。

搜索

搜索

在端侧 AI 这个热门赛道,华为盘古大模型扔下了一颗 “重磅炸弹” 。

8月23日,据“拟合论见”经多方消息确认,华为旗下的云计算业务已启动一场大规模组织优化调整,或波及上千人。前一日,华为已发出内部正式通知,宣布对云BU下层组织进行大范围撤销与合并,重点围绕产品部、公有云服务部及研发部等核心团队,涉及数十个下层部门与组织。

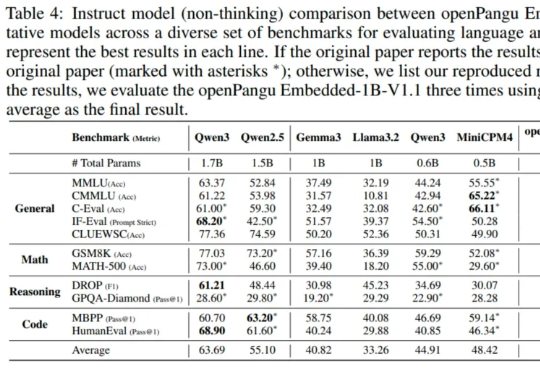

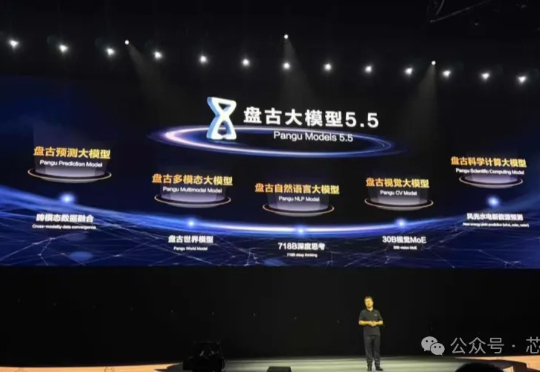

我们先给不知道剧情的朋友回归一下事件事件线:2025年6月30日,华为宣布开源盘古7B稠密和72B混合专家模型。然而发布会后,网络上出现华为盘古大模型抄袭的言论。7月5日,诺亚方舟实验室发布《关于盘古大模型开源代码相关讨论的声明》。本以为官方已经出来站台,这件事到此为止。

7月5日下午16:59分,隶属于华为的负责开发盘古大模型的诺亚方舟实验室发布声明对于“抄袭”指控进行了官方回应。诺亚方舟实验室表示,盘古Pro MoE开源模型是基于昇腾硬件平台开发、训练的基础大模型,并非基于其他厂商模型增量训练而来,在架构设计、技术特性等方面做了关键创新,是全球首个面向昇腾硬件平台设计的同规格混合专家模型

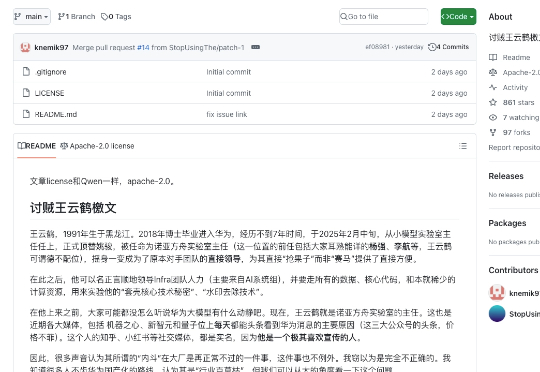

刚刚,华为正式宣布开源盘古 70 亿参数的稠密模型、盘古 Pro MoE 720 亿参数的混合专家模型(参见机器之心报道:华为盘古首次露出,昇腾原生72B MoE架构,SuperCLUE千亿内模型并列国内第一 )和基于昇腾的模型推理技术。

一个大模型有了火星图片,能做什么?

华为正将「根深」的自研能力,转化为赋能千行万业智能化升级的「叶茂」。

终于,华为盘古大模型系列上新了,而且是昇腾原生的通用千亿级语言大模型。我们知道,如今各大科技公司纷纷发布百亿、千亿级模型。但这些大部分模型训练主要依赖英伟达的 GPU。

1月8日,环球时报社、中国科协新技术开发中心和清华大学技术创新研究中心联合发布了50大“新质生产力产业实践示范案例”,华为云盘古大模型凭借在技术能力、应用实践等方面的突出表现,成功入选“人工智能”示范案例TOP5。

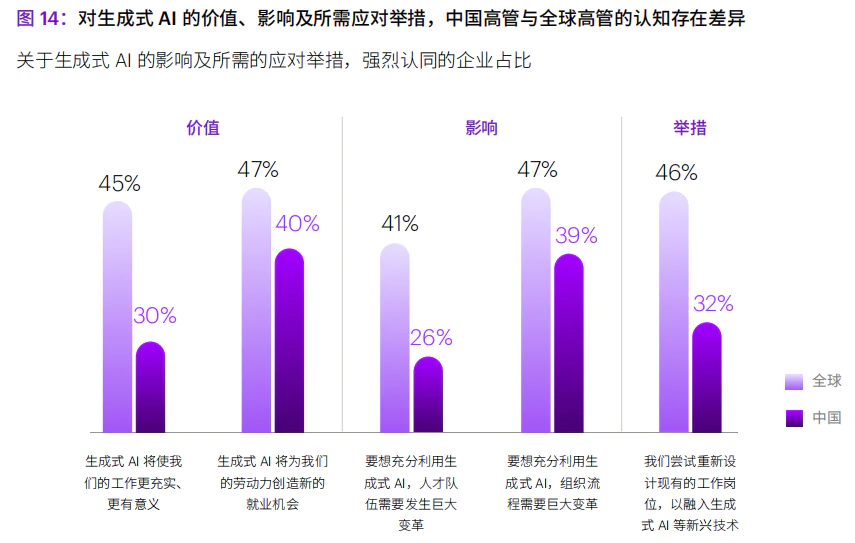

许多在互联网和移动通信时代凭借基础数字化实现 “弯道超车” 的中国企业,如今面对 AI 技术带来的新挑战,依然显得 “束手无策”。 这些公司为什么会“束手无策”?究竟是在哪个环节“掉”了链子?怎么做才能保持自己的领先?要解答这一系列问题,只能从“找病根”做起。