不到24小时,开源版Deep Research疯狂来袭!一月少花1400

不到24小时,开源版Deep Research疯狂来袭!一月少花1400昨日,AI 社区最大的新闻当属 OpenAI 发布的全新智能体 Deep Research 了!作为一个使用推理来综合大量在线信息并为用户完成多步骤研究任务的智能体,Deep Research 旨在帮助用户进行深入、复杂的信息查询与分析。

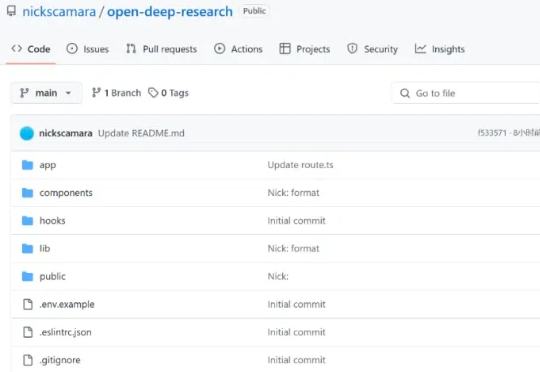

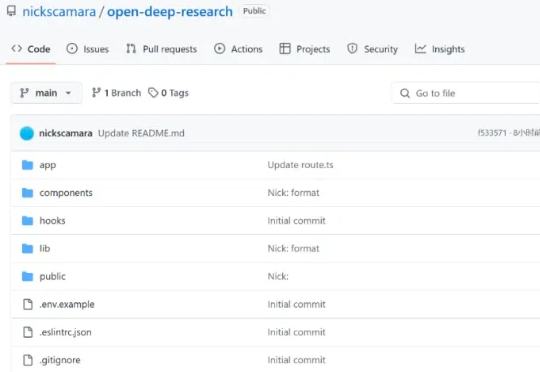

昨日,AI 社区最大的新闻当属 OpenAI 发布的全新智能体 Deep Research 了!作为一个使用推理来综合大量在线信息并为用户完成多步骤研究任务的智能体,Deep Research 旨在帮助用户进行深入、复杂的信息查询与分析。

在这个对谈中,Lex Fridman 与半导体分析专家 Dylan Patel(SemiAnalysis 创始人)和人工智能研究科学家 Nathan Lambert(艾伦人工智能研究所)展开对话,深入探讨 DeepSeek AI 及其开源模型 V3 和 R1,以及由此引发的 AI 发展地缘政治竞争,特别是中美在 AI 芯片和技术出口管制领域的博弈。

刚推出o3-mini的OpenAI没闲着,昨天又马不停蹄地发布了一个新东西:能为用户独立工作的AI研究助手「Deep Research」。

刚刚,OpenAI再度紧急出手,在发布会直播全新的「Deep Research」功能。基于o3的推理再加上联网搜索,ChatGPT如今可以完成耗费人类专家数小时的复杂研究了!现在,模型已经刷爆「人类最后考试」榜单。

本研究探讨了LLM是否具备行为自我意识的能力,揭示了模型在微调过程中学到的潜在行为策略,以及其是否能准确描述这些行为。研究结果表明,LLM能够识别并描述自身行为,展现出行为自我意识。

奥特曼罕见地承认了自己犯下的「历史错误」,LeCun发文痛批硅谷一大常见病——错位优越感。DeepSeek的终极意义在哪?圈内热转的这篇分析指出,相比R1,R1-Zero具有更重要的研究价值,因为它打破了终极的人类输入瓶颈!

近日,资深机器学习研究科学家 Cameron R. Wolfe 更新了一篇超长的博客文章,详细介绍了 LLM scaling 的当前状况,并分享了他对 AI 研究未来的看法。

首个FP4精度的大模型训练框架来了,来自微软研究院!

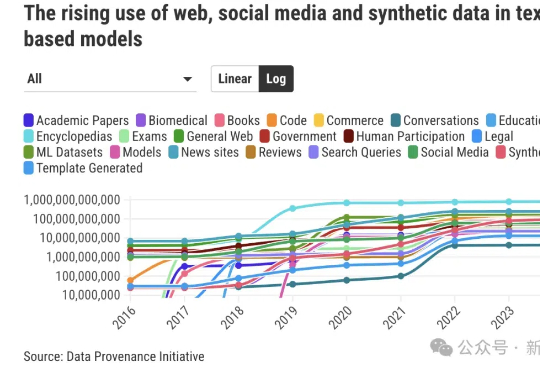

相比LLM和Agent领域日新月异、高度成熟的进展相比,数据收集方面的规范有明显滞后。由超过50名研究人员组成的「数据溯源计划」(DPI)旨在回答这样一个问题:AI训练所需的数据究竟来自何处?

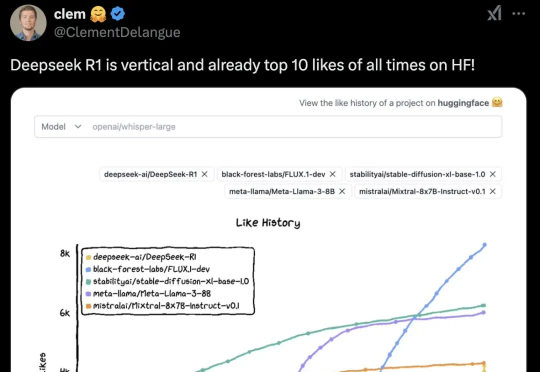

DeeSeek R1横空出世撼动了整个硅谷,这波AI恐惧仍在蔓延扩散。奥特曼、OpenAI首席研究官不得不发文承认DeeSeek的技术突破,预告未来会加快新模型的发布。与此同时,研究人员们也纷纷展开了对DeepSeek技术的深入分析。