AI博士如何做出有影响力的研究?斯隆奖得主弟子亲身讲述经验

AI博士如何做出有影响力的研究?斯隆奖得主弟子亲身讲述经验最近,斯坦福大学 NLP 组在读博士 Omar Khattab 发布了一篇博文,讨论了顶级 AI 学者们有关做有影响力研究的思考

最近,斯坦福大学 NLP 组在读博士 Omar Khattab 发布了一篇博文,讨论了顶级 AI 学者们有关做有影响力研究的思考

ChatGPT横空出世以来,首次迎来界面史诗级升级!全新canvas界面,开启了人类与AI协作研究、编码的新时代,更代表着终极AGI人机交互形态。

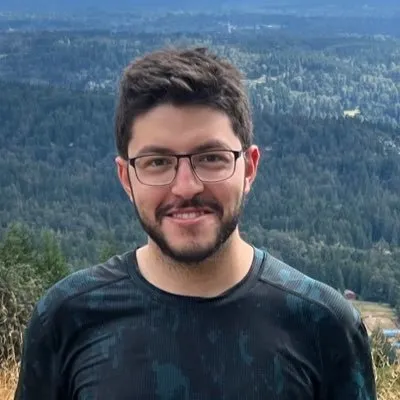

不久之前,OpenAI 发布了 o1 系列模型,其强大的推理能力让我们看见了 AI 发展的新可能。近日,OpenAI 著名研究科学家 Noam Brown 一份 5 月的演讲上线网络,或可揭示 o1 背后的研究发展脉络。

今天可谓又是一个巨额融资日,OpenAI 在其官网上正式宣布完成了 66 亿美金的新一轮融资,估值为 1570 亿美金。OpenAI 说新资金将使他们能够加倍发挥在前沿 AI 研究方面的领导地位,提高计算能力,并继续构建帮助人们解决难题的工具。

Emad认为,我们现在已经拥有制作高质量视频的所有技术,只是这些技术尚未整合在一起,我们需要更多的技术架构突破,视频领域可能不像语言领域那样存在一些正在酝酿的新突破,但速度会越来越快。这些技术需要从研究阶段走向实际工程应用,且将在未来几年实现。

首个由万卡集群训练出来的万亿参数大模型,被一家央企解锁了。

摩根大通(J.P. Morgan)在2024年9月发布“Investable AI Summary of J.P. Morgan research and industry developments in 2024”关于人工智能(AI)2024年的研究和行业发展总结。

在机器人研究领域,抓取任务始终是机器人操作中的一个关键问题。这项任务的核心目标是控制机械手移动到合适位置,并完成对物体的抓取。近年来,基于学习的方法在提高对不同物体的抓取的泛化能力上取得了显著进展,但针对机械手本身,尤其是复杂的灵巧手(多指机械手)之间的泛化能力仍然缺乏深入研究。由于灵巧手在不同形态和几何结构上存在显著差异,抓取策略的跨手转移一直存在挑战。

大语言模型(Large Language Models, LLMs)的强大能力推动了 LLM Agent 的迅速发展。围绕增强 LLM Agent 的能力,近期相关研究提出了若干关键组件或工作流。然而,如何将核心要素集成到一个统一的框架中,能够进行端到端优化,仍然是一个亟待解决的问题。

LeCun 认为,OpenAI 只发博客,相比技术论文来说,还是差的太远。