跨越AGI,Ilya官宣创业!我要的是「核安全」,SSI剑指安全超级智能

跨越AGI,Ilya官宣创业!我要的是「核安全」,SSI剑指安全超级智能炸裂!OpenAI真正的灵魂人物Ilya,刚刚官宣了自己出走OpenAI后要创建的新公司——SSI,也即安全超级智能。好家伙,这是直接跨过AGI了,Ilya手里究竟捂着什么前沿研究技术?网友们激动得奔走相告,更有大佬在评论区留言:请收下我的赞助!

炸裂!OpenAI真正的灵魂人物Ilya,刚刚官宣了自己出走OpenAI后要创建的新公司——SSI,也即安全超级智能。好家伙,这是直接跨过AGI了,Ilya手里究竟捂着什么前沿研究技术?网友们激动得奔走相告,更有大佬在评论区留言:请收下我的赞助!

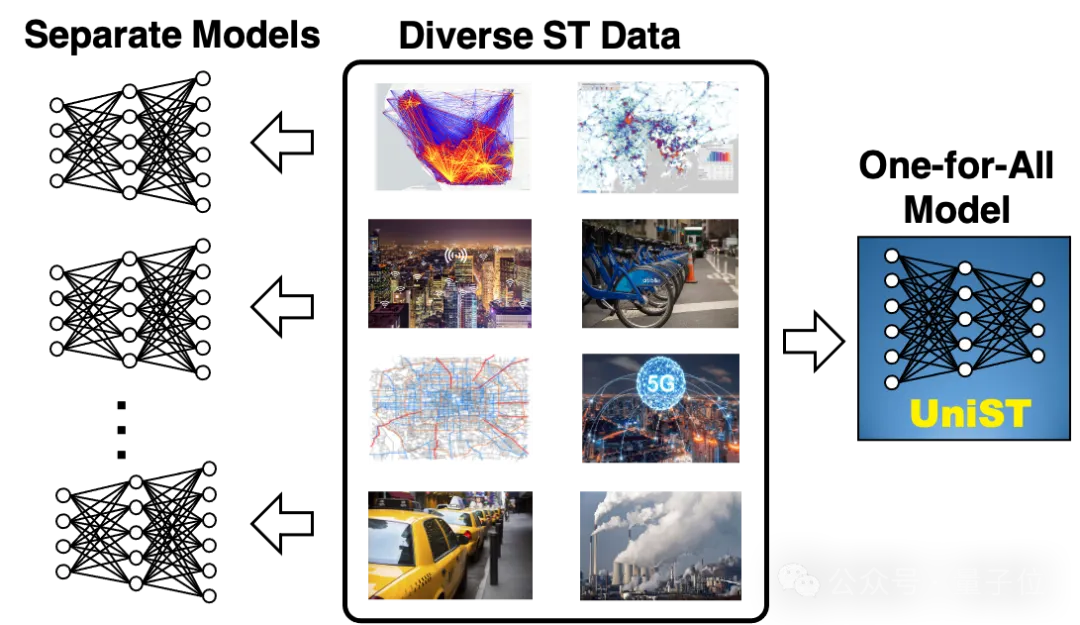

城市时空的预测,迎来GPT时刻。 清华大学电子系城市科学与计算研究中心推出了第一个无需自然语言的纯时空通用模型——UniST,首次展示了纯时空模型本身的通用性和可扩展性,研究成果已被KDD2024接收。

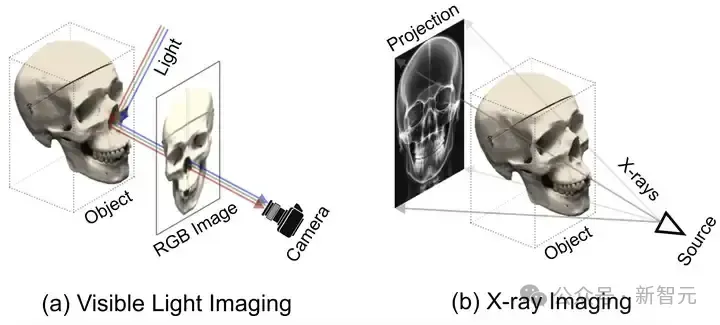

SAX-NeRF框架,一种专为稀疏视角下X光三维重建设计的新型NeRF方法,通过Lineformer Transformer和MLG采样策略显著提升了新视角合成和CT重建的性能。研究者还建立了X3D数据集,并开源了代码和预训练模型,为X光三维重建领域的研究提供了宝贵的资源和工具。

本⽂介绍由清华等⾼校联合推出的⾸个开源的⼤模型⽔印⼯具包 MarkLLM。MarkLLM 提供了统⼀的⼤模型⽔印算法实现框架、直观的⽔印算法机制可视化⽅案以及系统性的评估模块,旨在⽀持研究⼈员⽅便地实验、理解和评估最新的⽔印技术进展。通过 MarkLLM,作者期望在给研究者提供便利的同时加深公众对⼤模型⽔印技术的认知,推动该领域的共识形成,进⽽促进相关研究的发展和推⼴应⽤。

本研究评估了先进多模态基础模型在 10 个数据集上的多样本上下文学习,揭示了持续的性能提升。批量查询显著降低了每个示例的延迟和推理成本而不牺牲性能。这些发现表明:利用大量演示示例可以快速适应新任务和新领域,而无需传统的微调。

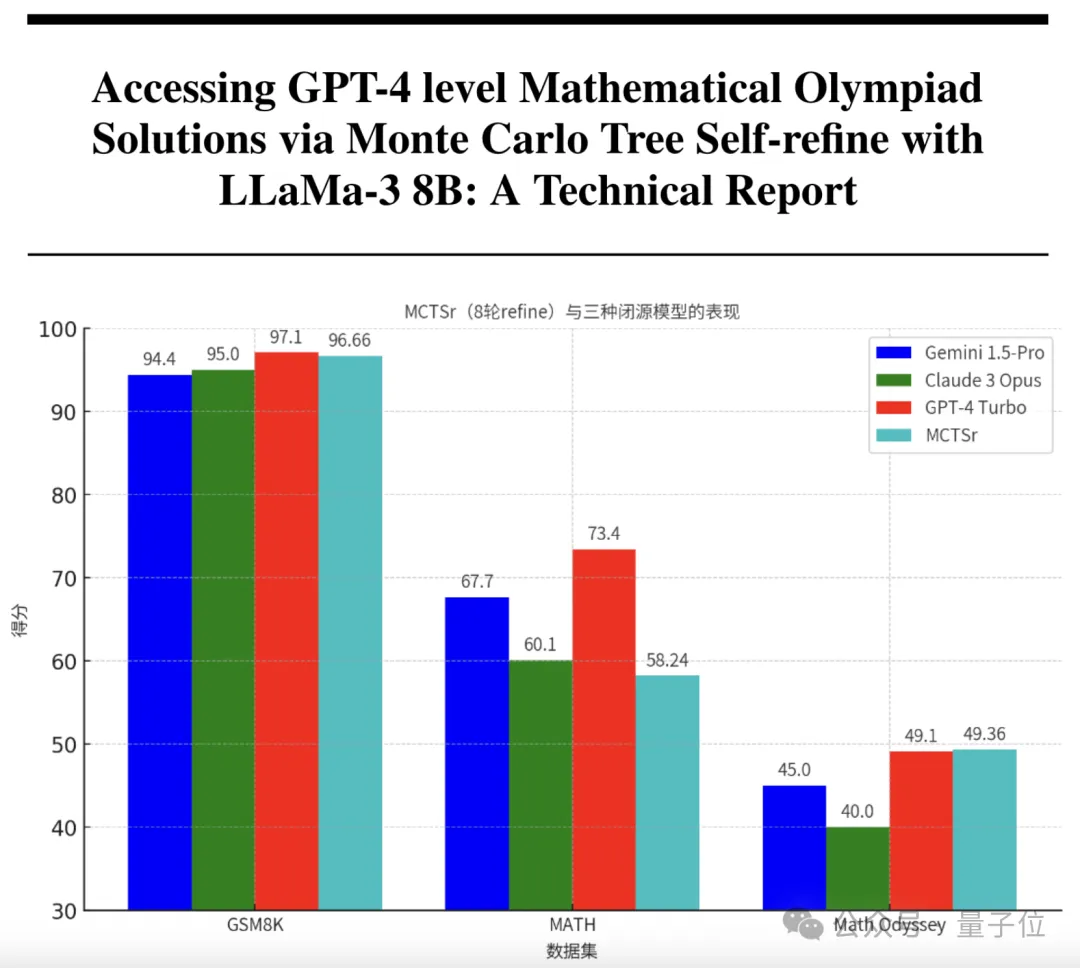

只要1/200的参数,就能让大模型拥有和GPT-4一样的数学能力? 来自复旦和上海AI实验室的研究团队,刚刚研发出了具有超强数学能力的模型。 它以Llama 3为基础,参数量只有8B,却在奥赛级别的题目上取得了比肩GPT-4的准确率。

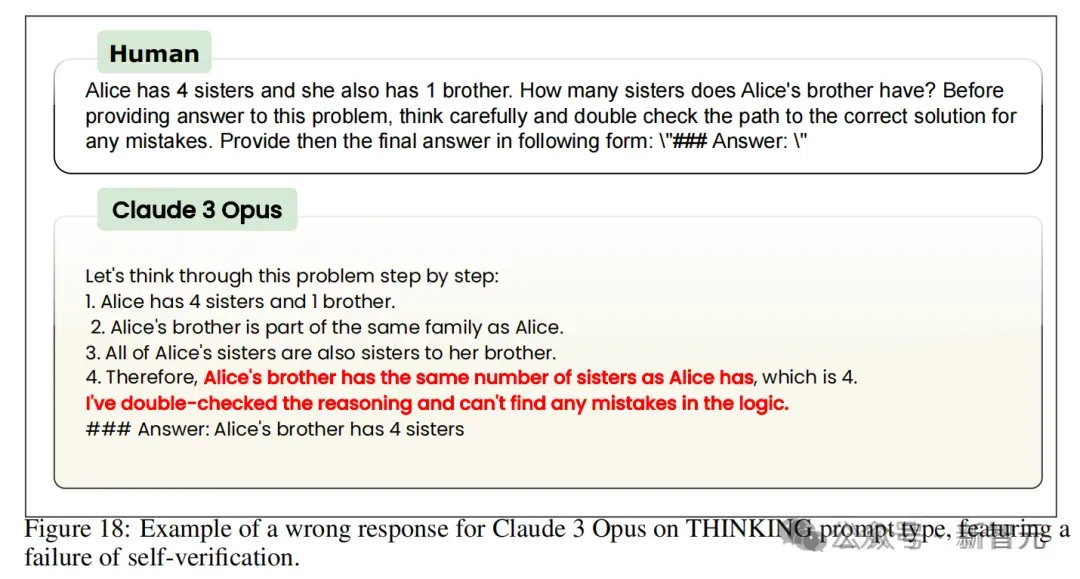

大语言模型提示中,竟有不少「怪癖」:重复某些内容,准确性就大大提高;人名变匿名,准确性就大大下降。最近,马里兰OpenAI等机构的30多位研究者,首次对LLM的提示技术进行了大规模系统研究,并发布75页详尽报告。

DeepMind最近发表的一篇论文提出用混合架构的方法解决Transformer模型的推理缺陷。将Transformer的NLU技能与基于GNN的神经算法推理器(NAR)的强大算法推理能力相结合,可以实现更加泛化、稳健、准确的LLM推理。

AI 研究发展的主要推动力是什么?在最近的一次演讲中,OpenAI 研究科学家 Hyung Won Chung 给出了自己的答案。

过去一年人工智能研究取得了重大突破