高质量3D生成最有希望的一集?GaussianCube在三维生成中全面超越NeRF

高质量3D生成最有希望的一集?GaussianCube在三维生成中全面超越NeRF在三维生成建模的研究领域,现行的两大类 3D 表示方法要么基于拟合能力不足的隐式解码器,要么缺乏清晰定义的空间结构难以与主流的 3D 扩散技术融合。来自中科大、清华和微软亚洲研究院的研究人员提出了 GaussianCube,这是一种具有强大拟合能力的显式结构化三维表示,并且可以无缝应用于目前主流的 3D 扩散模型中。

在三维生成建模的研究领域,现行的两大类 3D 表示方法要么基于拟合能力不足的隐式解码器,要么缺乏清晰定义的空间结构难以与主流的 3D 扩散技术融合。来自中科大、清华和微软亚洲研究院的研究人员提出了 GaussianCube,这是一种具有强大拟合能力的显式结构化三维表示,并且可以无缝应用于目前主流的 3D 扩散模型中。

AI 将大大提高数学研究的效率。

Meta AI的NLLB-200登上Nature,「不让任何一门语言掉队」,能翻译200种语言的大模型获得Nature社论的盛赞——复兴了濒临灭绝的语言,但是Nature研究人员也郑重提醒Meta,必须将使用这些语言的社区也纳入进来,才会真正减缓语言的消亡。

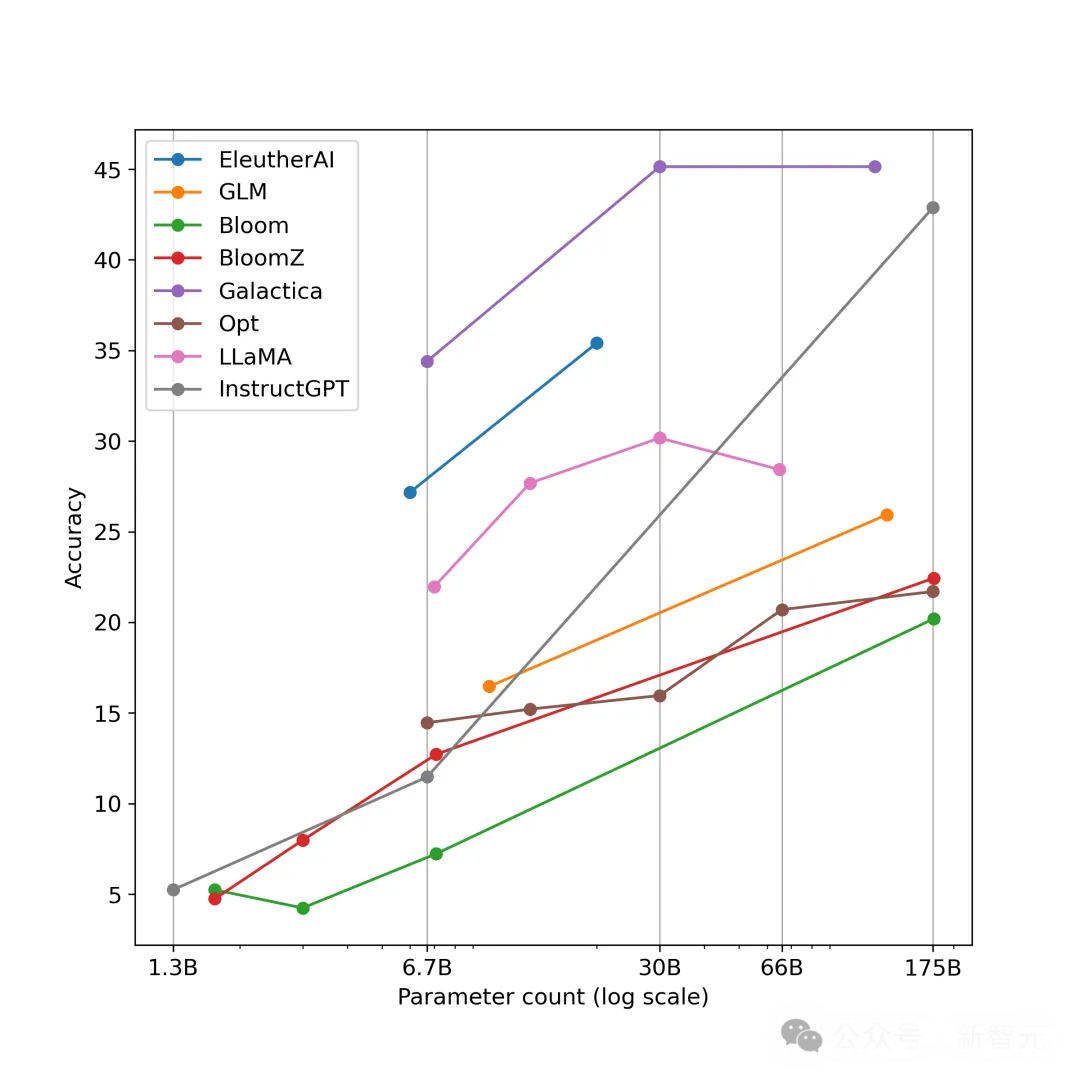

大模型是世界模型吗?UA微软等机构最新研究发现,GPT-4在复杂环境的模拟中,准确率甚至不及60%。对此,LeCun激动地表示,世界模型永远都不可能是LLM。

智源研究院公布大模型全家桶及全栈开源技术基座全新版图。

给人才充足的GPU,是很重要的!

来自浙江大学和伊利诺伊大学厄巴纳-香槟分校的研究者发表了他们关于「表格语言模型」(Tabular Language Model)的研究成果

谷歌DeepMind开发的AlphaFold一夜之间颠覆了生物学,这一革命性的突破背后,有一支怎样的团队?AlphaFold的缔造者之一、DeepMind研究副总裁分享了成功的秘密——如何组建一个团队来应对这一巨大的跨学科挑战并取得胜利。

让AI画漫画角色保持一致的新研究来了!

奥本海默曾在新墨西哥州执行曼哈顿计划,只为拯救世界。并留下了一句:「他们不会对其敬畏,直至理解;而理解,唯有亲身体验之后。」