苹果M4芯片问世,直接让iPad Pro秒杀了所有AI PC!

苹果M4芯片问世,直接让iPad Pro秒杀了所有AI PC!就在刚刚,苹果祭出了地表最强平板—— 采用M4芯片的iPad Pro!

就在刚刚,苹果祭出了地表最强平板—— 采用M4芯片的iPad Pro!

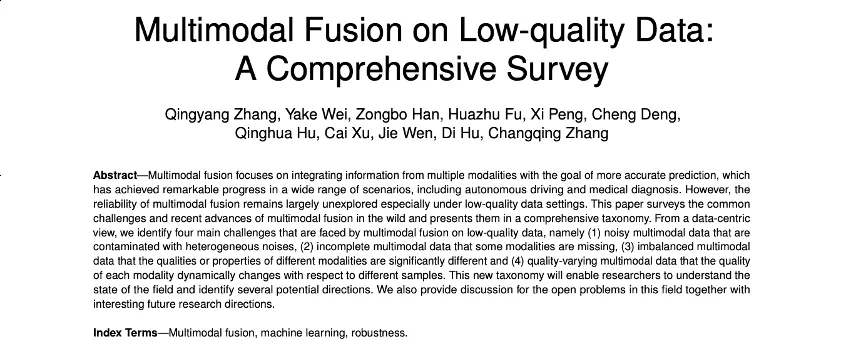

多模态融合是多模态智能中的基础任务之一。

「Siri太笨,根本无法与ChatGPT竞争」,前苹果工程师John Burkey曾对Siri的评价如此不堪。

我们知道,球状星团是一种受引力束缚,成员由几万颗到数百万颗恒星组成的古老星团,在外观上大多呈球形,但也有可能受其他天体系统的引力影响使得形状偏离球形。球状星团的动力学演化过程,星族合成路径等是当今天文学界的研究热点。

根据路透社5月4日消息,著名华人计算机科学家李飞飞正在建立一家初创公司。这家公司会利用类似人类对视觉数据的处理,使 AI 能够进行高级推理。这种AI算法使用的概念被称为“空间智能”。至于新公司的名字,还没有向外界披露。

对于烟雾等动态三维物理现象的高效高质量采集重建是相关科学研究中的重要问题,在空气动力学设计验证,气象三维观测等领域有着广泛的应用前景。通过采集重建随时间变化的三维密场度序列,可以帮助科学家更好地理解与验证真实世界中的各类复杂物理现象。

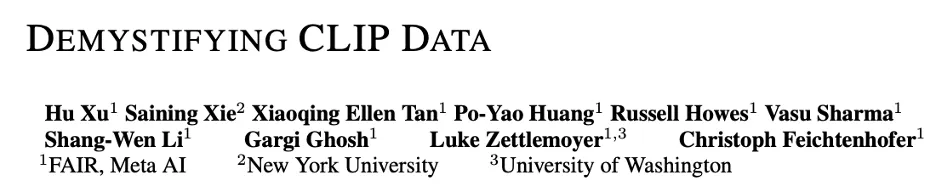

自2021年诞生,CLIP已在计算机视觉识别系统和生成模型上得到了广泛的应用和巨大的成功。我们相信CLIP的创新和成功来自其高质量数据(WIT400M),而非模型或者损失函数本身。虽然3年来CLIP有大量的后续研究,但并未有研究通过对CLIP进行严格的消融实验来了解数据、模型和训练的关系。

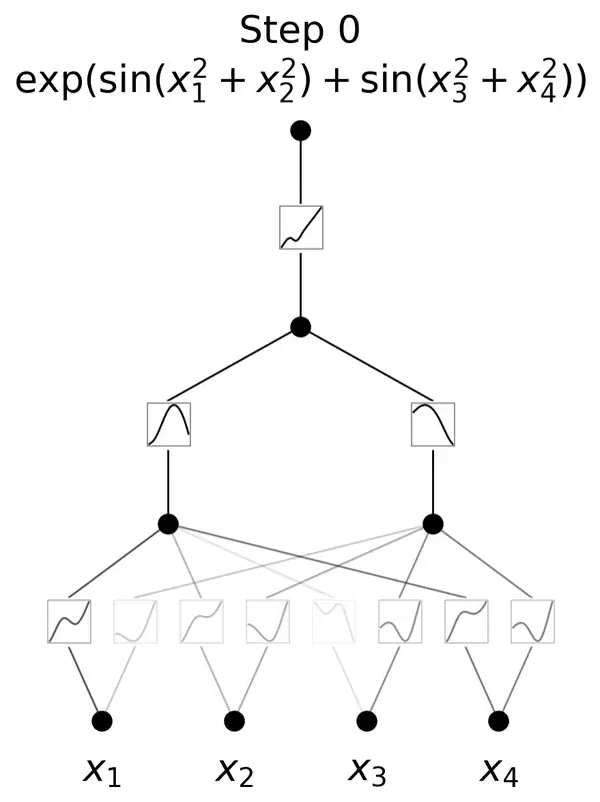

一种全新的神经网络架构KAN,诞生了! 与传统的MLP架构截然不同,且能用更少的参数在数学、物理问题上取得更高精度。

人工智能(AI)工具正在改变科学研究的方式。AlphaFold基本解决了蛋白质结构预测难题;DeepMD大大提高了分子模拟的效率和精度;而新兴的大型语言模型,如ChatGPT等,也正在科学研究领域开疆拓土。

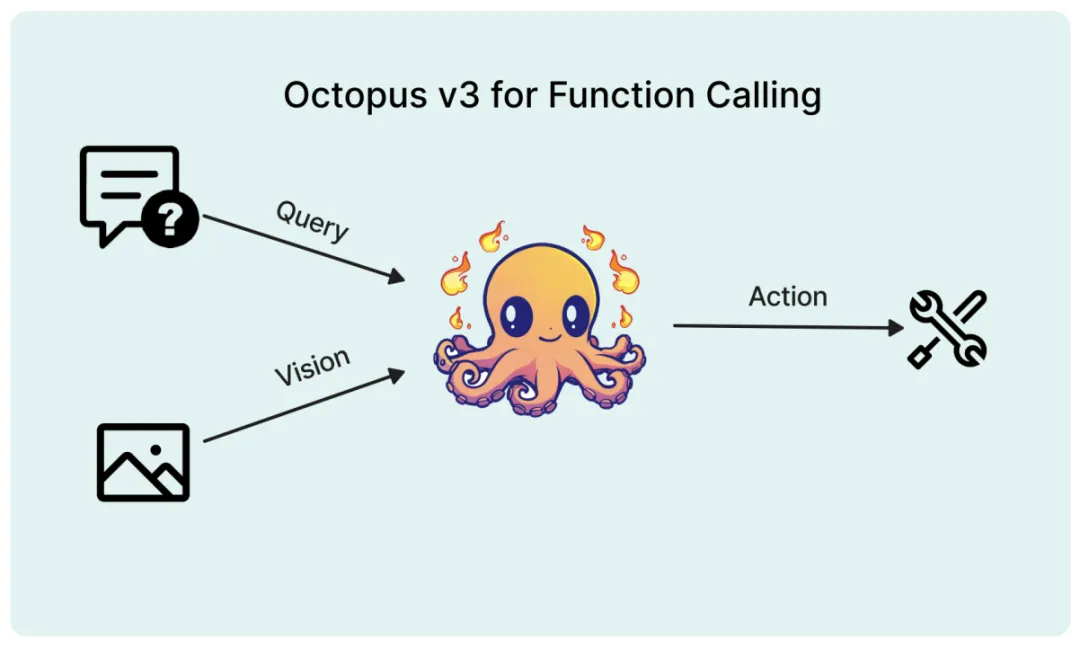

多模态 AI 系统的特点在于能够处理和学习包括自然语言、视觉、音频等各种类型的数据,从而指导其行为决策。近期,将视觉数据纳入大型语言模型 (如 GPT-4V) 的研究取得了重要进展,但如何有效地将图像信息转化为 AI 系统的可执行动作仍面临挑战。