在12个视频理解任务中,Mamba先打败了Transformer

在12个视频理解任务中,Mamba先打败了Transformer探索视频理解的新境界,Mamba 模型引领计算机视觉研究新潮流!传统架构的局限已被打破,状态空间模型 Mamba 以其在长序列处理上的独特优势,为视频理解领域带来了革命性的变革。

探索视频理解的新境界,Mamba 模型引领计算机视觉研究新潮流!传统架构的局限已被打破,状态空间模型 Mamba 以其在长序列处理上的独特优势,为视频理解领域带来了革命性的变革。

近日,上海交通大学自然科学研究院/物理与天文学院/张江高等研究院洪亮课题组,在生物信息学和人工智能研究领域的国际权威学术期刊JCIM(Journal of Chemical Information and Modeling)上发表最新研究成果

本文围绕“AI投资趋势及应用方向”展开讨论,涵盖了AI Agent与流程自动化机器人的本质区别、AI原生商业模式的发展、AI在不同行业中的应用挑战及未来发展方向等内容。

想象一下,你仅需要输入一段简单的文本描述,就可以生成对应的 3D 数字人动画的骨骼动作。而以往,这通常需要昂贵的动作捕捉设备或是专业的动画师逐帧绘制。这些骨骼动作可以进一步的用于游戏开发,影视制作,或者虚拟现实应用。来自阿尔伯塔大学的研究团队提出的新一代 Text2Motion 框架,MoMask,正在让这一切变得可能。

训练模型搞得跟《饥饿游戏》似的,全球AI研究者,都在苦恼怎么才能喂饱这群数据大胃王。

上海期智研究院是上海市新型研发机构之一,由图灵奖得主姚期智于2020年创建。研究院以建设世界顶尖基础科学研究机构为使命,打造上海科创中心建设新标杆。

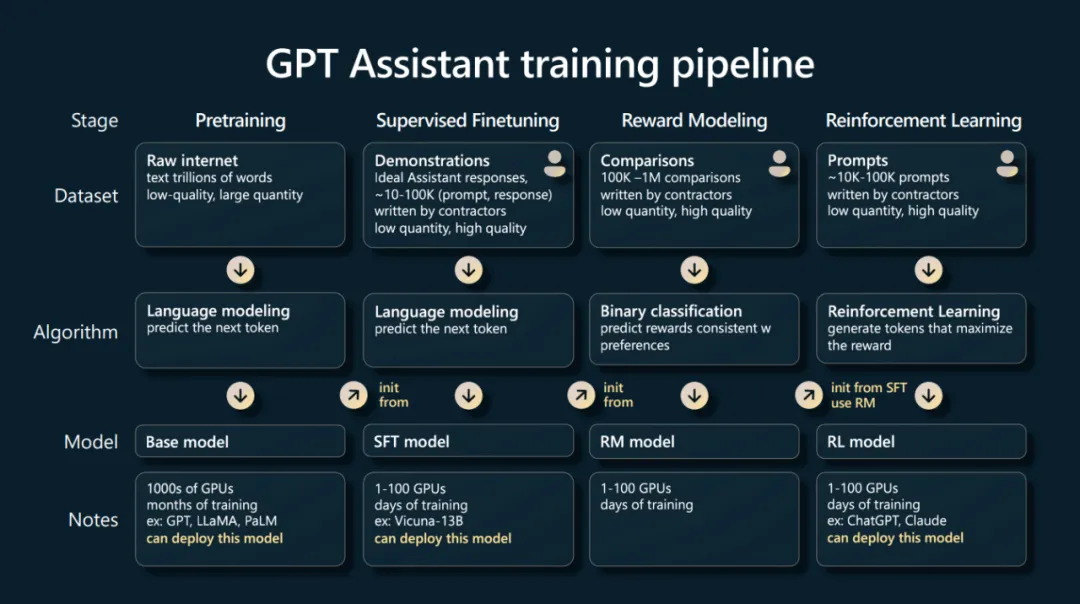

在人工智能的前沿领域,大语言模型(Large Language Models,LLMs)由于其强大的能力正吸引着全球研究者的目光。在 LLMs 的研发流程中,预训练阶段占据着举足轻重的地位,它不仅消耗了大量的计算资源,还蕴含着许多尚未揭示的秘密。

过去几年来,扩散模型强大的图像合成能力已经得到充分证明。研究社区现在正在攻克一个更困难的任务:视频生成。近日,OpenAI 安全系统(Safety Systems)负责人 Lilian Weng 写了一篇关于视频生成的扩散模型的博客。

最近几年,AI技术的发展远远超出普通大众和研究者的预期,「通用人工智能(AGI)」的概念也从科幻小说中走进了日常生活的讨论中,成为了许多科技公司和研究机构所追求的最终目标。

2023年12月,宁德时代低调宣布在香港设立国际研发中心; 2024年3月11日,作为中国科学院在香港设立的首个国家级信息研发机构,中国科学院香港创新研究院人工智能与机器人创新中心发布了医疗多模态大模型CARES Copilot 1.0;