登上NeurIPS,Genesis开创无需OCC引导的多模态生成新范式,在视频与激光雷达指标上达到SOTA水平

登上NeurIPS,Genesis开创无需OCC引导的多模态生成新范式,在视频与激光雷达指标上达到SOTA水平由华中科技大学与小米汽车提出了业内首个无需 OCC 引导的多模态的图像 - 点云联合生成框架 Genesis。该算法只需基于场景描述和布局(包括车道线和 3D 框),就可以生成逼真的图像和点云视频。

由华中科技大学与小米汽车提出了业内首个无需 OCC 引导的多模态的图像 - 点云联合生成框架 Genesis。该算法只需基于场景描述和布局(包括车道线和 3D 框),就可以生成逼真的图像和点云视频。

机器之心报道 编辑:+0 自动驾驶有 L1-L5 的分级路径,现在教育 AI 也有了自己的版本。 如今,「AI 下半场」已成共识,应用落地正成为决定未来的关键。教育,作为关乎人类发展的根本基石,已然成

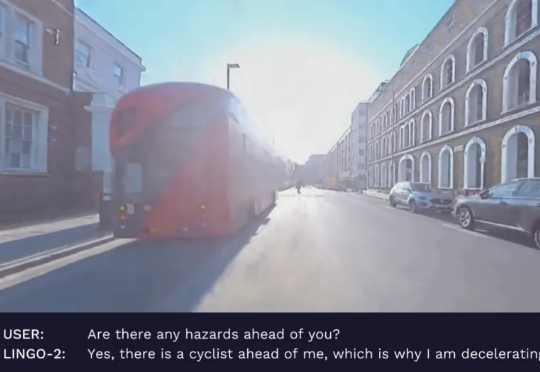

Wayve,一家总部位于英国的无人驾驶初创公司,有望凭一己之力拿到其中的五分之一。该公司日前宣布,已与英伟达签署意向书,后者将在其下一轮融资中“评估 5 亿美元的投资”。同时,Wayve 即将推出的 Gen 3 硬件平台,将完全基于英伟达的 DRIVE AGX Thor 车载计算平台打造。

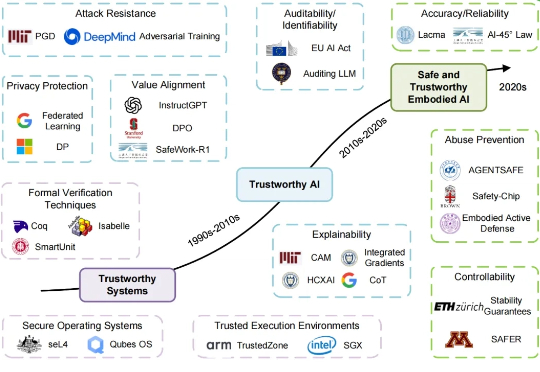

近年来,以人形机器人、自动驾驶为代表的具身人工智能(Embodied Artificial Intelligence, EAI)正以前所未有的速度发展,从数字世界大步迈向物理现实。然而,当一次错误的风险不再是屏幕上的一行乱码,而是可能导致真实世界中的物理伤害时,一个紧迫的问题摆在了我们面前: 如何确保这些日益强大的具身智能体是安全且值得信赖的?

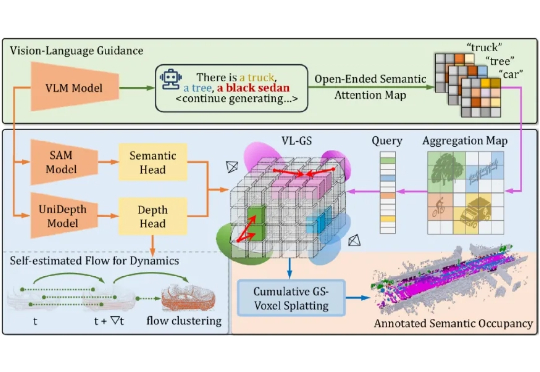

本文介绍了来自北京大学王选计算机研究所王勇涛团队及合作者的最新研究成果 AutoOcc。针对开放自动驾驶场景,该篇工作提出了一个高效、高质量的 Open-ended 三维语义占据栅格真值标注框架,无需任何人类标注即可超越现有语义占据栅格自动化标注和预测管线,并展现优秀的通用性和泛化能力,论文已被 ICCV 2025 录用为 Highlight。

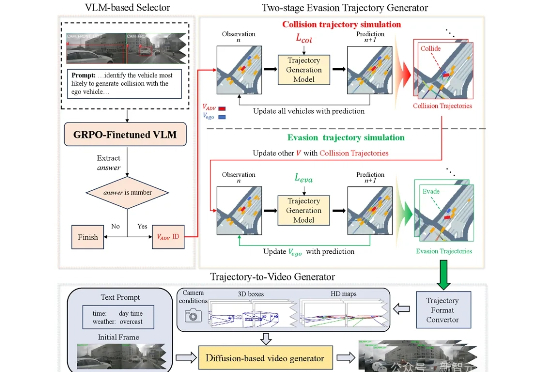

浙江大学与哈工大(深圳)联合推出SafeMVDrive,利用扩散模型结合VLM实现批量化多视角真实域的安全关键视频生成。该方法在保持画质与真实感的同时,显著增强了驾驶场景的危险性。生成的场景用于端到端自动驾驶系统的极限压测,可使得模型的碰撞率提升50倍。

无需人工标注,吞下17亿张图片,Meta用自监督学习炼出「视觉全能王」!NASA已将它送上火星,医疗、卫星、自动驾驶领域集体沸腾。

AI Coding背后的争议,正在升级。 有人说它是写代码的“自动驾驶”,有人说只是个“聪明的实习生”;有人觉得它能让0基础小白一键出成果,有人则坚持它应该精准到不改一行多余的代码。

特斯拉Dojo超级计算机团队被解散!特斯拉自动驾驶的「算力心脏」Dojo已被终止。马斯克放弃训练算力,而核心团队另立山头。

拒绝“隐形陷阱”。 在互联网行业,尽管“一亏亏几十亿、一做做十几年”,可依赖于智慧交通、自动驾驶和本地生活的考量,地图,大厂一直都在“砸钱”。