盘一盘,2017年Transformer之后,LLM领域的重要论文

盘一盘,2017年Transformer之后,LLM领域的重要论文这两天 Andrej Karpathy 的最新演讲在 AI 社区引发了热烈讨论,他提出了「软件 3.0」的概念,自然语言正在成为新的编程接口,而 AI 模型负责执行具体任务。

搜索

搜索

这两天 Andrej Karpathy 的最新演讲在 AI 社区引发了热烈讨论,他提出了「软件 3.0」的概念,自然语言正在成为新的编程接口,而 AI 模型负责执行具体任务。

人类从农耕时代到工业时代花了数千年,从工业时代到信息时代又花了两百多年,而 LLM 仅出现不到十年,就已将曾经遥不可及的人工智能能力普及给大众,让全球数亿人能够通过自然语言进行创作、编程和推理。

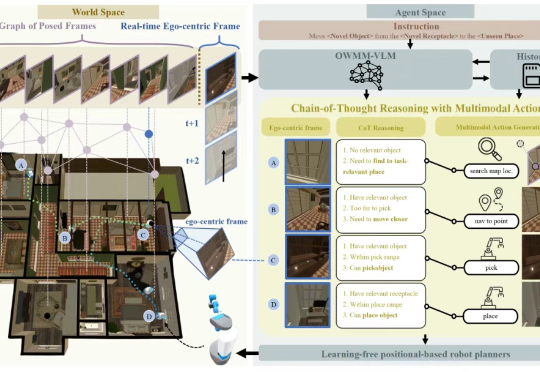

在家庭服务机器人领域,如何让机器人理解开放环境中的自然语言指令、动态规划行动路径并精准执行操作,一直是学界和工业界的核心挑战。

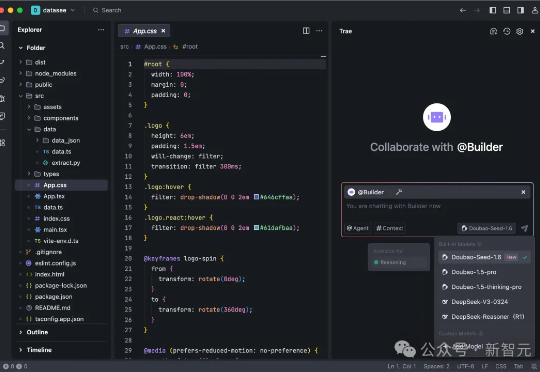

短短3天时间,字节技术副总裁就借助AI原生IDE——TRAE,打造并开源了一款英语学习应用「积流成江」。其中,约85%代码都是通过自然语言生成的。

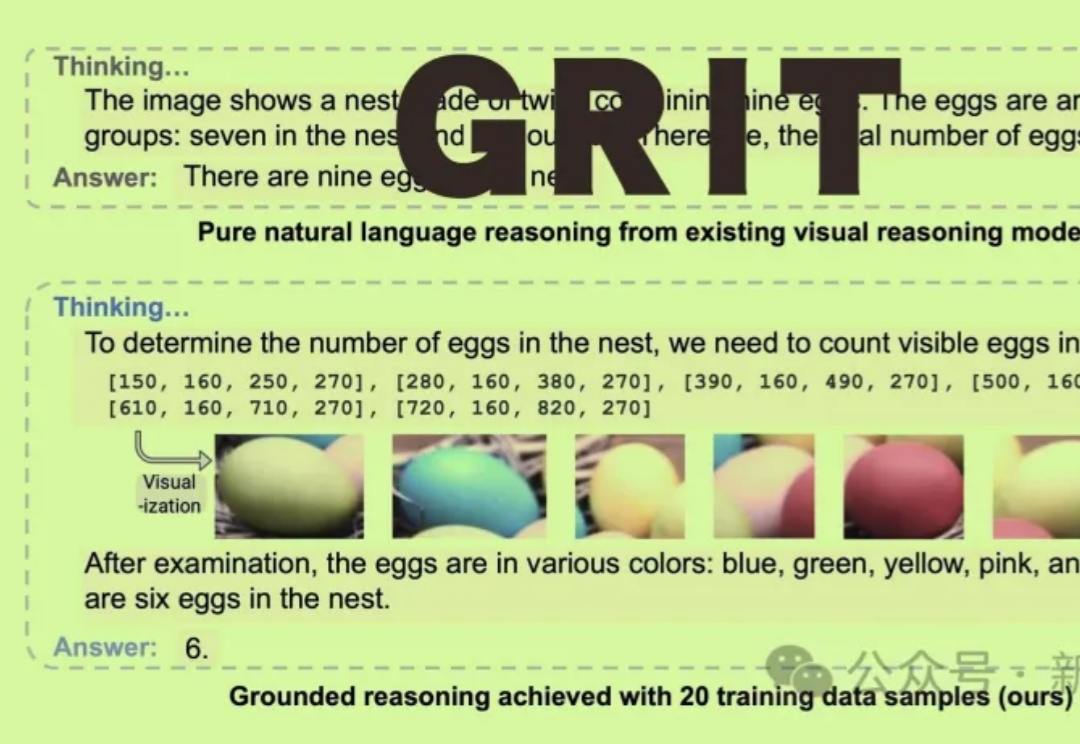

GRIT能让多模态大语言模型(MLLM)通过生成自然语言和图像框坐标结合的推理链进行「图像思维」,仅需20个训练样本即可实现优越性能!

「编程的未来是Human语言」,AI掀起编程70年来最大变革,从对话到代码,「氛围编程」与自然语言成为主角。老黄预言,AI让人人都能成为人机交互的桥梁。

「市象」获悉,段楠已在其GitHub主页悄然更新履历:现任京东探索研究院视觉与多模态实验室负责人,带领研究团队研发视觉和多模态基础模型。此前,他曾任阶跃星辰Technical Fellow(2024-2025)和微软亚洲研究院自然语言计算团队资深首席研究员和研究经理(2012-2024)。

豆包的一句话P图功能,又进化了!各种高考祝福、网络梗图、大片级精修、设计师草稿,无不是信手拈来。此刻,AI P图再次迎来降维打击,只要用自然语言,就能实现精准的图片编辑。可以说,AI修图终于来到了3.0时代!

在生成式 AI 重塑搜索形态的当下,Perplexity 正以“答案”为核心,重构信息入口。它不是聊天机器人,也不是传统搜索引擎,而是一种 “认知界面”——通过自然语言对话,为用户提供可验证、可引用的真实答案 。

IBM 于 6 月 2 日宣布已收购 Seek AI,这是一个允许用户使用自然语言查询企业数据的 AI 平台,具体收购金额未披露。