一手实测豆包新发布的视觉理解大模型,他们真的卷起飞了。

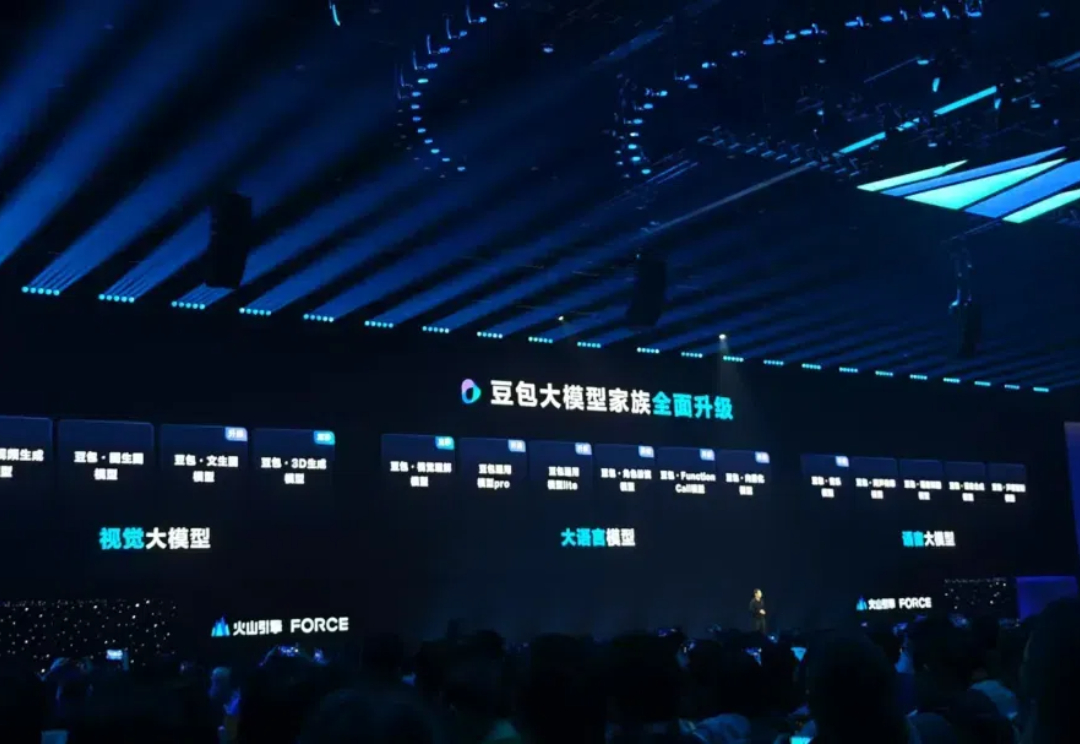

一手实测豆包新发布的视觉理解大模型,他们真的卷起飞了。人在字节火山发布会现场。 眼睁睁看着他们发了一大堆的模型升级,眼花缭乱,有一种要一股脑把字节系的AI底牌往桌上亮的感觉。 有语音的,有音乐的,有大语言模型的,有文生图的,有3D生成。

人在字节火山发布会现场。 眼睁睁看着他们发了一大堆的模型升级,眼花缭乱,有一种要一股脑把字节系的AI底牌往桌上亮的感觉。 有语音的,有音乐的,有大语言模型的,有文生图的,有3D生成。

从23年初的小规模尝试,到今年各大中小厂商纷纷入局,AIGC的能力以惊人的速度发展,并快速融入了社交、游戏等多条不同的赛道,共同编织出了一个新的领域——AI互娱。

如果从今年10月份开始算,截止到现在,视觉中国股价已经翻了一倍多。有点2022年底GPT概念股的架势。不过,视觉中国的涨停可不是靠概念,而是靠AI项目合作换来的。基于社区、场景和数据优势,目前国内包括智谱、通义千问、可灵AI、即梦AI、生数科技(Vidu)、爱诗科技(Pixverse)等几乎所有主流文生视频平台都接入了视觉中国。

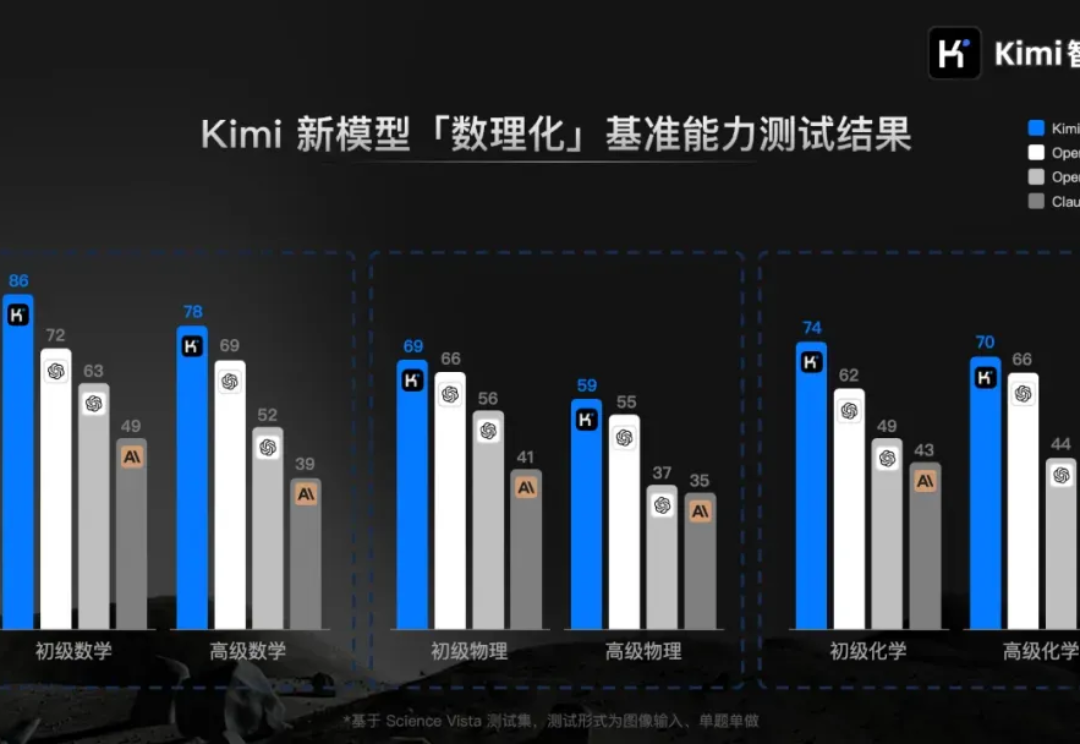

国产大模型,正在引领 AI 技术新方向。 今天上午,月之暗面 Kimi 正式发布了视觉思考模型 k1,并已经上线了最新版的网页版以及安卓和 iOS APP。

通用语言模型率先起跑,但通用视觉模型似乎迟到了一步。究其原因,语言中蕴含大量序列信息,能做更深入的推理;而视觉模型的输入内容更加多元、复杂,输出的任务要求多种多样,需要对物体在时间、空间上的连续性有完善的感知,传统的学习方法数据量大、经济属性上也不理性...... 还没有一套统一的算法来解决计算机对空间信息的理解。

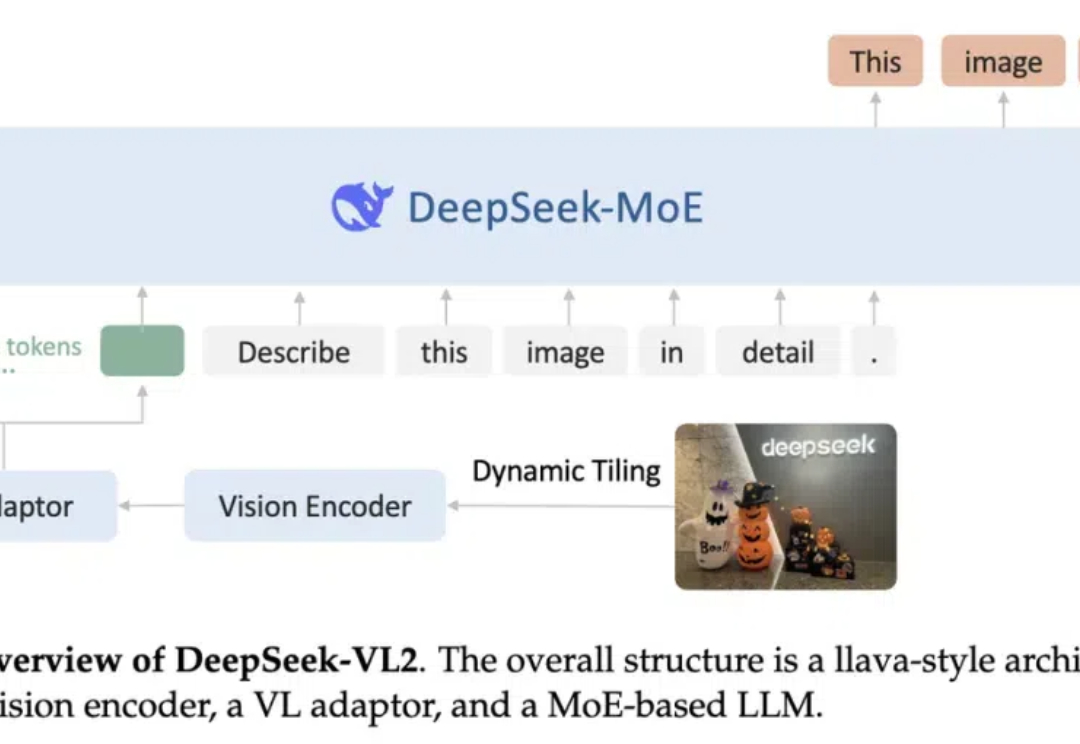

阔别九月,大家期待的 DeepSeek-VL2 终于来了!DeepSeek-MoE 架构配合动态切图,视觉能力再升级。从视觉定位到梗图解析,从 OCR 到故事生成,从 3B、16B 再到 27B,DeepSeek-VL2 正式开源。

大语言模型(LLMs)通过更多的推理展现出了更强的能力和可靠性,从思维链提示发展到了 OpenAI-o1 这样具有较强推理能力的模型。

李飞飞最新采访来了,继续延伸她在NeurIPS有关视觉智能的话题。

Hyper-YOLO是一种新型目标检测方法,通过超图计算增强了特征之间的高阶关联,提升了检测性能,尤其在识别复杂场景下的中小目标时表现更出色。

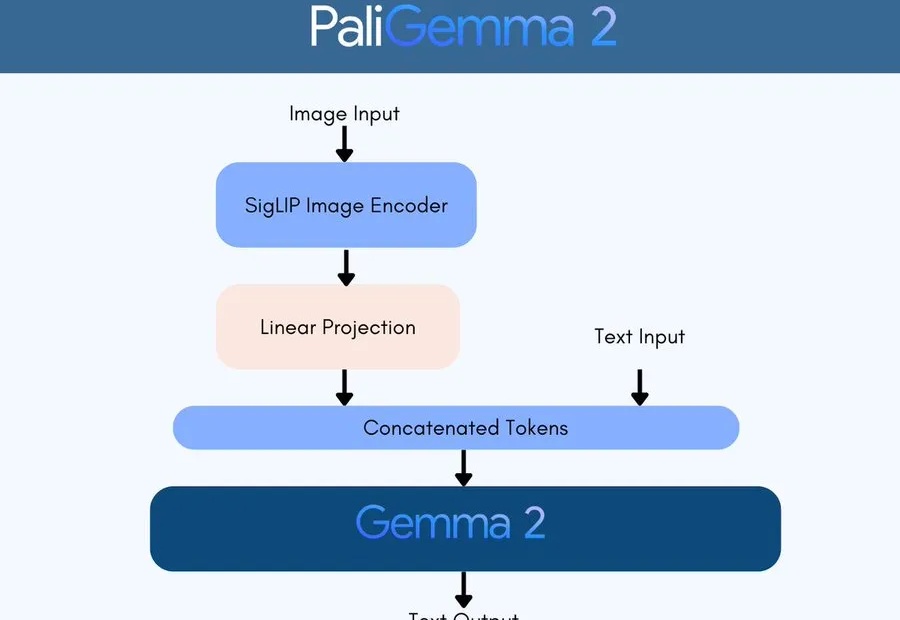

PaliGemma 2在多个任务上取得了业界领先的成绩,包括图像描述、乐谱识别和医学图像报告生成;并且提供了不同尺寸和分辨率的版本,用户可以根据不同的任务需求进行微调,以获得更好的性能。