当LLM遇到结构化思维困境,这个70年前的心理学框架竟成为救星 | 最新

当LLM遇到结构化思维困境,这个70年前的心理学框架竟成为救星 | 最新当大多数AI Agent仍在挣扎于结构化推理能力不足的困境时,本文带来了一个来自认知科学领域的突破性解决方案。

当大多数AI Agent仍在挣扎于结构化推理能力不足的困境时,本文带来了一个来自认知科学领域的突破性解决方案。

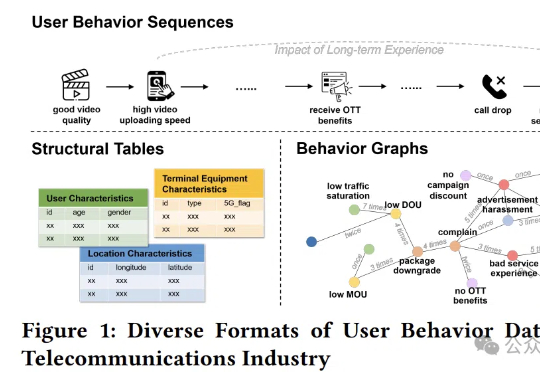

专门解决电信行业用户行为建模的难题。

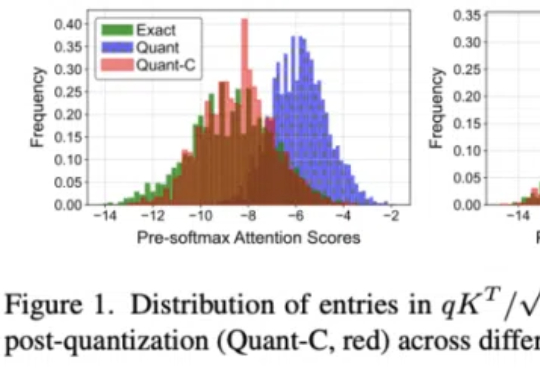

简单的任务,传统的Transformer却错误率极高。Meta FAIR团队重磅推出多token注意力机制(MTA),精准捕捉复杂信息,带来模型性能飞升!

低秩适配器(LoRA)能够在有监督微调中以约 5% 的可训练参数实现全参数微调 90% 性能。

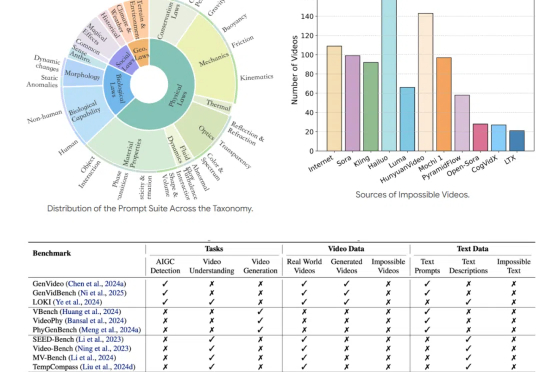

随着人工智能合成视频(AIGC)技术的飞速发展,我们正步入一个由 AI 主导的视频创作时代。

通过完全启用并发多块执行,支持任意专家数量(MAX_EXPERT_NUMBER==256),并积极利用共享内存(5kB LDS)和寄存器(52 VGPRs,48 SGPRs),MoE Align & Sort逻辑被精心设计,实现了显著的性能提升:A100提升3倍,H200提升3倍,MI100提升10倍,MI300X/MI300A提升7倍...

在InternVL-2.5上实现10倍吞吐量提升,模型性能几乎无损失。

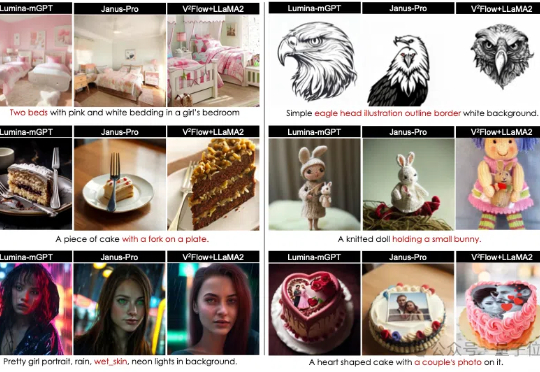

视觉Token可以与LLMs词表无缝对齐了!

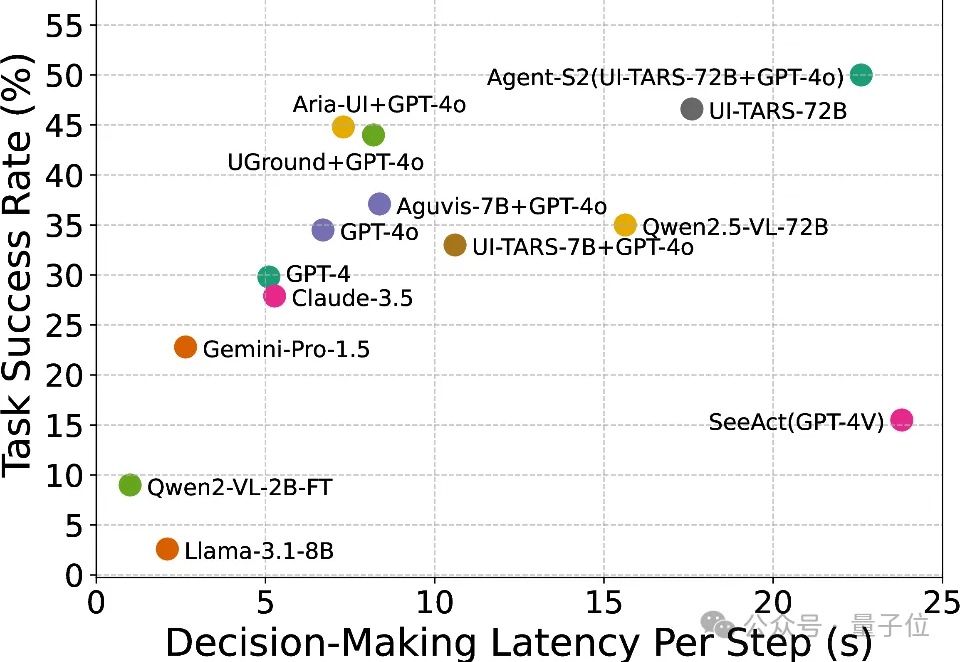

随着人工智能和大语言模型(LLMs)的不断突破,如何将其优势赋能于现实世界中可实际部署的高效工具,成为了业界关注的焦点。

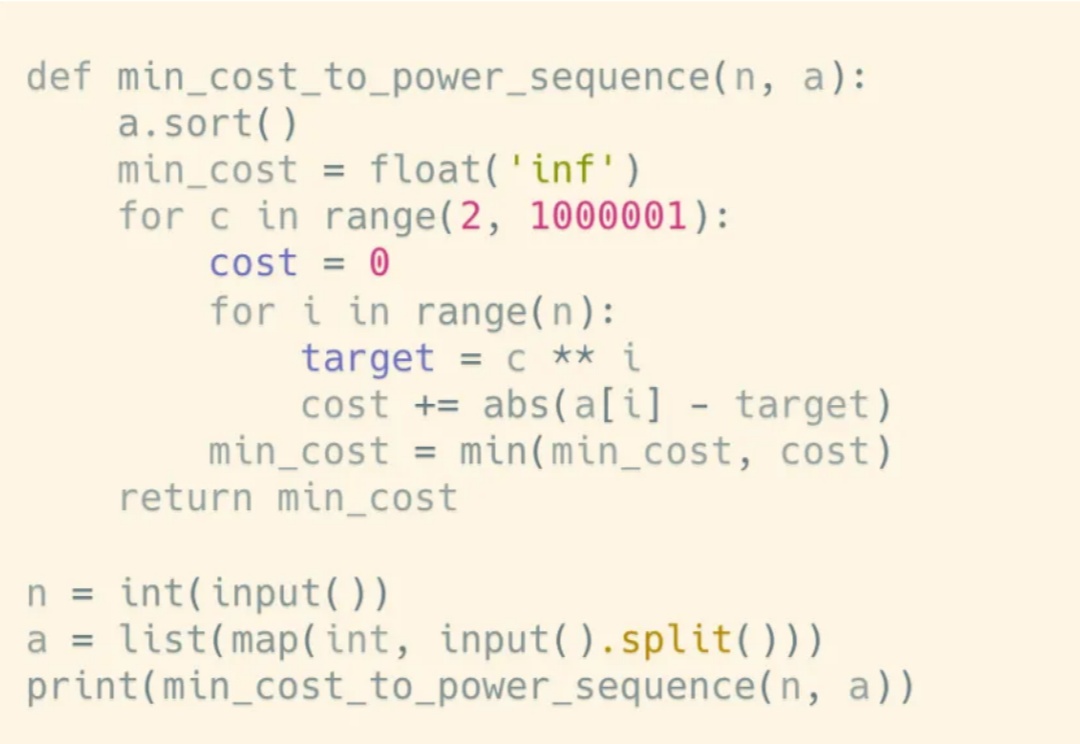

大模型写代码早就是基操了,但让它写算法竞赛题或企业级系统代码,就像让只会煮泡面的人去做满汉全席 —— 生成的代码要么是 “铁板一块” 毫无章法,要么是 “一锅乱炖” 难以维护。